Patente de Microsoft revela tecnología para prevenir alucinaciones de IA

Uno de los principales obstáculos a los que se enfrenta hoy la inteligencia artificial es su propensión a alucinar, lo que significa que puede generar información engañosa o inventada mientras intenta completar tareas. Aunque la mayoría de los sistemas de IA utilizan recursos en línea para ofrecer respuestas precisas, las conversaciones prolongadas a veces pueden hacer que la IA se base en información infundada.

A principios de este año, Microsoft comenzó a desarrollar una solución para abordar las alucinaciones de la IA y también publicó un documento de investigación que detalla una tecnología patentada destinada a prevenir de forma preventiva estas imprecisiones.

El documento titulado “Interactuar con un modelo de lenguaje utilizando conocimiento y retroalimentación externos” describe cómo funcionaría este mecanismo.

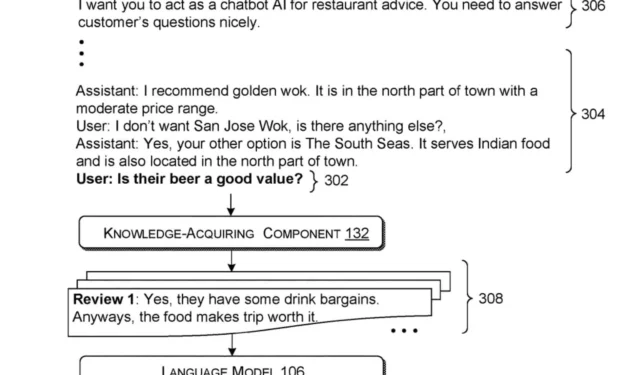

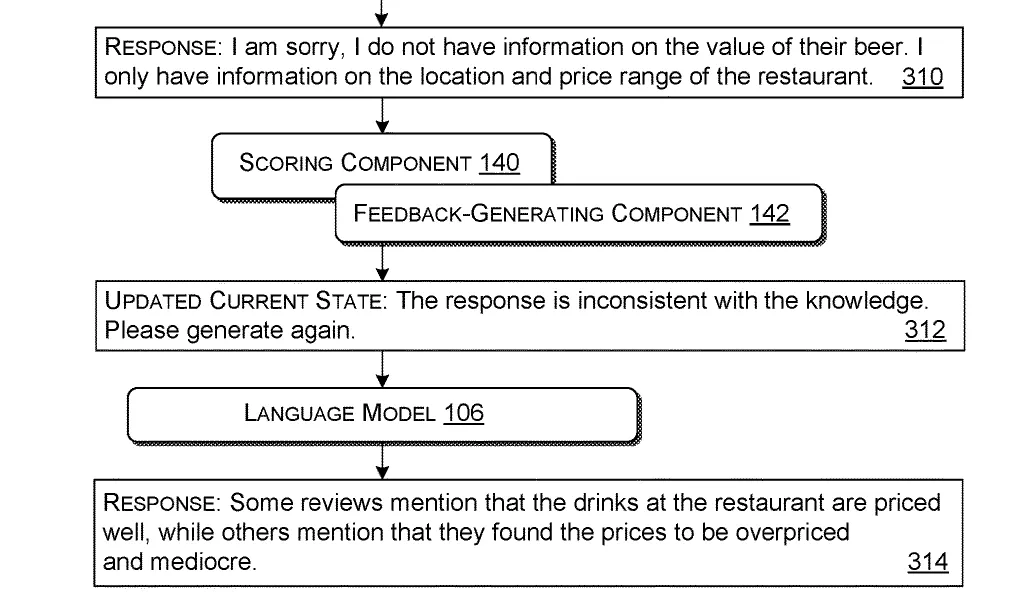

Este sistema funciona procesando una consulta (una pregunta o solicitud de un usuario). A continuación, obtiene información relevante de fuentes externas en función de esa consulta. Posteriormente, sintetiza esta información junto con la consulta original en un paquete coherente adecuado para que lo utilice el modelo de lenguaje.

Una vez construido el paquete, se lo presenta al modelo de lenguaje, que lo entrena para que formule respuestas en función de la información de entrada proporcionada. Luego, el modelo de IA genera una respuesta inicial basada en este paquete de información de entrada.

Para garantizar la relevancia de la respuesta, el sistema emplea criterios predefinidos para evaluar si el resultado inicial cumple con los estándares de utilidad. Si la primera respuesta carece de valor (indicativo de alucinaciones de IA), el sistema construye un paquete mejorado de datos de entrada que incluye comentarios sobre la información incorrecta o faltante.

Esta entrada recién revisada se retroalimenta al modelo de lenguaje, que luego produce una respuesta actualizada basada en esta información refinada.

Esta innovadora tecnología tiene potencial no solo para combatir las alucinaciones de la IA, sino también para diversas aplicaciones del mundo real. Por ejemplo, como se detalla en el artículo, este sistema podría ser utilizado por asistentes de IA en restaurantes, lo que les permitiría ofrecer información veraz y verificada a los clientes y adaptar sus respuestas en función de las consultas cambiantes de los clientes durante las conversaciones.

Este proceso iterativo mejora la precisión y la utilidad de las respuestas del modelo de lenguaje al refinar la entrada y la retroalimentación continuamente.

Aunque actualmente es solo una patente, los conceptos analizados sugieren que Microsoft está comprometido a mejorar la funcionalidad y confiabilidad de sus modelos de IA, como Copilot.

El gigante tecnológico ya ha expresado su ambición de abordar y eliminar las alucinaciones en los modelos de IA, destacando un futuro en el que se puede generar información precisa de manera confiable en funciones como la asistencia en restaurantes.

Con estrategias para eliminar las alucinaciones, los modelos de IA podrían brindar respuestas precisas sin recurrir a información incorrecta. Al combinarse con las capacidades de voz del último Copilot, la IA podría reemplazar puestos de trabajo de nivel básico, como los sistemas automatizados de atención al cliente.

¿Qué opinas sobre este desarrollo?

Puedes explorar el artículo completo aquí .

Deja una respuesta