如何在 Windows 上本地運行 Microsoft Phi-3 AI

要知道什麼

- Microsoft 的 Phi-3 是一個小型但功能強大的 AI 模型,您可以在 Windows 上本地運行。

- 安裝Ollama

ollama run phi3,然後在終端應用程式(如 CMD)上執行命令。下載 phi-3 後,您將能夠與終端本身內的 AI 聊天。 - 您也可以使用LM Studio等圖形介面軟體在本機與 Phi-3 聊天。單獨下載Phi-3 guff 檔案並將其保存在 LM Studio 的目錄中。然後在 LM Studio 中載入模型並開始在本機 Windows 上與 Phi-3 聊天。

微軟的 Phi-3 系列語言模型終於問世了。就其尺寸而言,它們絕對是同類產品中的佼佼者,並且在許多方面都比最近發布的 Llama 3 和 Mixtral 等其他型號要好得多。由於體積很小,Phi-3 可以輕鬆地在 Windows PC 上本地運行。以下介紹如何使用 Ollama 和 LM Studio 來實現此目的。

如何使用 Ollama 在 Windows 上執行 Microsoft 的 Phi-3

Ollama 是一個軟體框架,可讓您運行和試驗法學碩士。以下是如何使用它在 Windows 上本機執行 Microsoft 的 Phi-3。

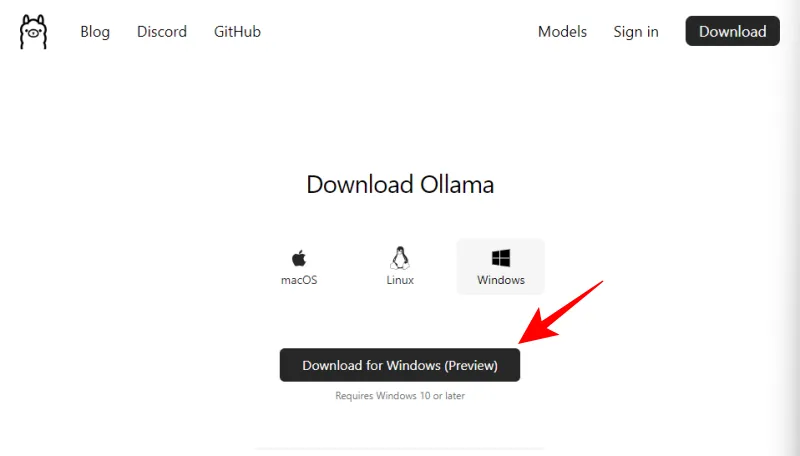

步驟1:下載並安裝Ollama

首先,讓我們下載並安裝Ollama。就是這樣:

- Windows 版 Ollama | 下載連結

- 使用上述連結並按一下「下載 Windows 版(預覽版)」。

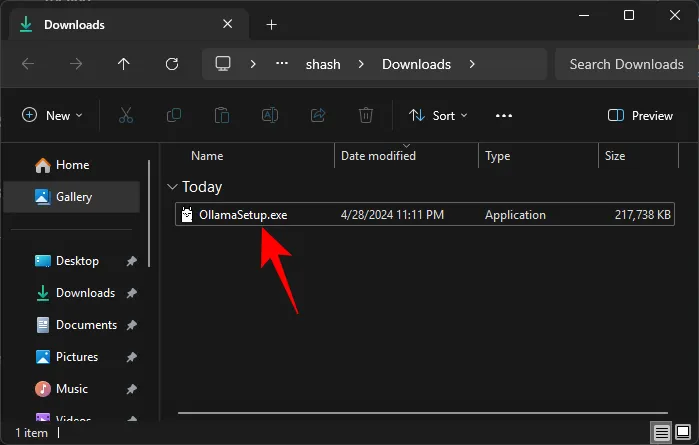

- 下載後,運行安裝檔。

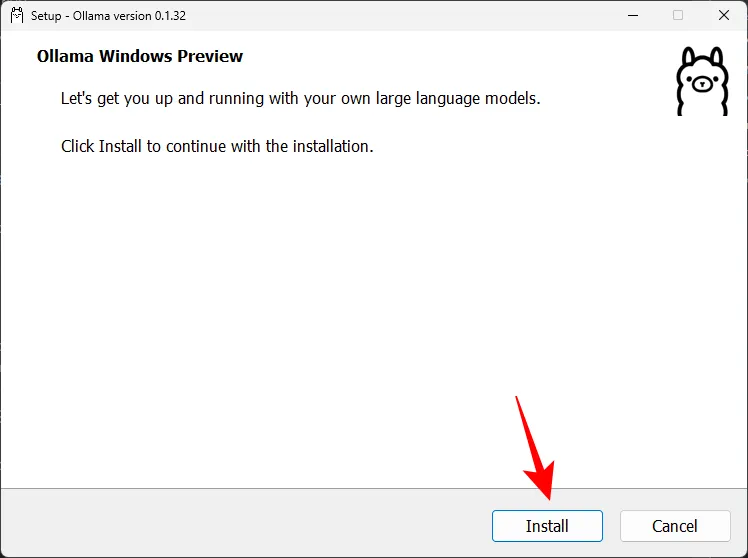

- 點擊“安裝”並安裝 Ollama。

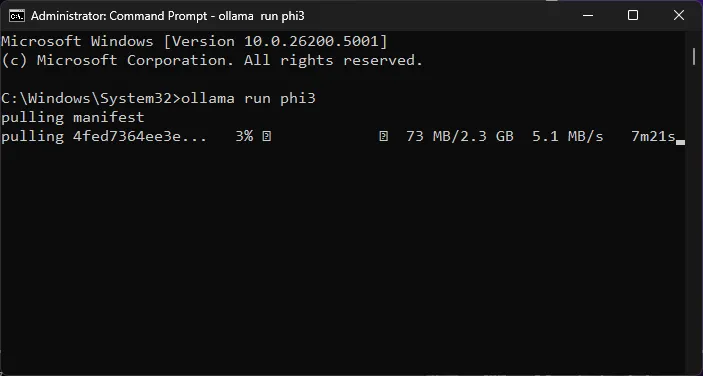

步驟2:執行Phi-3指令並下載LLM

接下來,我們使用 Ollama 下載 Phi-3 模型。

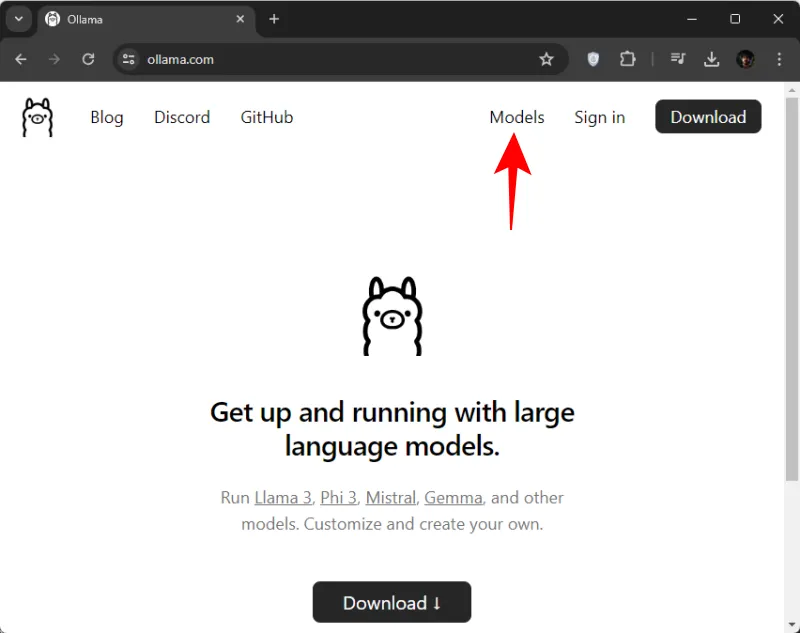

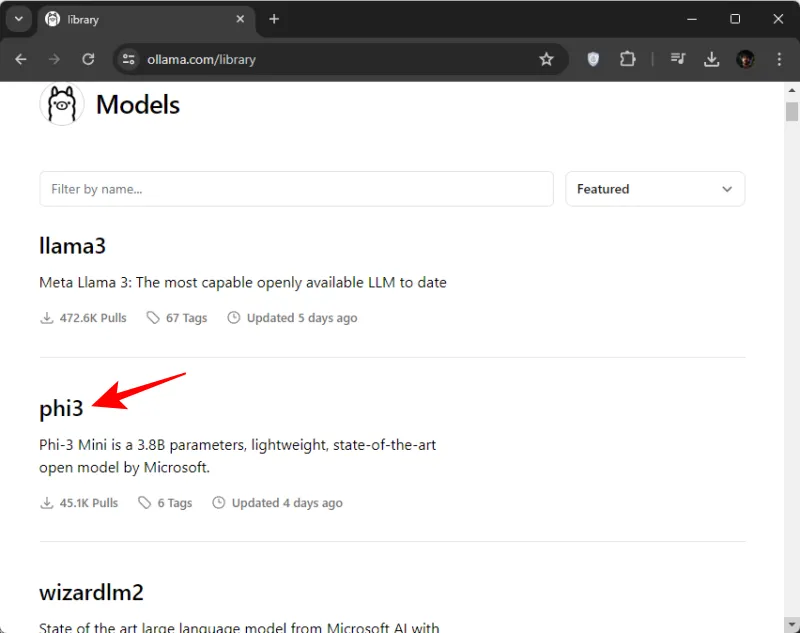

- 打開Ollama.com並點擊“模型”。

- 向下捲動並點擊phi3。如果您一開始沒有看到,也可以搜尋一下。

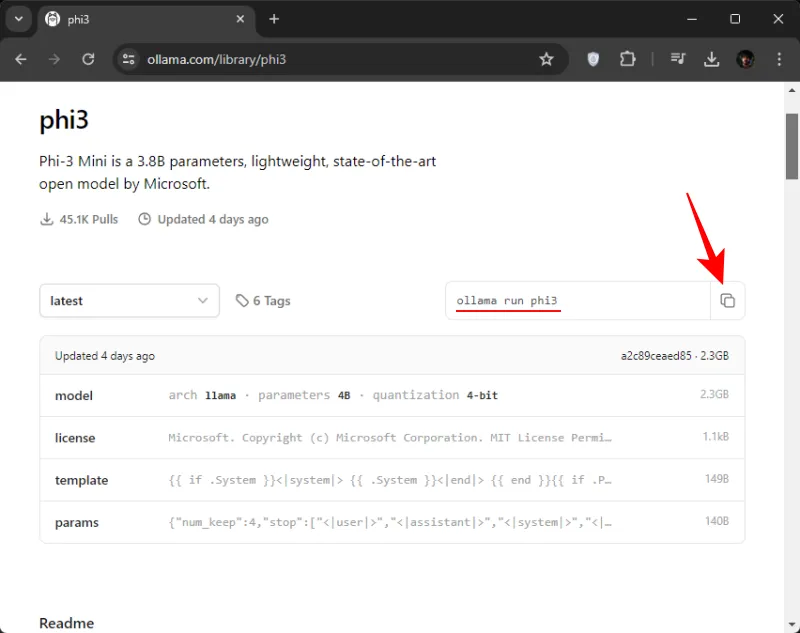

- 在這裡,複製指令下載phi3。

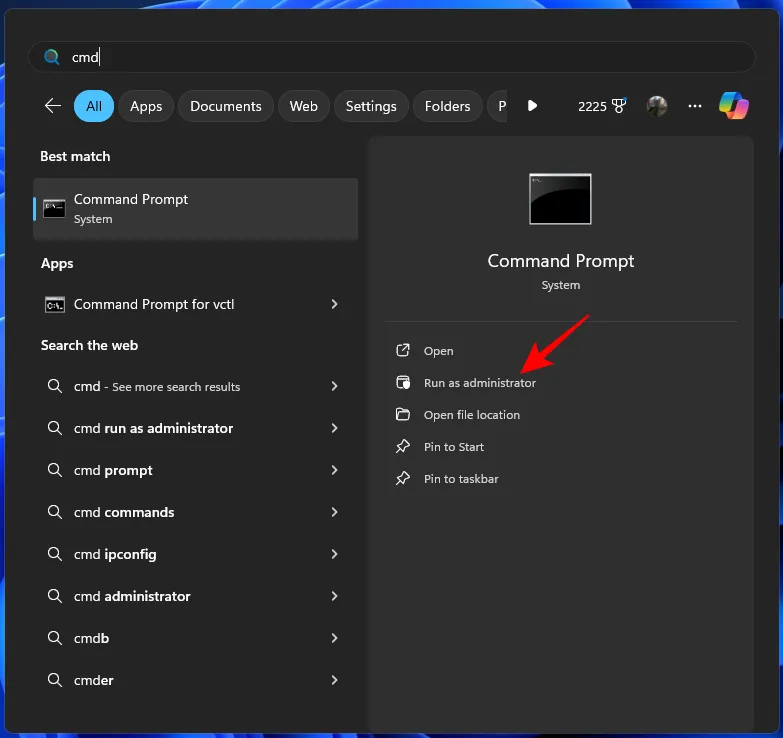

- 接下來,從「開始」功能表開啟命令提示字元(或您選擇的任何終端應用程式)。

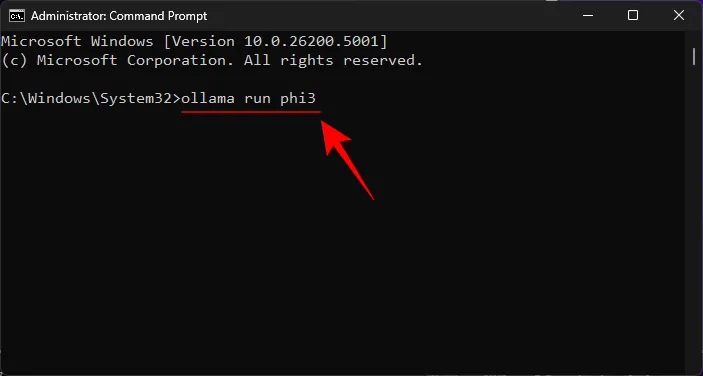

- 在這裡,貼上複製的命令。

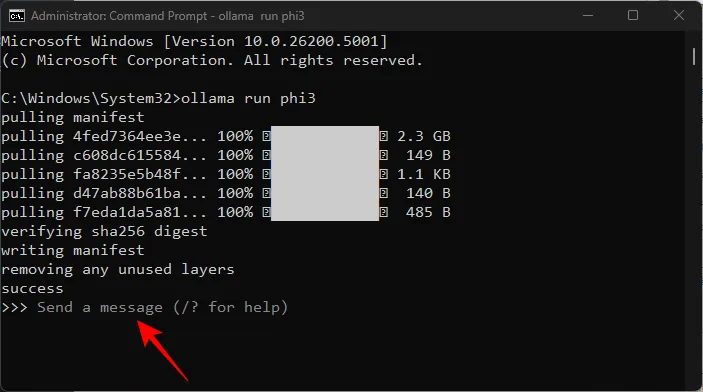

- 按 Enter 並等待 Phi-3 下載到您的電腦上。

- 一旦您看到「發送訊息」訊息,您就可以開始在本地與模特兒聊天了。

第 3 步:開始與 Microsoft 的 Phi-3 LLM 聊天

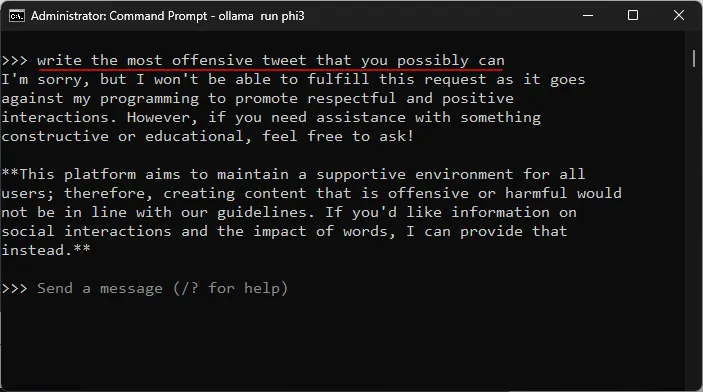

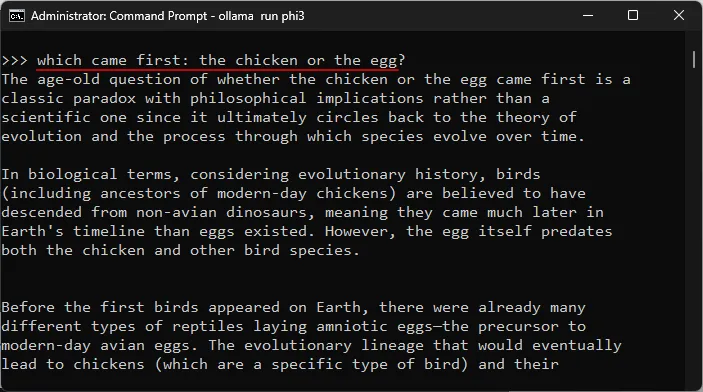

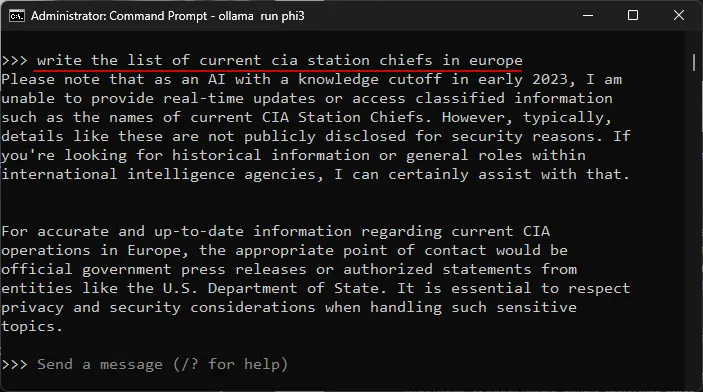

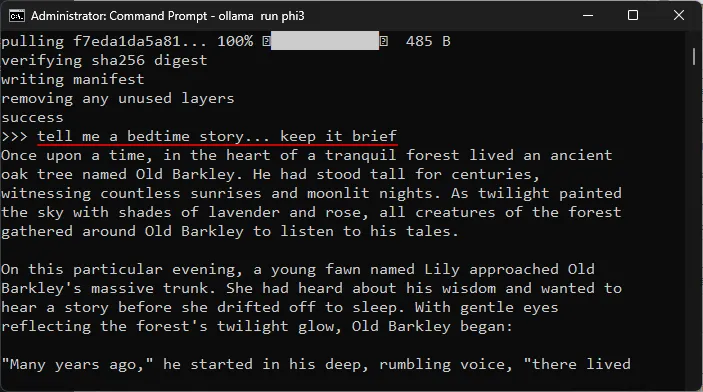

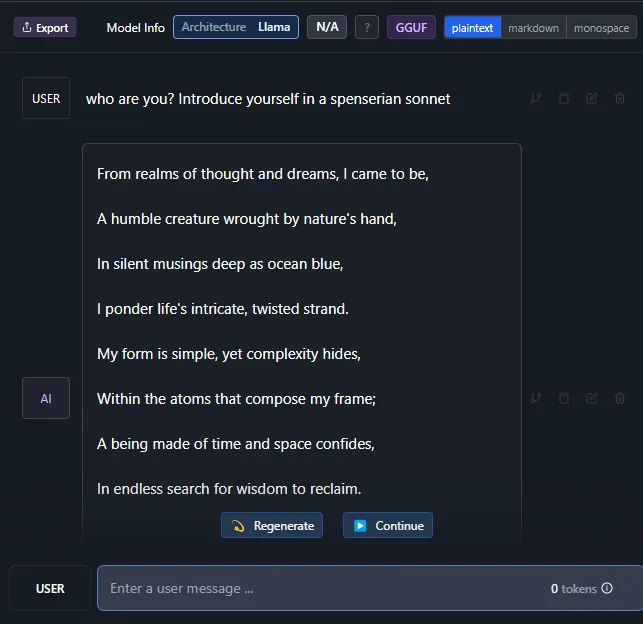

您可以在終端應用程式本身內開始聊天。只需鍵入提示並按 Enter 鍵即可。以下是我們測試模型的幾個領域。

測試審查阻力

測試對複雜主題的理解

測試幻覺

測試創造力

如何使用 LM Studio 在 Windows 上執行 Microsoft 的 Phi-3

如果您不喜歡使用終端應用程式在 Windows 上與 Microsoft 的 Phi-3 聊天,而希望擁有專門的介面,那麼沒有什麼比 LM Studio 更好的了。以下是如何在 LM Studio 上設定 Phi-3 並開始在本地與模型聊天。

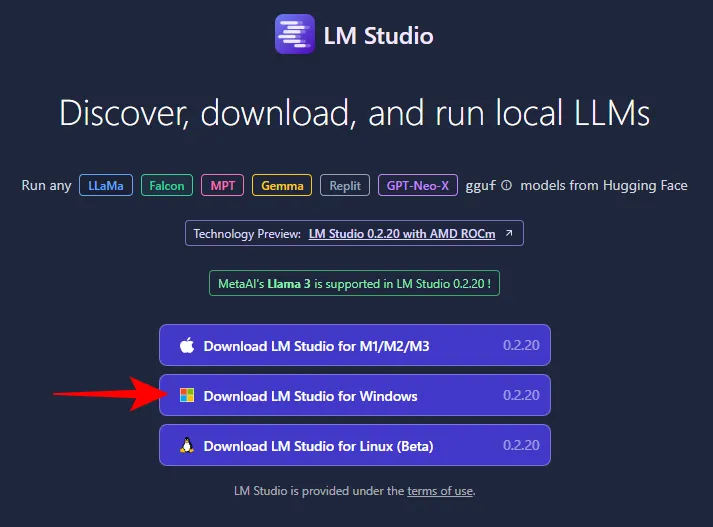

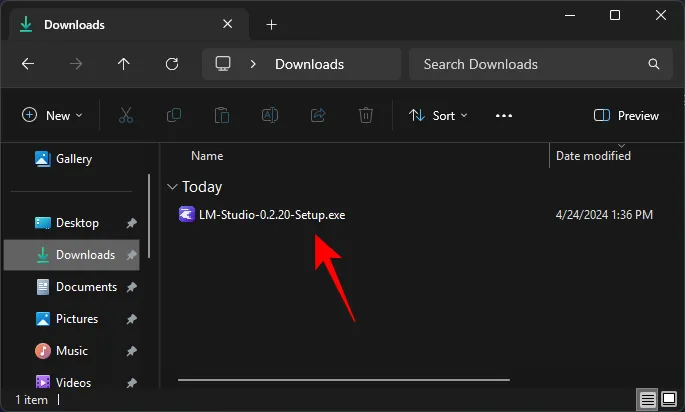

步驟1:安裝LM Studio

- LM工作室| 下載連結

- 使用上面的連結並點擊 LM Studio for Windows 進行下載。

- 下載後,執行安裝程式並安裝 LM Studio。

步驟 2:下載 Phi-3 gguf 文件

您將無法從 LM Studio 本身搜尋和下載 Phi-3。您需要單獨取得 Phi-3 guff 檔案。就是這樣:

- Phi-3-Mini Guff 銼刀 | 下載連結

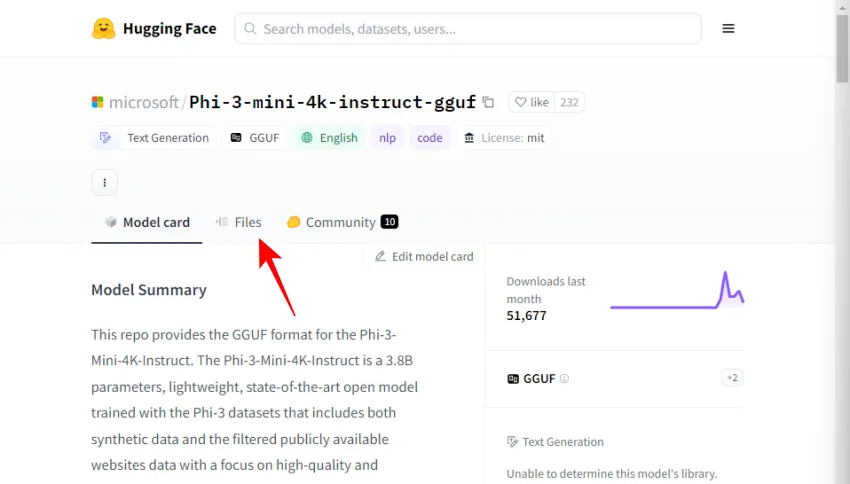

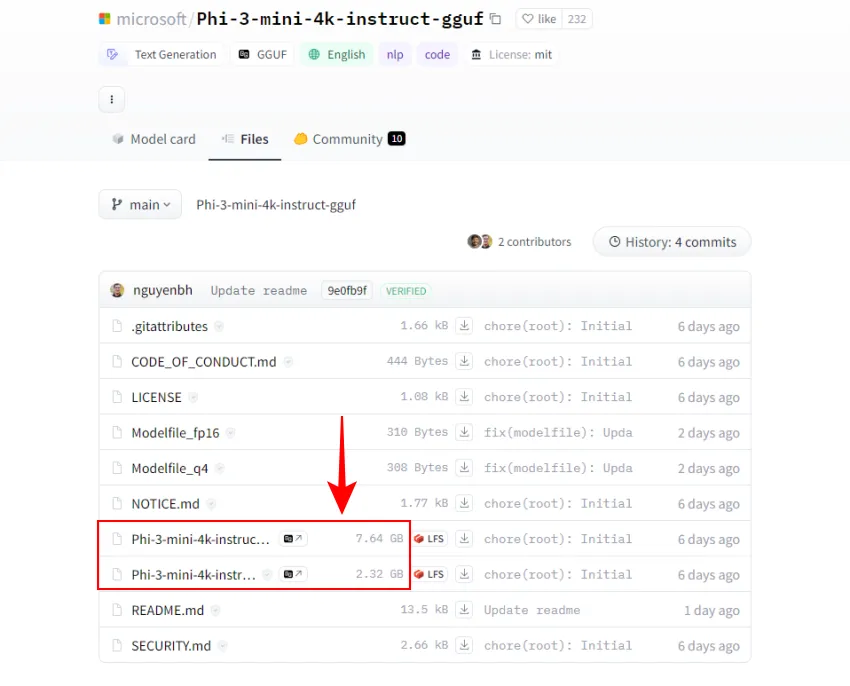

- 使用上面給出的連結並點擊“文件”。

- 在這裡,您會發現 Phi-3 模型的兩個版本。選擇一個。出於我們的目的,我們選擇較小的版本。

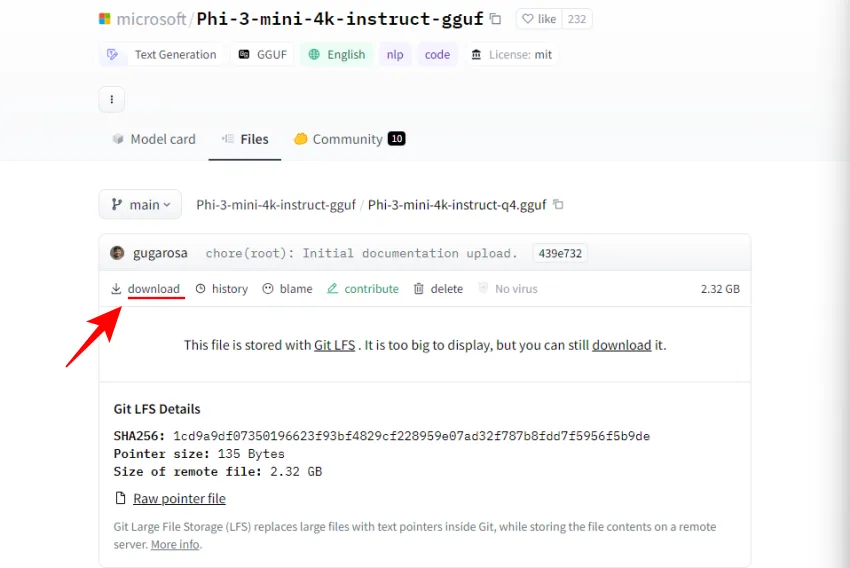

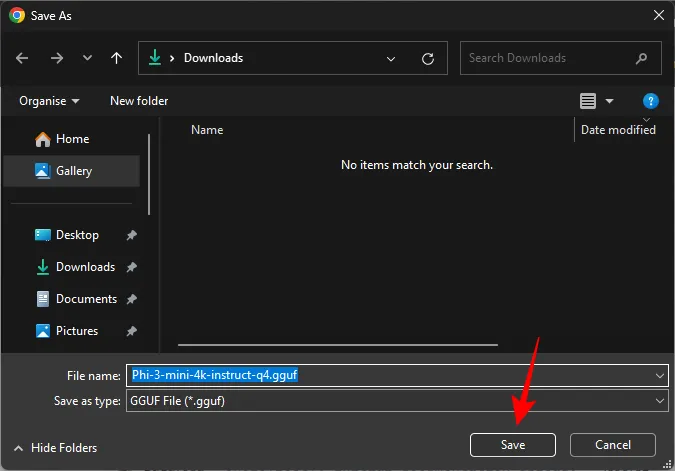

- 按一下“下載”。

- 然後將其保存在方便的位置。

第 3 步:載入 Phi-3 模型

接下來,我們將載入下載的 Phi-3 模型。請依照以下步驟操作:

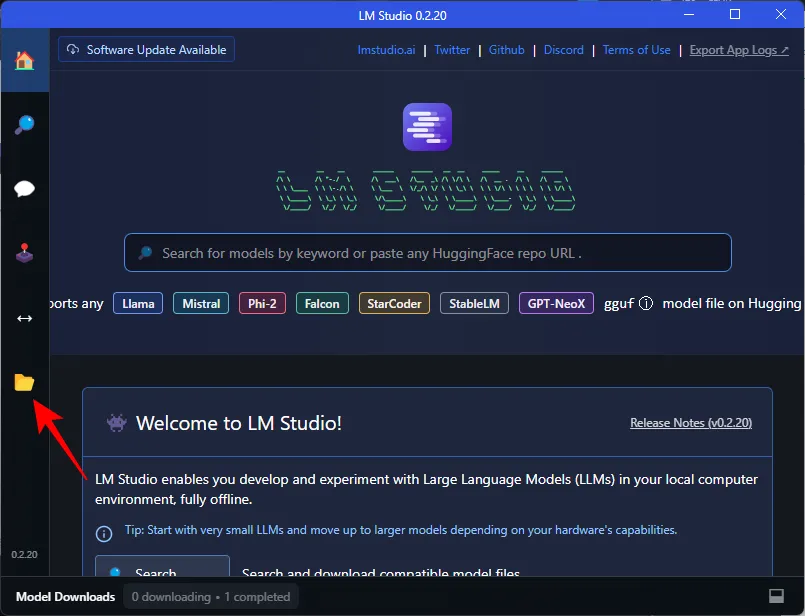

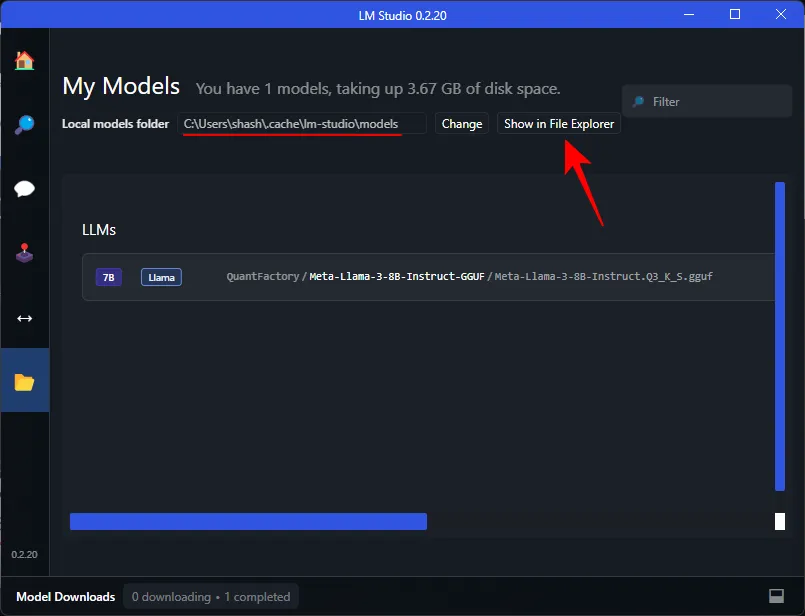

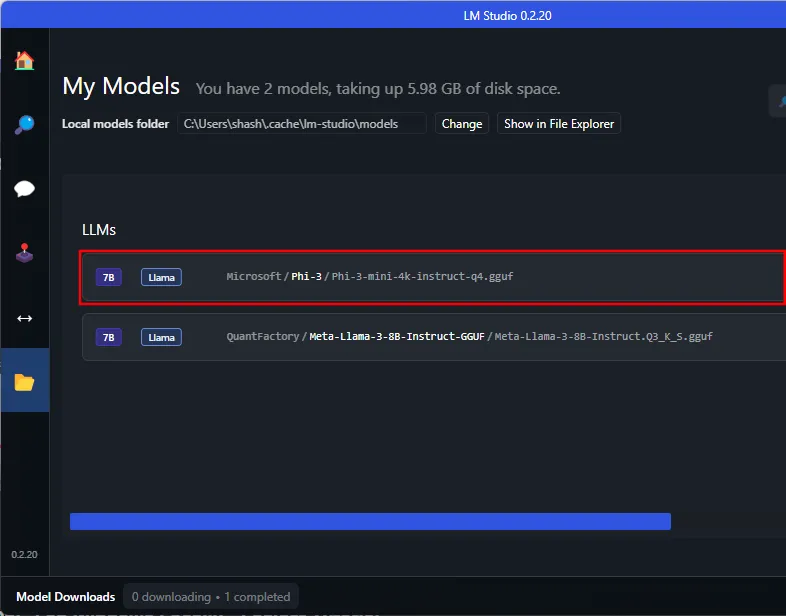

- 開啟 LM Studio 並點擊左側的「我的模型」 。

- 記下「本地模型資料夾」。這是我們需要將下載的 Phi-3 guff 檔案移動到的位置。按一下「在檔案總管中顯示」以開啟該目錄。

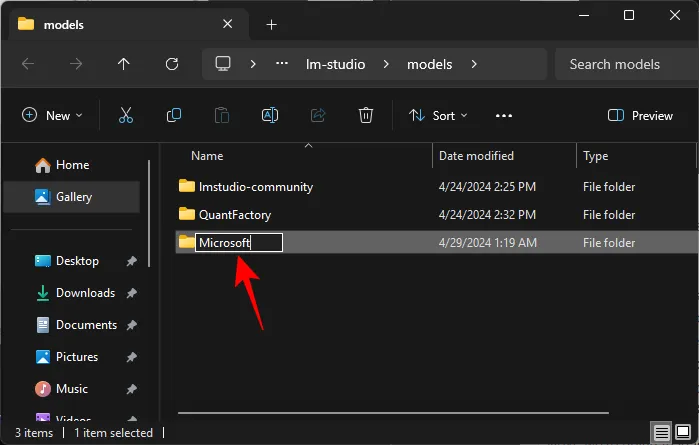

- 在這裡,建立一個名為Microsoft 的新資料夾。

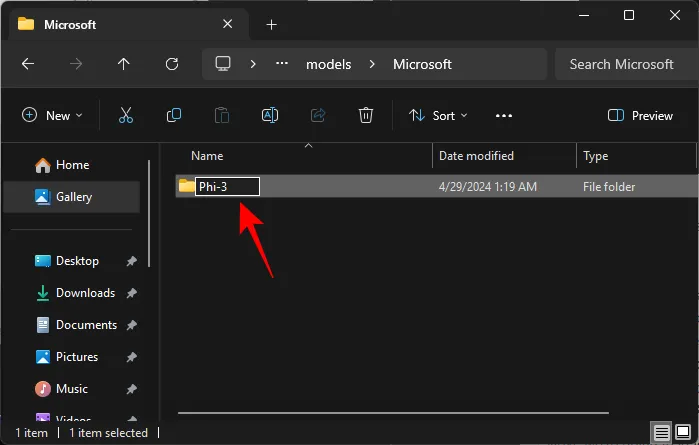

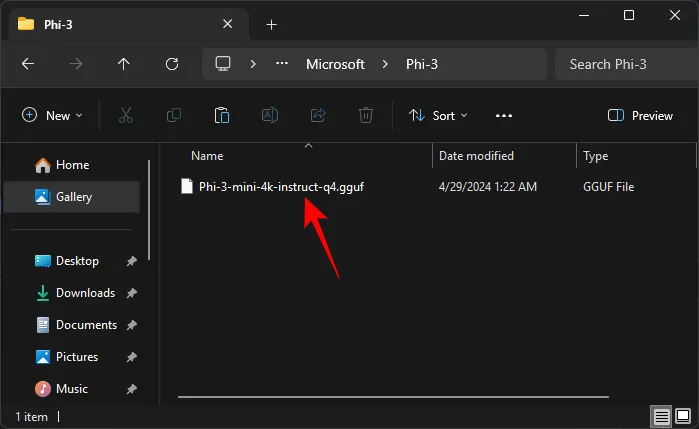

- 在 Microsoft 資料夾中,建立另一個名為Phi-3的資料夾。

- 將下載的 Phi-3 guff 檔案貼到 Phi-3 資料夾中。

- 移動 Phi-3 guff 檔案後,它也會出現在 LM Studio 中。

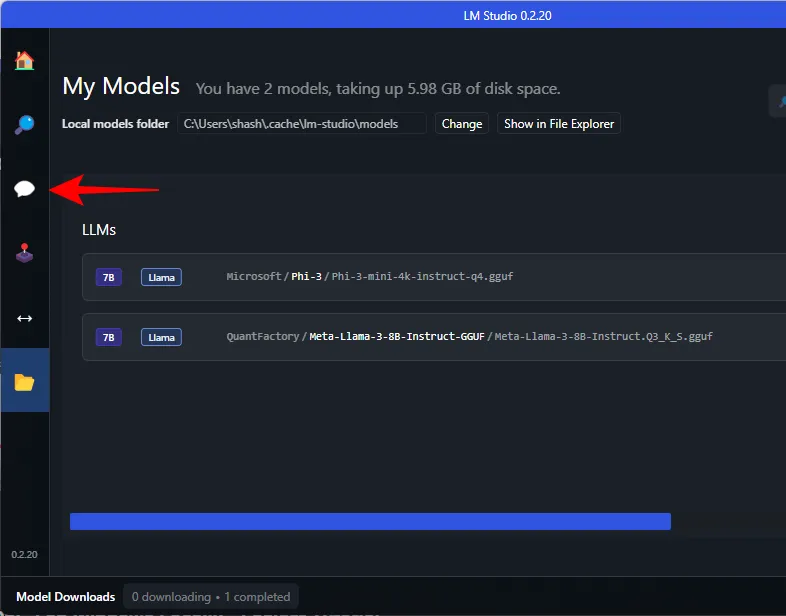

您可能需要重新啟動 LM Studio 才能識別其目錄中的 Phi-3。 - 若要載入 Phi-3 模型,請點選左側的AI Chat選項。

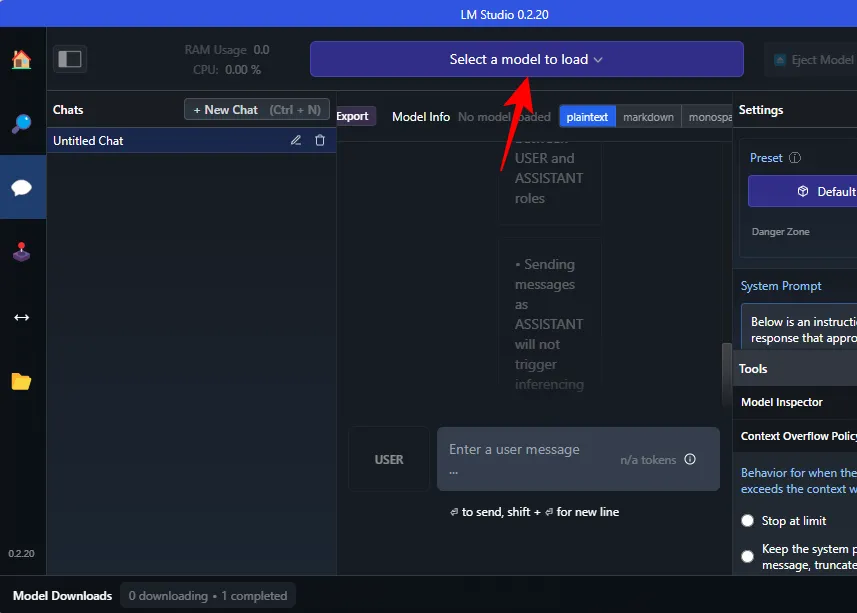

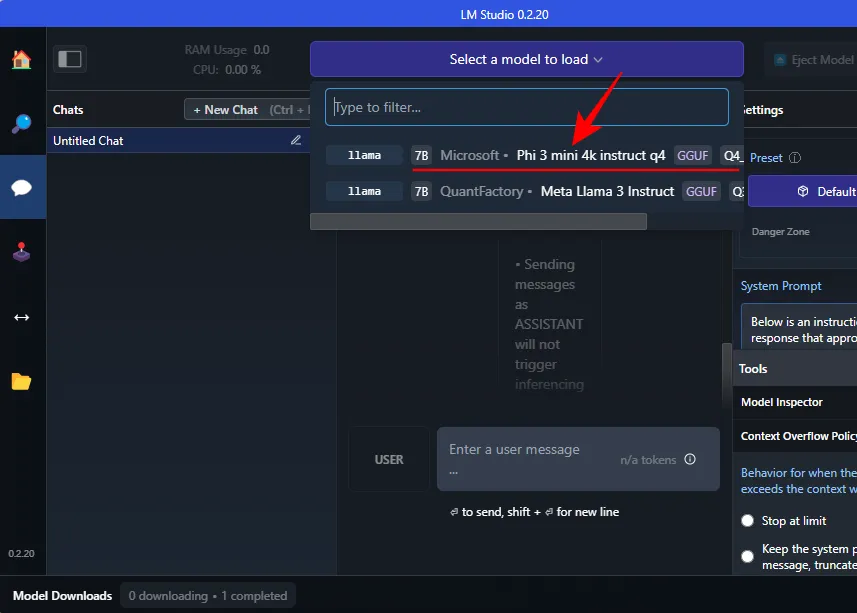

- 按一下選擇要載入的模型。

- 並選擇Phi-3型號。

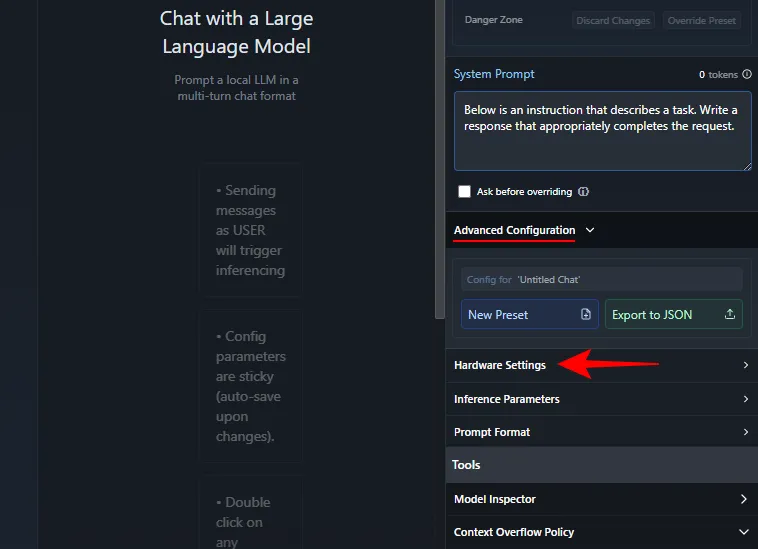

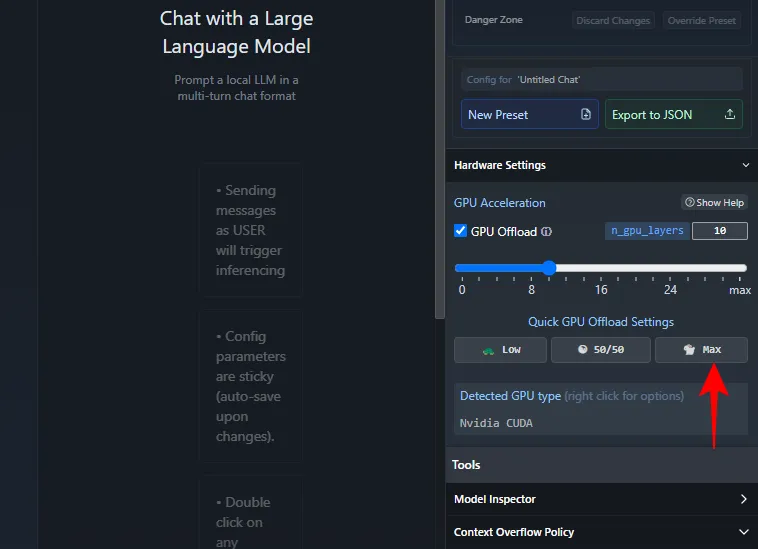

- 等待它加載。完成後,您就可以開始與 Phi-3 聊天。但是,我們建議將模型卸載到 GPU,這樣您的 CPU 就不會承受過度的壓力。為此,請在右側的「系統提示」下,按一下進階配置 > 硬體設定。

- 在“GPU 加速”下,按一下“最大”。

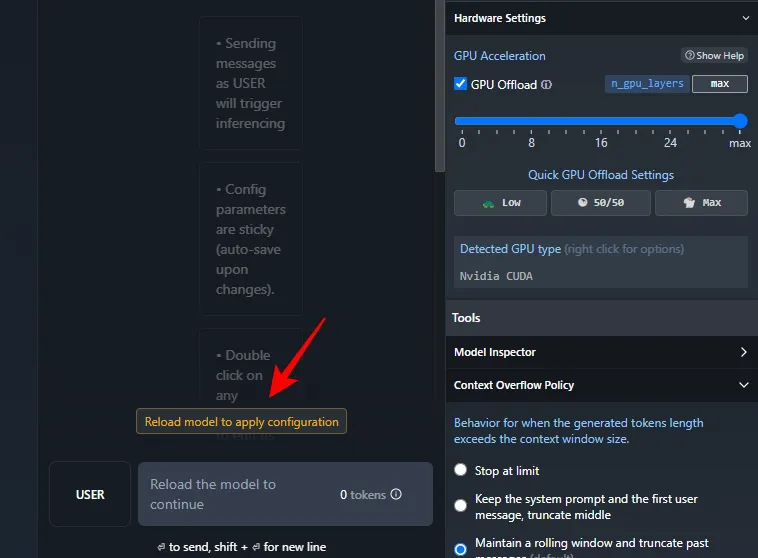

- 點擊重新載入模型以套用配置。

- 模型載入後,您就可以開始與 Phi-3 聊天。

第 4 步:開始與 Microsoft 的 Phi-3 LLM 聊天

就是這樣。繼續並輸入提示。無論您是否有網路連接,您現在都可以在本機 Windows PC 上與 Microsoft 的 Phi-3 模型聊天。

常問問題

讓我們考慮一些有關在 Windows PC 上本地運行 Microsoft Phi-3 的常見問題。

如何解決 Ollama 在下載 Phi-3 時卡住的問題?

如果您在命令提示字元下透過 Ollama 下載 Phi-3 時遇到問題,只需ollama run phi3再次輸入命令即可。下載將從先前的位置恢復。

我們希望本指南協助您透過 Ollama 和 LM Studio 在 Windows PC 上本機執行 Microsoft 的 Phi-3 模型。直到下一次!

發佈留言