如何在 Android 上本地運行 LLM

要知道什麼

- 在您的 Android 裝置上安裝 MLC Chat 之類的應用程序,以在本地與法學碩士進行實驗和聊天。

- 下載可用模型之一,然後點擊「聊天」圖示開始與您選擇的法學碩士聊天。

- MLC 聊天應用程式可讓您下載 Gemma 2b、RedPajama、Llama3、Phi-2、Mistral 和 Llama2。

您可以在 PC 上本地運行多種 LLM。但說到智慧型手機,選擇就稍微有限了。您必須運行小型語言模型或擁有具有足夠處理能力的高級設備來應對法學碩士。無論哪種方式,都可以在本地和離線狀態下與語言模型聊天。

如何在 Android 上本地運行 LLM

大型語言模型很大,並且需要大量的運算能力。但即使您的 Android 裝置有足夠的資源來運行 SLM(小語言模型)和 LLM,您仍然需要一個應用程式來讓您透過使用者友好的介面來試驗它們。

這就是 MLC Chat 這樣的應用程式派上用場的地方。請依照以下步驟,使用 MLC 聊天應用程式在 Android 上本機執行 LLM。

第 1 步:安裝 MLC 聊天應用程式

- MLC 聊天應用程式 | 下載連結

- 首先,點擊上面的連結並下載 MLC 聊天應用程式的 APK。出現提示時,點擊仍然下載。

- 安裝MLCChat 應用程式。完成後,打開它。

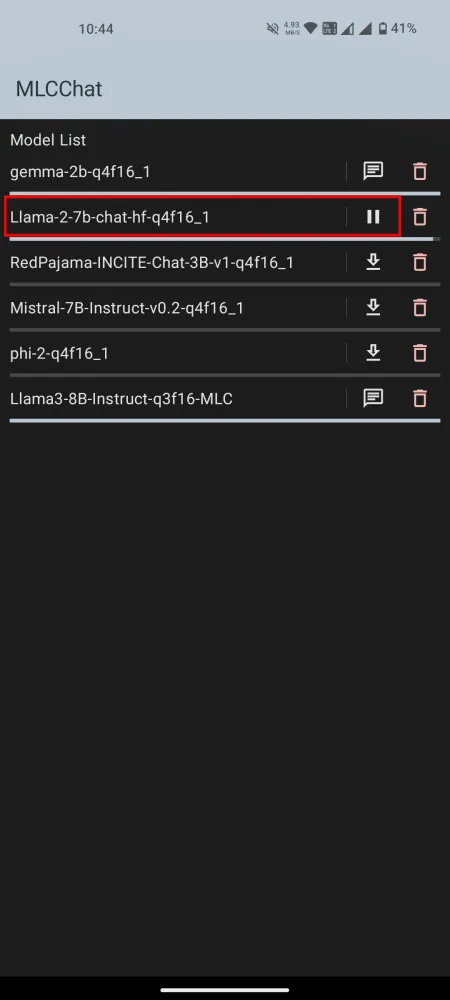

第 2 步:下載 LLM

在 MLCChat 應用程式上,您將看到可供下載的可用模型清單。點擊您喜歡的模型旁邊的下載鏈接,然後等待下載。

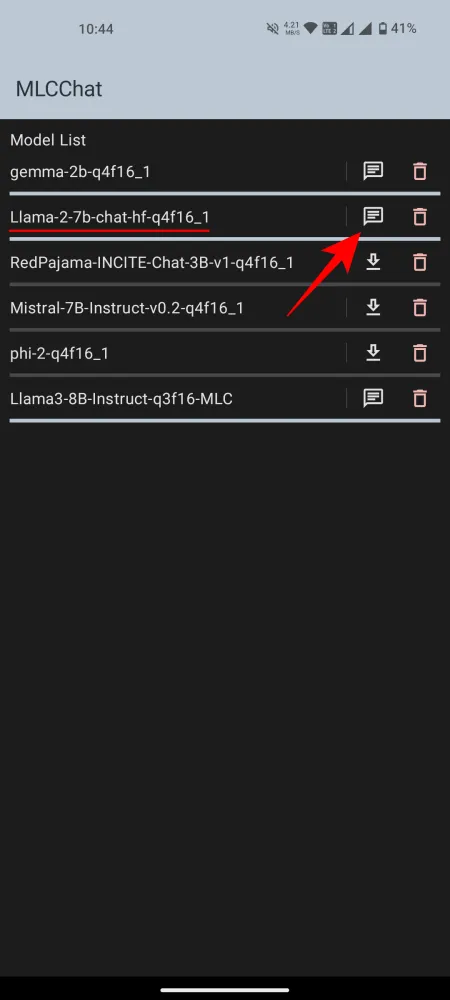

第 3 步:運行已安裝的 LLM

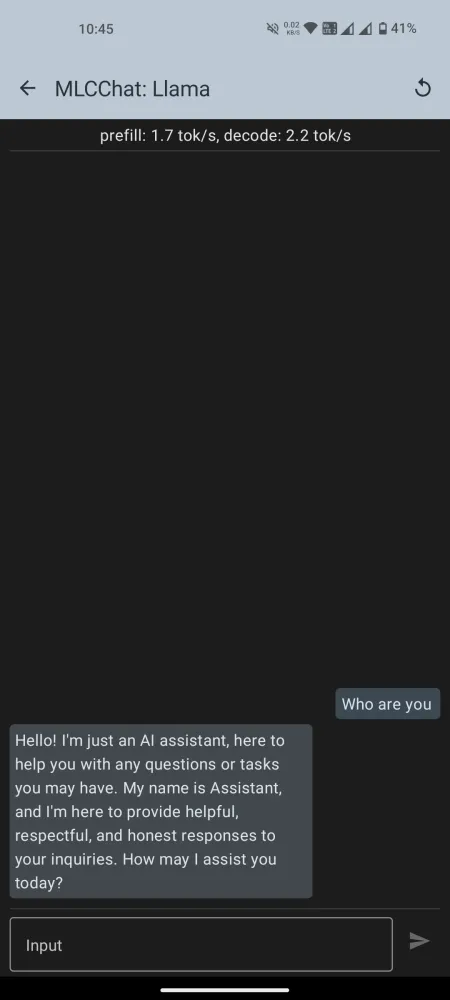

下載後,點擊旁邊的聊天圖示即可開始聊天。等待模型初始化。準備好後,就可以開始與人工智慧聊天了。

請注意,從 MLCChat 應用程式上的可用模型清單中,會有一些模型(例如 Llama3)需要大量處理能力。但您始終可以安裝模型並進行測試,看看它們是否運行得足夠流暢。如果沒有,請嘗試較小的語言模型。

在我們的測試中(在 Nothing Phone 1 上),Gemma-2b 無法加載,而 Llama3 則終止了系統 UI。效果很好的是 Llama-2 和 Phi-2。 LLM 與其他較小語言模型之間的主要區別在於它們訓練的資訊(參數)的廣度。因此,請根據您的需求和 Android 裝置的功能選擇型號。

我們希望您能夠在本機 Android 裝置上安裝並執行 LLM。直到下一次!

發佈留言