利用微軟新功能在 Windows 11 上輕鬆本地運行 AI 模型

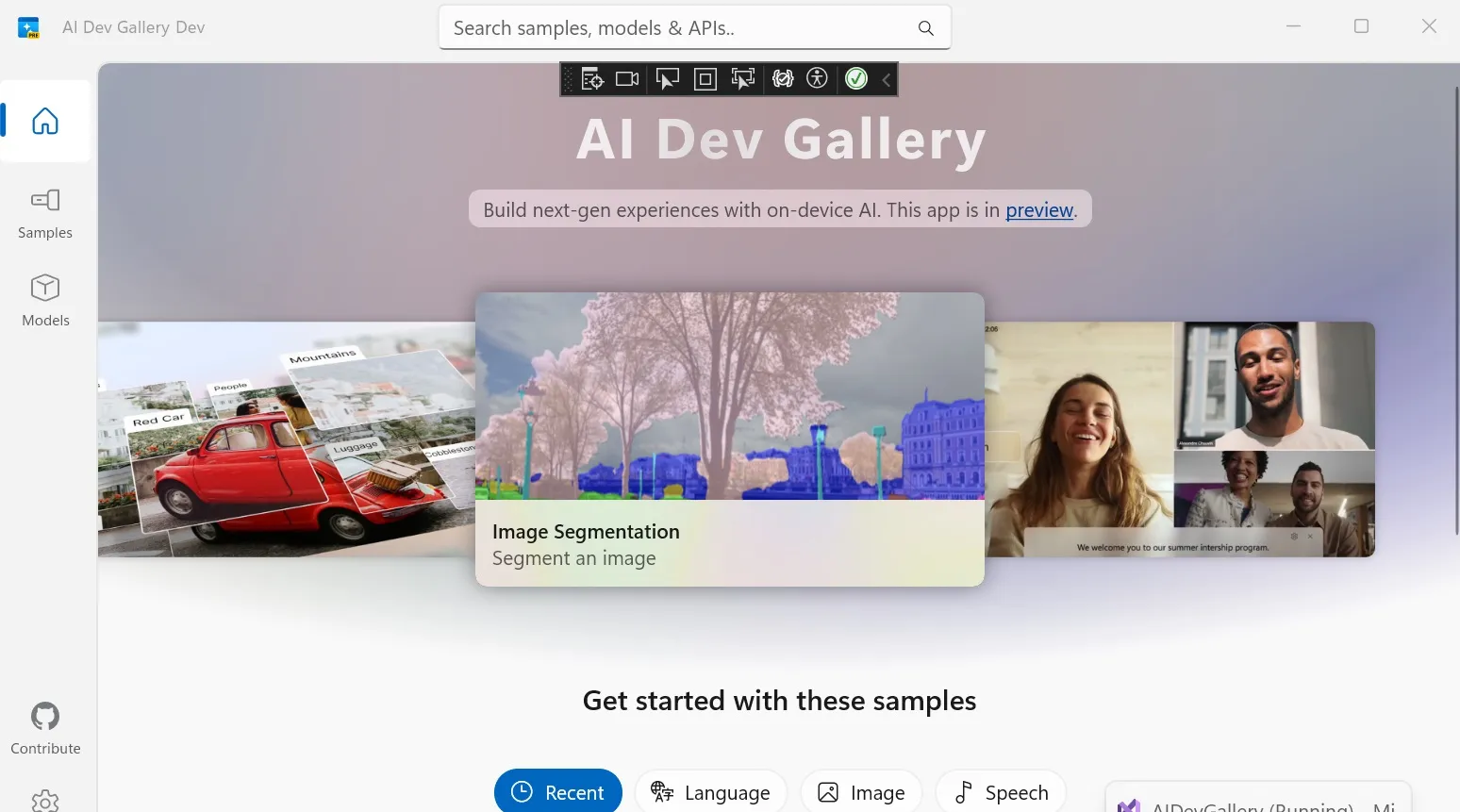

Copilot+ PC 代表了突破性的進步,是首款能夠直接在裝置上執行小語言模型 (SLM) 的電腦。與基於雲端的 Copilot 應用程式相比,這項創新技術具有顯著的優勢,可以更快地為各種任務(例如圖像和文字生成)提供結果。最近,微軟推出了 AI Dev Gallery,它簡化了將裝置上的 AI 功能整合到任何應用程式中的過程。

AI Dev Gallery 專為有興趣測試各種模型以透過 AI 功能增強其應用程式的開發人員而設計。該工具提供對超過 25 個可下載範例的訪問,這些範例可以在您的裝置上輕鬆運行。此外,用戶可以將專案或原始程式碼直接匯出到他們的應用程式中以立即使用功能。它相容於Windows 10和11,支援x64和ARM64架構。

在一項有趣的實驗中,Windows Latest 從其 GitHub 儲存庫複製了 AI Dev Gallery。目前,存取它需要在執行之前透過 Visual Studio 建置專案。此外,至少需要20GB的儲存空間和多核心CPU。儘管建議使用具有 8GB VRAM 的 GPU,但這僅對於要求更高的型號才是必需的。

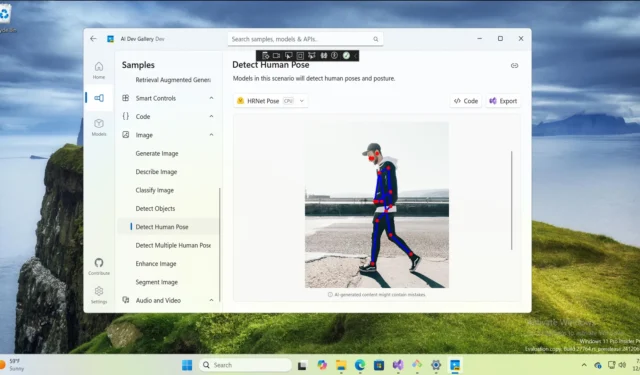

我們使用配備 4 核心 CPU 和 4GB RAM 的 Windows 11 PC 開始測試。該應用程式有兩種操作模式:範例和模型。我們利用範例模式來探索可用的各種模型,這些模型分為文字、圖像、程式碼、音訊和視訊以及智慧控制等類別。

評估模型

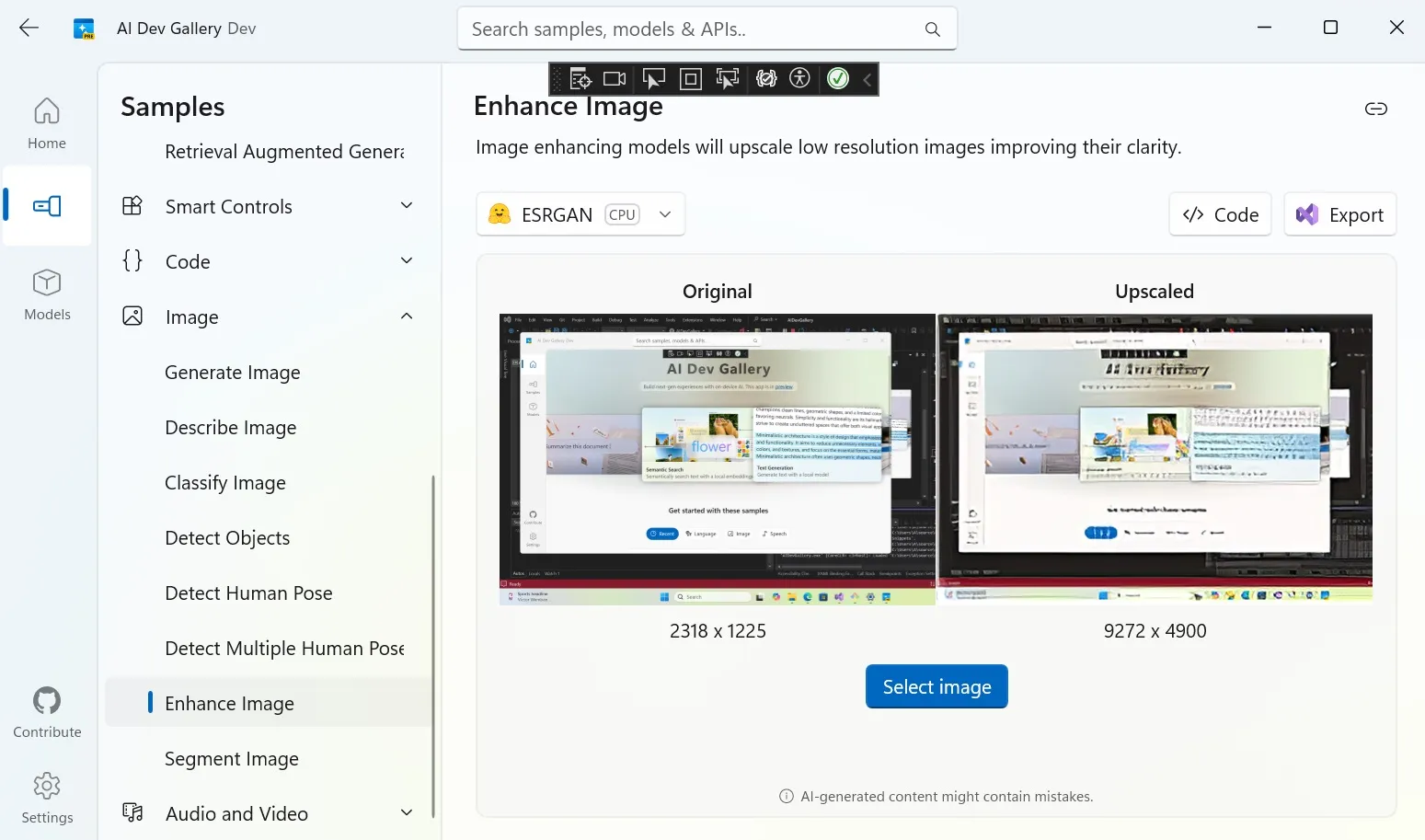

可用於影像和影片產生的模型相對較大,大小接近5GB。我們最初的選擇是專注於升級的較小型號,小於 100MB。我們截取了螢幕截圖並嘗試使用 CPU 進行處理來放大它。值得注意的是,可以選擇在 CPU 和 GPU 之間切換來處理請求。

在這個普通虛擬機器上,升級過程在不到 30 秒的時間內完成,導致 RAM 使用量暫時達到 1GB 峰值。然後應用程式顯示了分辨率為 9272*4900 的放大影像。然而,圖像元素(尤其是文字)的品質受到嚴重損害並且變得不可讀。

不幸的是,沒有可用的功能以更大的格式或全螢幕模式預覽生成的圖像,也沒有將圖像直接下載到磁碟的選項。

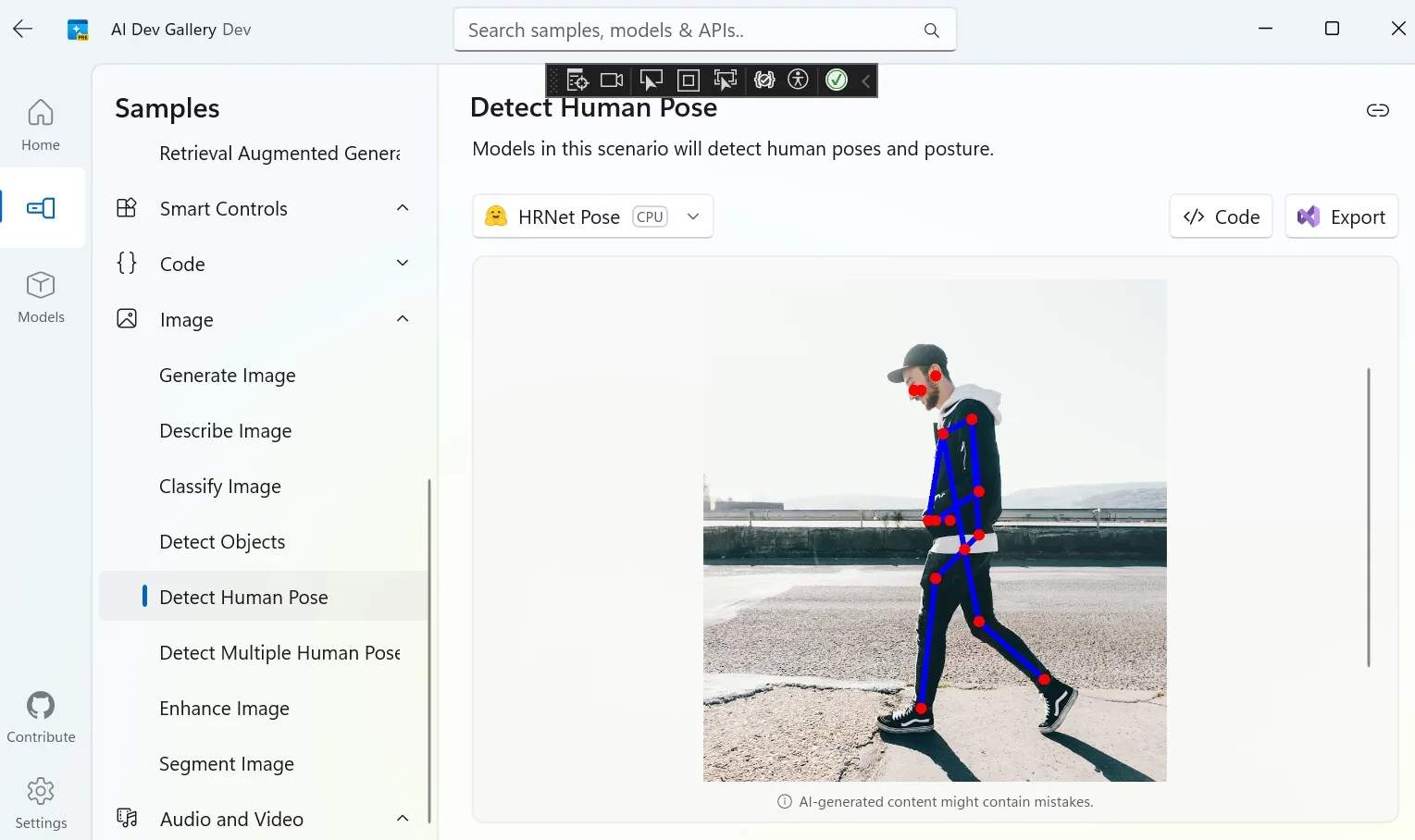

我們繼續測試另一個模型,稱為「偵測人體姿勢」,該模型旨在確定影像中個體的位置。該模型成功識別了一個簡單的行走人物,但也開始在我們的桌面螢幕截圖上顯示位置標記,其中包含多個打開的應用程式。

雖然將這些模型整合到應用程式中的確切方法仍不清楚,但某些功能確實可以在本地運行。然而,這些型號的 PC 需要大量儲存空間,以及強大的 CPU 和至少 16GB 的 RAM。

您對此有何看法?是否值得下載一個巨大的 5GB 模型來將文字提示轉換為圖像,或者使用基於 Web 的應用程式等待 30 秒是否會更有效?顯然,其中許多功能都迎合特定的用例和操作環境,這可能不一定會吸引更廣泛的 Windows 11 使用者群體。

發佈留言