Patente da Microsoft revela tecnologia para evitar alucinações de IA

Um dos maiores obstáculos enfrentados pela inteligência artificial hoje é sua propensão a alucinar, o que significa que ela pode gerar informações enganosas ou fabricadas ao tentar concluir tarefas. Embora a maioria dos sistemas de IA utilize recursos online para fornecer respostas precisas, conversas prolongadas podem, às vezes, levar a IA a confiar em informações infundadas.

No início deste ano, a Microsoft começou a desenvolver uma solução para lidar com alucinações de IA e também lançou um artigo de pesquisa detalhando uma tecnologia patenteada que visa prevenir preventivamente essas imprecisões.

O documento intitulado “Interagindo com um modelo de linguagem usando conhecimento externo e feedback descreve como esse mecanismo funcionaria.

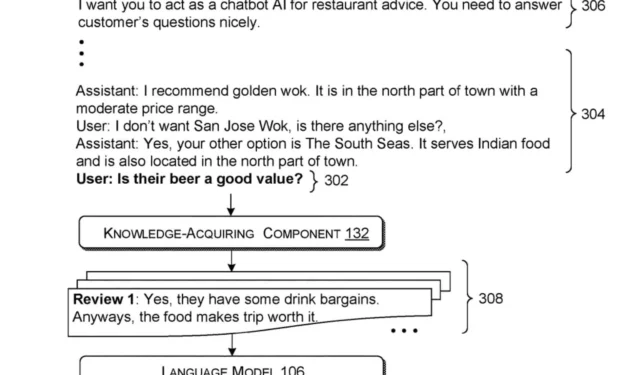

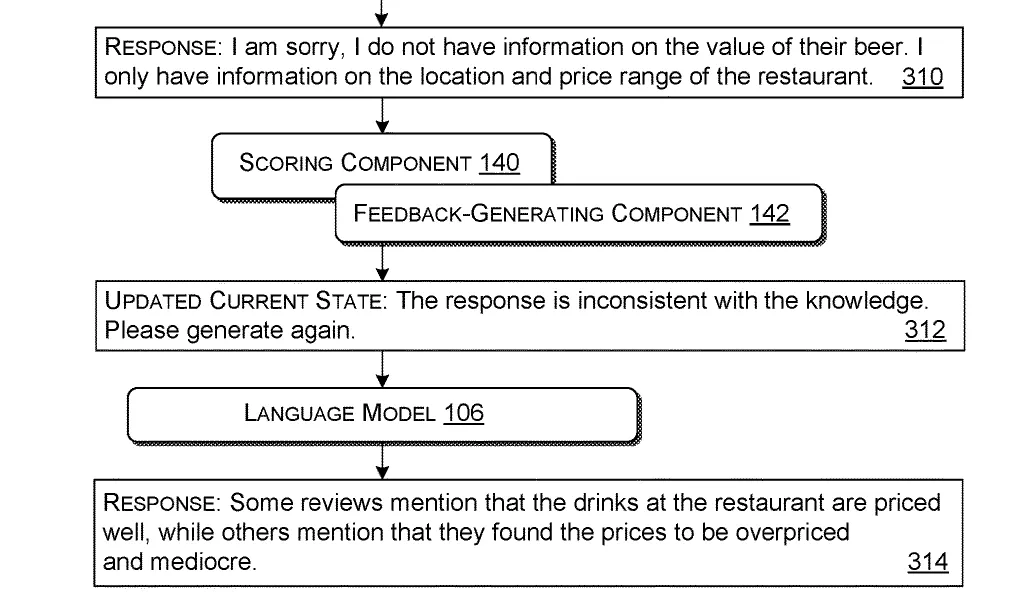

Este sistema opera processando uma consulta — uma pergunta ou solicitação de um usuário. Ele busca informações relevantes de fontes externas com base nessa consulta. Posteriormente, ele sintetiza essas informações junto com a consulta original em um pacote coeso adequado para o modelo de linguagem utilizar.

Uma vez que o pacote é construído, ele é introduzido ao modelo de linguagem, treinado para formular respostas com base na entrada fornecida. O modelo de IA então gera uma resposta inicial baseada neste pacote de entrada.

Para garantir a relevância da resposta, o sistema emprega critérios predefinidos para avaliar se a saída inicial atende aos padrões de utilidade. Caso a primeira resposta não tenha valor (indicativo de alucinações de IA), o sistema constrói um pacote aprimorado de entrada que inclui feedback sobre as informações incorretas ou ausentes.

Essa entrada recém-revisada é realimentada no modelo de linguagem, que então produz uma resposta atualizada com base nessas informações refinadas.

Essa tecnologia inovadora tem potencial não apenas para combater alucinações de IA, mas também para várias aplicações no mundo real. Por exemplo, conforme detalhado no artigo, esse sistema pode ser utilizado por assistentes de IA em restaurantes, permitindo que eles forneçam informações factuais e verificadas aos clientes e adaptem suas respostas com base nas perguntas em evolução dos clientes durante as conversas.

Esse processo iterativo aumenta a precisão e a utilidade das respostas do modelo de linguagem ao refinar continuamente a entrada e o feedback.

Embora atualmente seja apenas uma patente, os conceitos discutidos sugerem que a Microsoft está comprometida em melhorar a funcionalidade e a confiabilidade de seus modelos de IA, como o Copilot.

A gigante da tecnologia já expressou sua ambição de abordar e eliminar alucinações em modelos de IA, destacando um futuro onde informações precisas podem ser geradas de forma confiável em funções como assistência em restaurantes.

Com estratégias para eliminar alucinações, os modelos de IA poderiam fornecer respostas precisas sem recorrer a informações incorretas. Quando pareada com os recursos de voz do mais recente Copilot, a IA poderia substituir empregos de nível básico, como sistemas automatizados de suporte ao cliente.

O que você pensa sobre esse desenvolvimento?

Você pode explorar o artigo completo aqui .

Deixe um comentário