A Microsoft está investigando alguma filtragem agressiva de conteúdo no Bing Image Creator

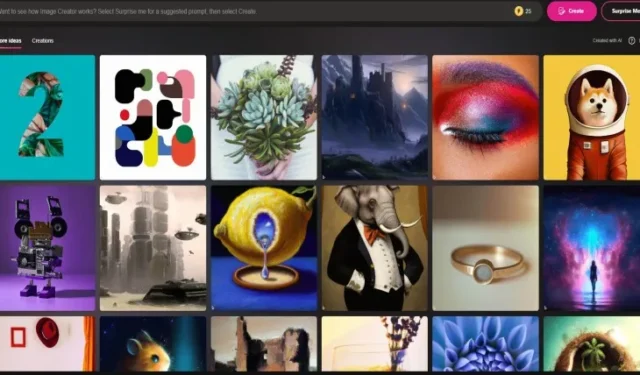

Alguns dias atrás, depois que a Microsoft anunciou que havia adicionado o modelo DALL-E 3 da OpenAI ao seu criador de arte Bing Image Creator, o serviço sofreu enormes lentidão na geração de imagens devido a tantas pessoas querendo experimentá-lo. A Microsoft afirmou que estava adicionando muito mais GPUs em seus data centers para tentar obter imagens mais rapidamente.

Agora, parece que a Microsoft pode ter que lidar com outro problema, já que muitas pessoas online estão recebendo avisos de conteúdo sobre seus prompts de texto no Bing Image Creator, sobre palavras que parecem bastante normais.

Jez Corden escreveu um artigo no Windows Central sobre esse problema atual. Ele afirmou que a frase “homem quebra rack de servidor com marreta” foi sinalizada pelo serviço. Outro usuário do Reddit que digitou “um gato com chapéu de cowboy e botas” também recebeu uma mensagem de violação de conteúdo neste fim de semana.

No entanto, parece que a Microsoft está pelo menos ciente desta situação. Quando uma pessoa no X (anteriormente Twitter) perguntou ao atual chefe do Microsoft Windows, Mikhail Parakhin, sobre essas mensagens de conteúdo agressivo no Bing Image Creator, a resposta curta de Parakhin foi “Hmm. Isso é estranho – verificar”.

Hum. Isso é estranho – verificando

-Mikhail Parakhin (@MParakhin) 8 de outubro de 2023

Parece claro que algo aconteceu com as proteções de conteúdo do Bing Image Creator. No entanto, esta não é a primeira vez que isso acontece. Logo depois que a Microsoft lançou o criador de arte de IA em março , ela foi tão agressiva no monitoramento de conteúdo desde o início que apenas digitar a palavra “Bing” acionaria uma mensagem de violação .

Na época, Parakhin escreveu que isso era realmente intencional para o lançamento, afirmando no X , “estamos cientes de que o Bing Image Creator é excessivamente restritivo com consultas confidenciais, tinha que estar do lado seguro no lançamento”. seja intencional, então espero que isso seja corrigido em breve.

Deixe um comentário