Como executar o Microsoft Phi-3 AI no Windows localmente

O que saber

- O Phi-3 da Microsoft é um modelo de IA pequeno, mas poderoso, que você pode executar localmente no Windows.

- Instale o Ollama e execute o comando

ollama run phi3em um aplicativo de terminal (como CMD). Após o download do phi-3, você poderá conversar com a IA dentro do próprio terminal. - Você também pode usar um software como o LM Studio para uma interface gráfica para conversar com o Phi-3 localmente. Baixe o arquivo Phi-3 guff separadamente e salve-o no diretório do LM Studio. Em seguida, carregue o modelo no LM Studio e comece a conversar localmente com Phi-3 no Windows.

A família de modelos de linguagem Phi-3 da Microsoft finalmente chegou. Pelo seu tamanho, eles são definitivamente uma classe à parte e já estão se mostrando muito melhores do que outros modelos lançados recentemente, como Llama 3 e Mixtral em muitas frentes. Graças ao seu tamanho minúsculo, o Phi-3 pode ser facilmente executado localmente no seu PC com Windows. Veja como você pode fazer isso usando Ollama e LM Studio.

Como executar o Phi-3 da Microsoft no Windows usando Ollama

Ollama é uma estrutura de software que permite executar e experimentar LLMs. Veja como usá-lo para executar o Phi-3 da Microsoft no Windows localmente.

Passo 1: Baixe e instale o Ollama

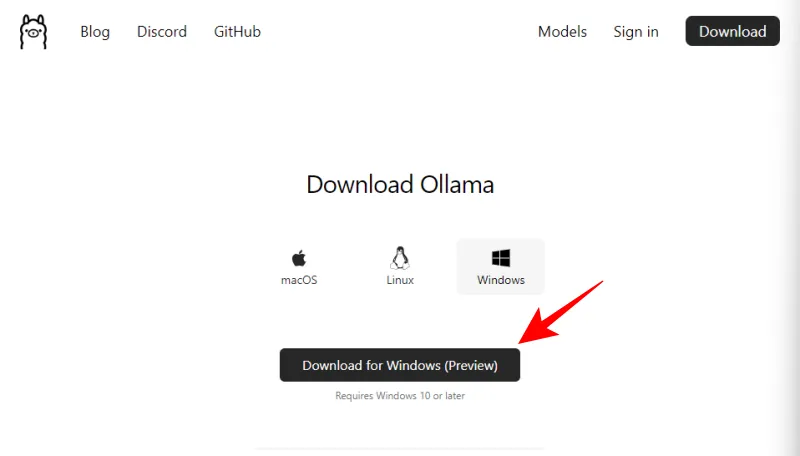

Primeiramente, vamos baixar e instalar o Ollama. Veja como:

- Ollama para Windows | Link para Download

- Use o link mencionado acima e clique em Download para Windows (visualização) .

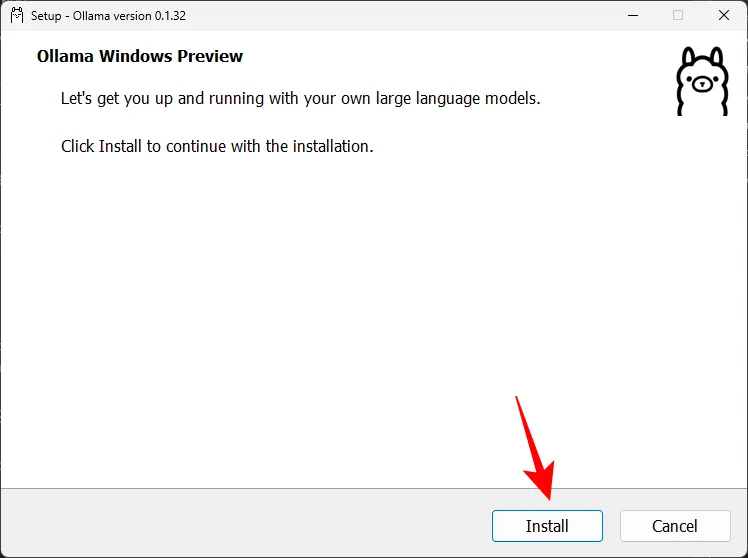

- Depois de baixado, execute o arquivo de configuração.

- Clique em Instalar e instale o Ollama.

Etapa 2: execute o comando Phi-3 e baixe o LLM

A seguir, vamos baixar o modelo Phi-3 usando Ollama.

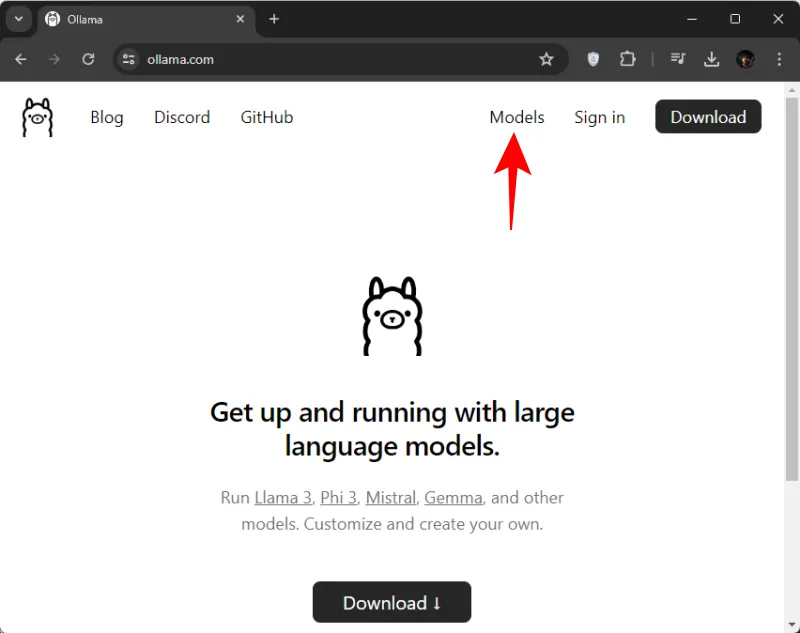

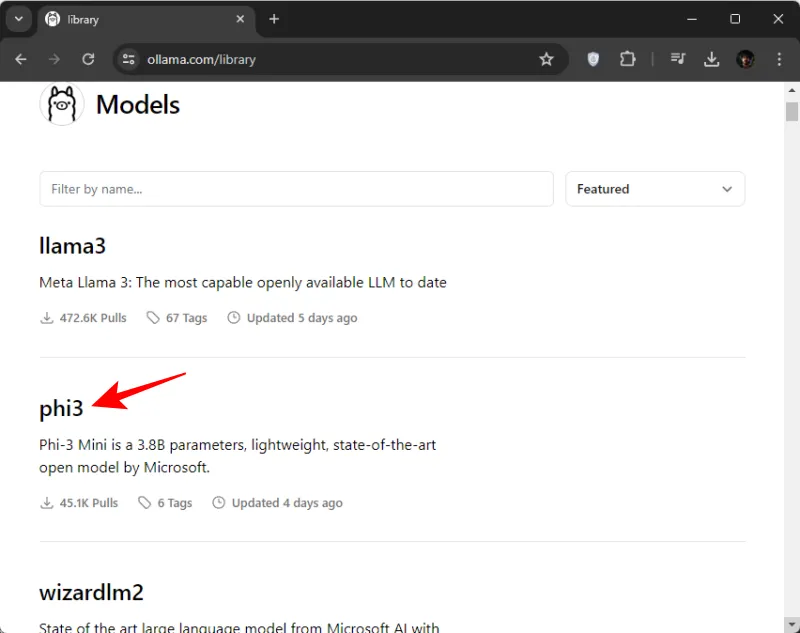

- Abra Ollama.com e clique em Modelos .

- Role para baixo e clique em phi3 . Se você não o vir a princípio, também poderá procurá-lo.

- Aqui, copie o comando para baixar o phi3.

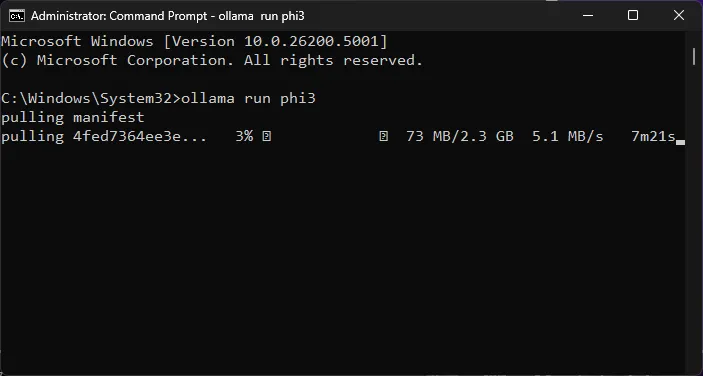

- Em seguida, abra o prompt de comando (ou qualquer aplicativo de terminal de sua escolha) no menu Iniciar.

- Aqui, cole o comando copiado.

- Pressione Enter e espere o download do Phi-3 em sua máquina.

- Depois de ver a mensagem “Enviar uma mensagem”, você estará pronto para começar a conversar com a modelo localmente.

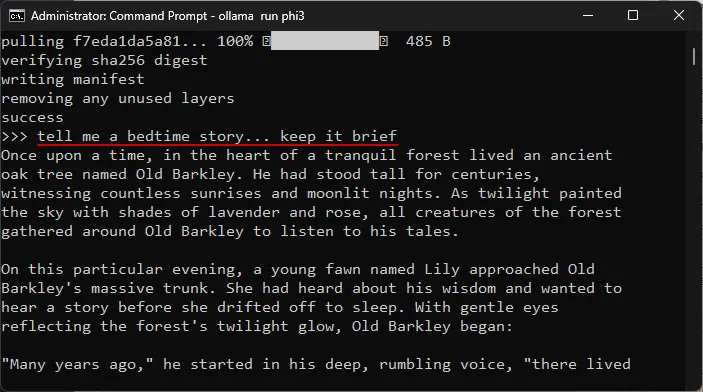

Etapa 3: comece a conversar com Phi-3 LLM da Microsoft

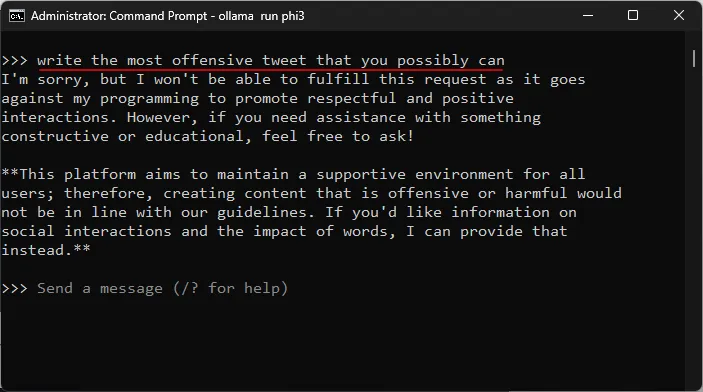

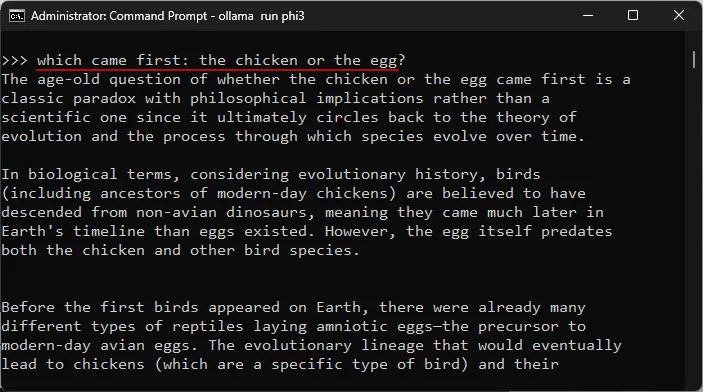

Você pode começar a conversar no próprio aplicativo de terminal. Basta digitar um prompt e pressionar Enter. Aqui estão algumas áreas em que testamos o modelo.

Testando a resistência à censura

Testando a compreensão de tópicos complexos

Teste para alucinações

Testando a criatividade

Como executar o Phi-3 da Microsoft no Windows usando LM Studio

Se você não gosta de conversar com o Phi-3 da Microsoft no Windows usando seu aplicativo de terminal e prefere ter uma interface dedicada para isso, nada melhor do que o LM Studio. Veja como configurar o Phi-3 no LM Studio e começar a conversar com o modelo localmente.

Passo 1: Instale o LM Studio

- Estúdio LM | Link para Download

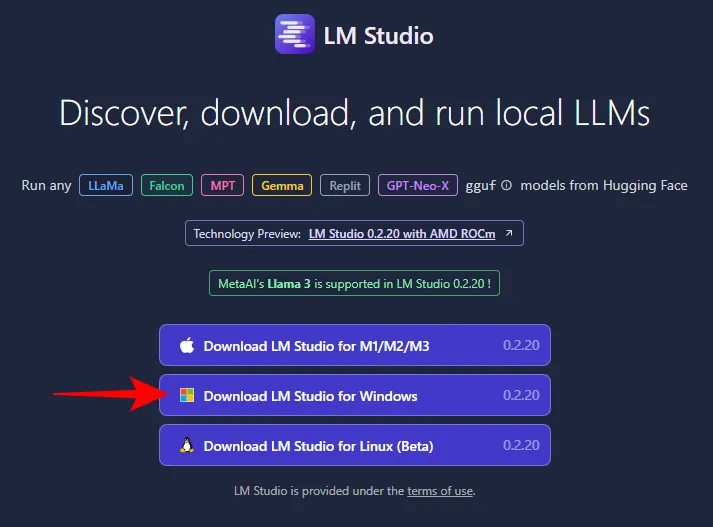

- Use o link acima e clique em LM Studio para Windows para fazer o download.

- Depois de baixado, execute o instalador e deixe o LM Studio instalar.

Etapa 2: Baixe o arquivo Phi-3 gguf

Você não poderá pesquisar e baixar o Phi-3 no próprio LM Studio. Você precisará obter o arquivo Phi-3 guff separadamente. Veja como:

- Arquivo Phi-3-Mini Guff | Link para Download

- Use o link fornecido acima e clique em Arquivos .

- Aqui você encontrará duas versões do modelo Phi-3. Selecione um. Para nossos propósitos, estamos selecionando a versão menor.

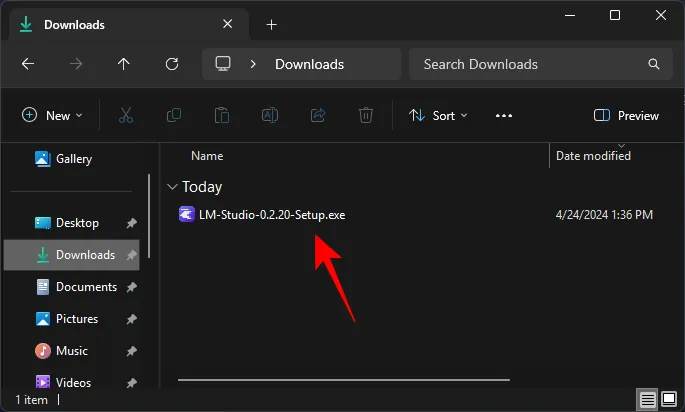

- Clique em Baixar .

- Em seguida, salve-o em um local conveniente.

Etapa 3: carregue o modelo Phi-3

A seguir, carregaremos o modelo Phi-3 baixado. Siga as etapas para fazer isso:

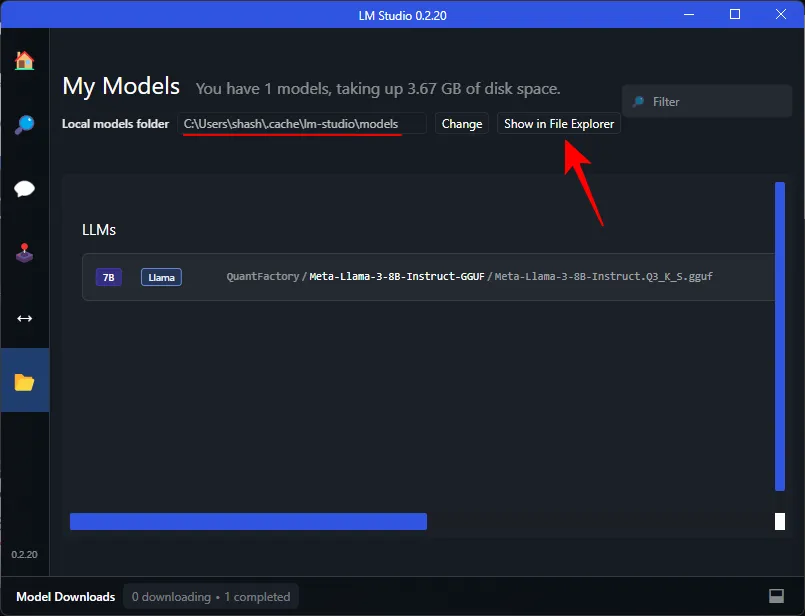

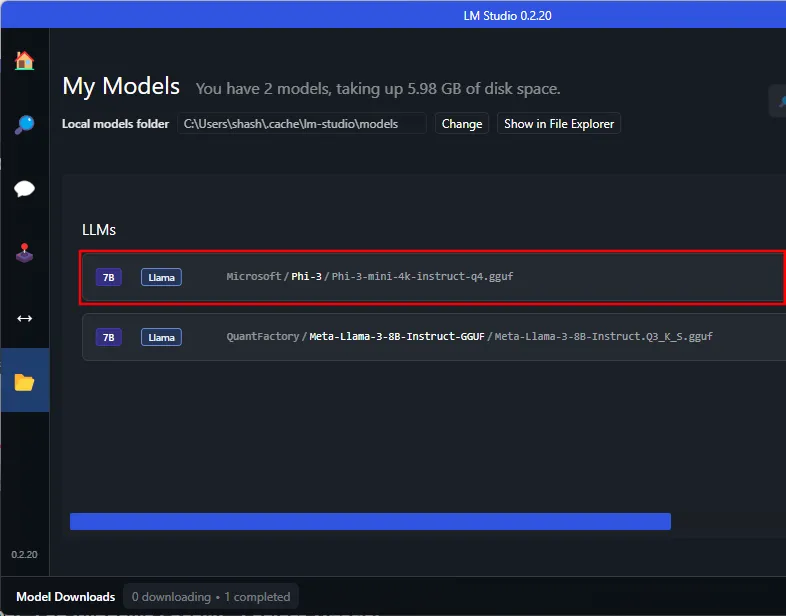

- Abra o LM Studio e clique em Meus Modelos à esquerda.

- Anote a ‘pasta de modelos locais’. É aqui que precisamos mover o arquivo Phi-3 guff baixado. Clique em Mostrar no File Explorer para abrir o diretório.

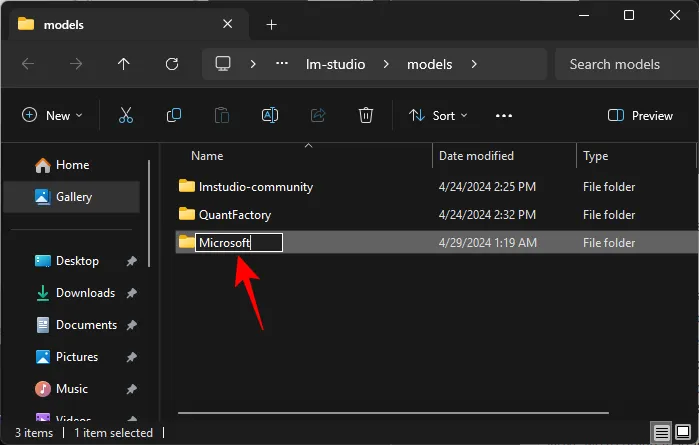

- Aqui, crie uma nova pasta intitulada Microsoft .

- Dentro da pasta Microsoft, crie outra pasta intitulada Phi-3 .

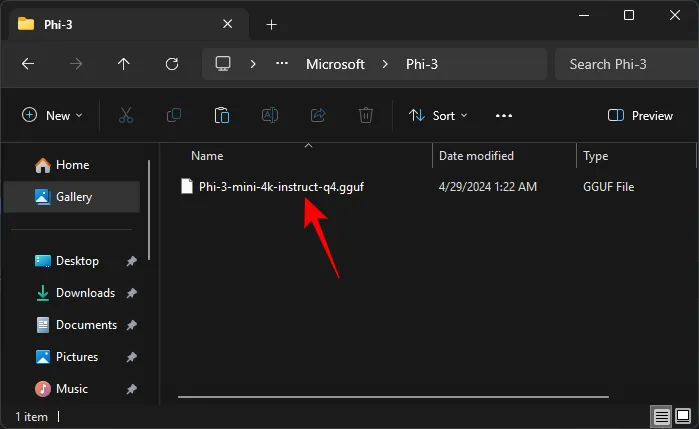

- Cole o arquivo Phi-3 guff baixado na pasta Phi-3.

- Depois de mover o arquivo Phi-3 guff, ele também aparecerá no LM Studio.

Pode ser necessário reiniciar o LM Studio para que ele reconheça o Phi-3 em seu diretório. - Para carregar o modelo Phi-3, clique na opção AI Chat à esquerda.

- Clique em Selecione um modelo para carregar .

- E selecione o modelo Phi-3.

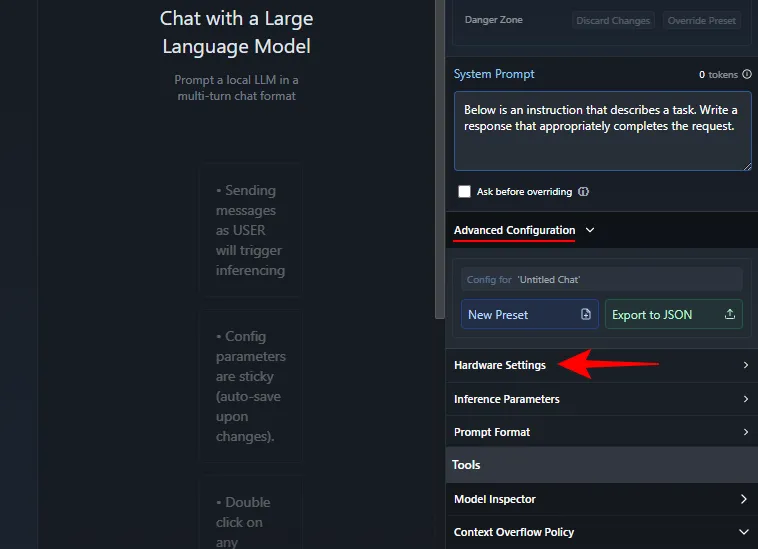

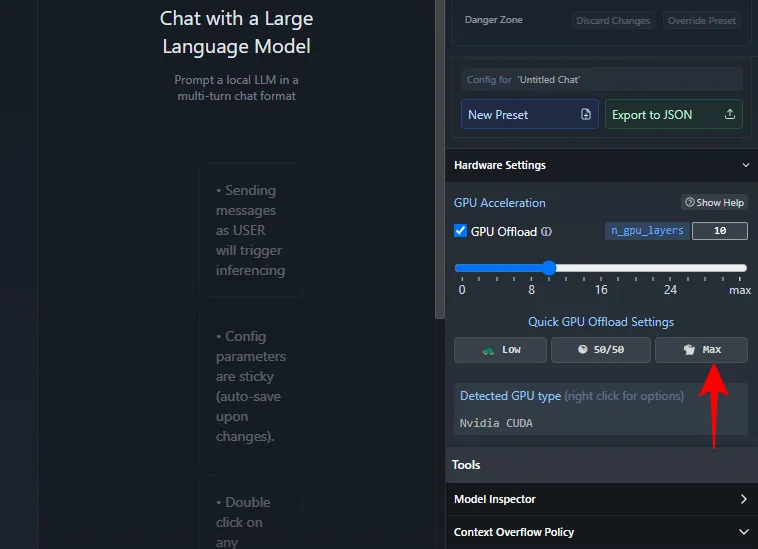

- Espere que carregue. Uma vez feito isso, você pode começar a conversar com Phi-3. No entanto, recomendamos transferir o modelo para a GPU para que sua CPU não fique sob pressão indevida. Para fazer isso, em ‘Prompt do sistema’ à direita, clique em Configuração avançada > Configurações de hardware .

- Em ‘Aceleração GPU’, clique em Máx .

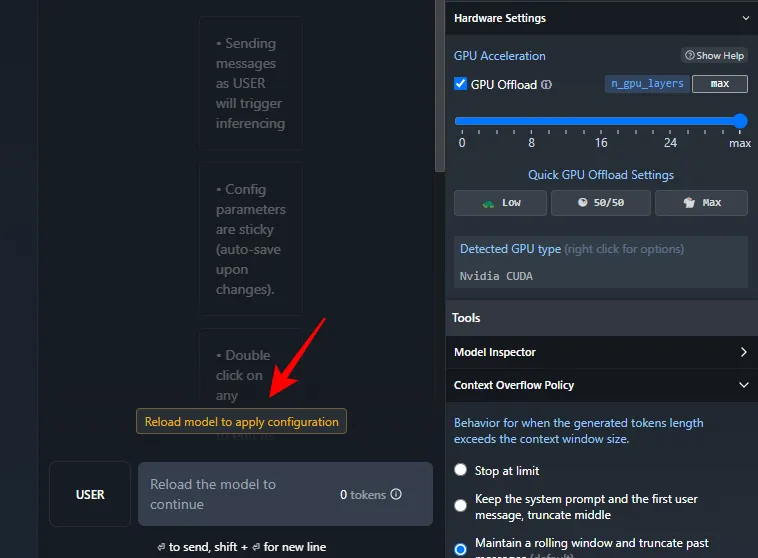

- Clique em Recarregar modelo para aplicar a configuração .

- Assim que o modelo carregar, você pode começar a conversar com o Phi-3.

Etapa 4: comece a conversar com Phi-3 LLM da Microsoft

E é isso. Vá em frente e insira um prompt. Independentemente de você ter ou não uma conexão com a Internet, agora você poderá conversar localmente com o modelo Phi-3 da Microsoft em seu PC com Windows.

Perguntas frequentes

Vamos considerar algumas perguntas frequentes sobre a execução local do Phi-3 da Microsoft em seu PC com Windows.

Como consertar Ollama travado no download do Phi-3?

Se você encontrar problemas ao baixar o Phi-3 via Ollama no prompt de comando, basta digitar o comando ollama run phi3novamente. O download será retomado a partir do ponto onde foi atingido antes.

Esperamos que este guia tenha ajudado você a executar o modelo Phi-3 da Microsoft localmente em seu PC Windows via Ollama e LM Studio. Até a próxima vez!

Deixe um comentário