Najlepsze bezpłatne narzędzia do uruchamiania LLM lokalnie na komputerze z systemem Windows 11

Czy chcesz zachować bezpieczeństwo swoich danych i upewnić się, że pozostaną na Twoim urządzeniu? Wiele usług LLM opartych na chmurze narzuca stałe opłaty abonamentowe powiązane z korzystaniem z API. Ponadto osoby mieszkające w odległych lokalizacjach lub te, które mają niestabilny dostęp do Internetu, często nie preferują tych rozwiązań w chmurze. Jakie są więc dostępne alternatywy?

Na szczęście wykorzystanie lokalnych narzędzi LLM może pomóc wyeliminować te wydatki, umożliwiając użytkownikom obsługę modeli bezpośrednio na ich osobistym sprzęcie. Narzędzia te umożliwiają przetwarzanie danych bez połączenia internetowego, zapewniając, że Twoje informacje pozostaną niedostępne dla zewnętrznych serwerów. Ponadto zapewniają interfejs dostosowany specjalnie do Twojego przepływu pracy.

W tym przewodniku znajdziesz listę bezpłatnych lokalnych narzędzi LLM dostosowanych do Twoich potrzeb w zakresie prywatności, przystępności cenowej i wydajności.

Najlepsze darmowe narzędzia LLM dla komputerów z systemem Windows 11

Poniżej znajdziesz kilka wyjątkowych, bezpłatnych narzędzi LLM, które przeszły gruntowne testy i ocenę.

- Styczeń

- Studio LM

- GPT4ALL

- WszystkoLLM

- Być

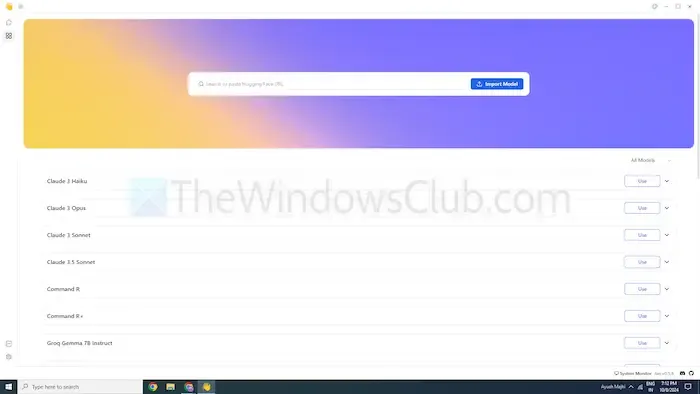

1] styczeń

Jeśli znasz ChatGPT, Jan to podobne narzędzie zaprojektowane do pracy w trybie offline. Działa wyłącznie na Twoim urządzeniu, umożliwiając Ci prywatne tworzenie, analizowanie i przetwarzanie tekstu w Twojej sieci lokalnej.

Jan oferuje modele najwyższej klasy, takie jak Mistral, Nvidia lub OpenAI, umożliwiające korzystanie bez wysyłania danych na serwery zewnętrzne. Dzięki temu jest to doskonały wybór dla użytkowników, którzy stawiają bezpieczeństwo danych na pierwszym miejscu, a nie opcje oparte na chmurze.

Cechy

- Modele wstępnie skonfigurowane: wyposażone w gotowe do użycia modele AI, które nie wymagają dodatkowej instalacji.

- Personalizacja: Możesz spersonalizować kolory pulpitu, wybierając motyw jednolity lub półprzezroczysty.

- Sprawdzanie pisowni: Użyj tej funkcji, aby poprawić błędy ortograficzne.

Zalety

- Umożliwia importowanie modeli za pomocą źródła Hugging Face.

- Obsługuje rozszerzenia umożliwiające większą personalizację.

- Całkowicie darmowe użytkowanie.

Wady

- Ograniczone wsparcie społeczności, skutkujące mniejszą liczbą dostępnych samouczków i zasobów.

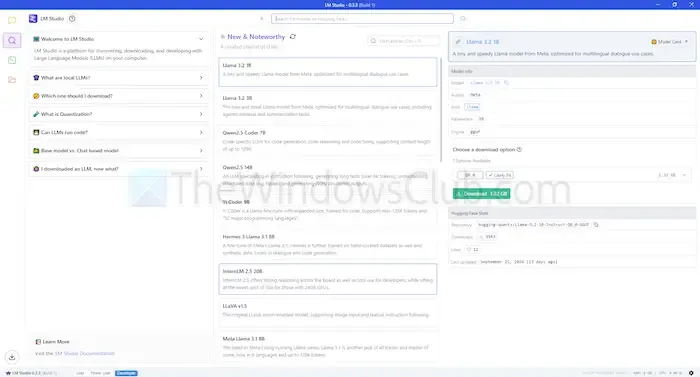

2] Studio LM

LM Studio to kolejne lokalne narzędzie LLM, które pozwala na wykorzystanie modeli językowych, takich jak ChatGPT, bezpośrednio na Twoim komputerze. Oferuje zaawansowane modele, które zwiększają Twoją zdolność rozumienia i odpowiadania na zapytania, precyzyjnie utrzymując lokalizację dla lepszej prywatności i kontroli.

To narzędzie może podsumowywać dokumenty, generować treści, udzielać odpowiedzi, a nawet pomagać w programowaniu — wszystko to podczas pracy lokalnej. Możesz ocenić zgodność różnych modeli z systemem przed wdrożeniem, zapewniając efektywne wykorzystanie czasu i zasobów.

Cechy

- Przesyłanie plików i integracja RAG: Przesyłaj różne typy dokumentów, takie jak PDF, DOCX, TXT i CSV, aby otrzymywać dostosowane odpowiedzi.

- Szerokie możliwości personalizacji: Wybierz spośród wielu motywów kolorystycznych i poziomów złożoności interfejsu.

- Bogactwo zasobów: udostępnia użytkownikom dokumentację i materiały edukacyjne.

Zalety

- Zgodny z systemami Linux, Mac i Windows.

- Konfiguracja serwera lokalnego dostępna dla programistów.

- Oferuje starannie dobrany wybór modeli językowych.

Wady

- Może stanowić wyzwanie dla początkujących, szczególnie na początku konfiguracji.

3] GPT4ALL

GPT4ALL to kolejne zaawansowane narzędzie LLM zaprojektowane do działania bez konieczności połączenia internetowego lub integracji API. Ta aplikacja jest w stanie działać bez GPU, chociaż może je wykorzystać, jeśli są dostępne, dzięki czemu jest dostępna dla szerokiej gamy użytkowników. Obsługuje różne architektury LLM, zapewniając zgodność z wieloma modelami i frameworkami open-source.

To narzędzie wykorzystuje llama.cpp jako zaplecze, zwiększając wydajność zarówno na procesorach CPU, jak i GPU bez konieczności korzystania z zasobów obliczeniowych wysokiej klasy. GPT4ALL działa bezproblemowo zarówno z procesorami Intel, jak i AMD, co pozwala mu wykorzystywać GPU do zoptymalizowanych prędkości przetwarzania.

Cechy

- Integracja plików lokalnych: Modele mogą wyszukiwać i wchodzić w interakcje z lokalnymi dokumentami, takimi jak pliki PDF lub pliki tekstowe, za pośrednictwem Dokumentów lokalnych.

- Oszczędność pamięci: Wiele modeli jest dostępnych w wersjach 4-bitowych, co pozwala ograniczyć wymagania dotyczące pamięci i przetwarzania.

- Ogromne repozytorium modeli: GPT4ALL hostuje ponad 1000 modeli typu open source z repozytoriów takich jak Hugging Face.

Zalety

- Oprogramowanie typu open source i transparentność w działaniu.

- Oferuje konkretne rozwiązania dostosowane do potrzeb przedsiębiorstw, umożliwiające wykorzystanie sztucznej inteligencji w trybie offline.

- Duży nacisk położono na prywatność użytkowników.

Wady

- Ograniczone wsparcie dla procesorów ARM, takich jak te stosowane w Chromebookach.

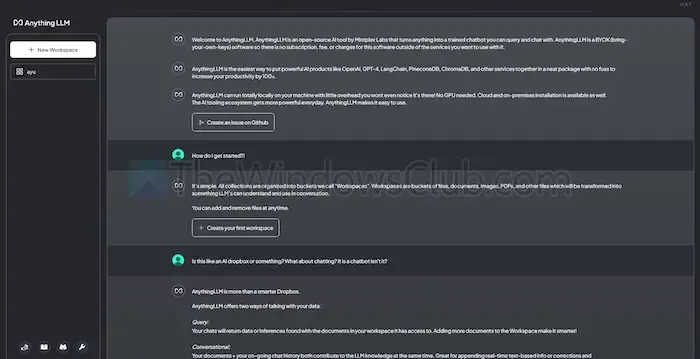

4] WszystkoLLM

AnythingLLM to oprogramowanie LLM typu open source, które umożliwia szeroką personalizację i zapewnia prywatne doświadczenie AI. Umożliwia użytkownikom implementację i uruchamianie LLM w trybie offline na ich lokalnych urządzeniach — niezależnie od tego, czy używają systemu Windows, Mac czy Linux — zapewniając całkowitą poufność danych.

To narzędzie jest szczególnie odpowiednie dla użytkowników indywidualnych, którzy szukają prostej instalacji z minimalną konfiguracją. Działa podobnie do prywatnego systemu ChatGPT, który osoby prywatne lub firmy mogą wdrożyć.

Cechy

- Przyjazny dla programistów: oferuje kompleksowe API umożliwiające niestandardowe integracje.

- Integracja narzędzi: Możliwość dołączenia dodatkowych narzędzi i generowania kluczy API.

- Szybka instalacja: Zaprojektowano ją tak, aby instalacja była możliwa za pomocą jednego kliknięcia.

Zalety

- Duża elastyczność w wykorzystaniu LLM.

- Możliwości skoncentrowane na dokumentach.

- Platforma z agentami AI umożliwiająca automatyzację zadań użytkowników.

Wady

- Brak obsługi wielu użytkowników.

- Poruszanie się po zaawansowanych funkcjach może być trudne.

Uzyskaj dostęp do AnythingLLM tutaj

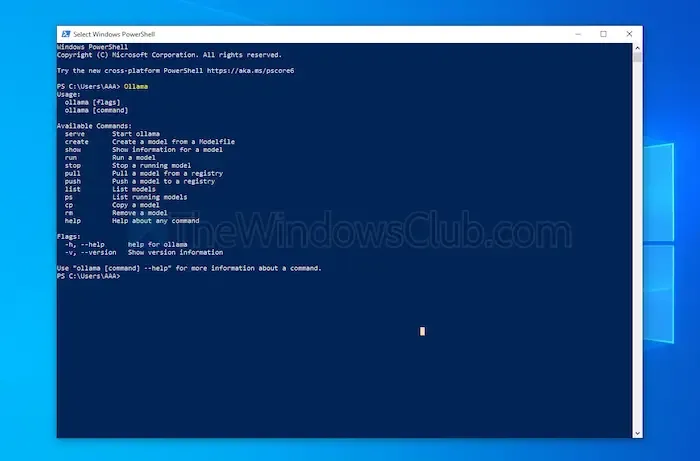

5] Być

Ollama zapewnia użytkownikom pełną kontrolę nad tworzeniem lokalnych chatbotów bez polegania na API. To narzędzie korzysta obecnie ze znacznych wkładów programistów, zapewniając częste aktualizacje i ulepszenia w celu poprawy funkcjonalności. W przeciwieństwie do innych omawianych opcji, Ollama działa za pośrednictwem interfejsu terminala do instalacji i uruchomień modeli.

Każdy instalowany model może mieć różne konfiguracje i ustawienia wagi, zapobiegając konfliktom oprogramowania na komputerze. Ponadto Ollama oferuje API zgodne z OpenAI, umożliwiając bezproblemową integrację z dowolną aplikacją wykorzystującą modele OpenAI.

Cechy

- Hosting modeli lokalnych: Ollama umożliwia uruchamianie dużych modeli językowych w trybie offline, takich jak Llama i Mistral.

- Dostosowywanie modelu: Zaawansowani użytkownicy mają możliwość dostosowywania zachowań modelu za pomocą pliku trybu.

- Integracja z API OpenAI: Ollama obejmuje API REST, które jest zgodne z ofertą OpenAI.

- Zarządzanie zasobami: zapewnia efektywne wykorzystanie zasobów procesora i procesora graficznego, zapobiegając przeciążeniu systemu.

Zalety

- Dostępna jest bogata kolekcja różnorodnych modeli.

- Możliwość importowania modeli z bibliotek typu PyTorch.

- Dobrze integruje się z rozbudowanym wsparciem bibliotek.

Wady

- Brak graficznego interfejsu użytkownika.

- Stosunkowo wysokie wymagania dotyczące przechowywania.

Wniosek

Podsumowując, lokalne narzędzia LLM stanowią doskonałą alternatywę dla modeli opartych na chmurze, zapewniając zwiększoną prywatność i pełną kontrolę przy zerowych kosztach. Niezależnie od tego, czy szukasz prostej użyteczności, czy rozbudowanych opcji dostosowywania, wyróżnione narzędzia odpowiadają różnym poziomom wiedzy i wymaganiom.

Wybór właściwego narzędzia zależy od takich czynników, jak możliwości przetwarzania i kompatybilność, co pozwala wykorzystać potencjał sztucznej inteligencji bez poświęcania prywatności lub ponoszenia opłat abonamentowych.

Dodaj komentarz