Najlepsze darmowe metody tworzenia obrazów AI przy użyciu stabilnej dyfuzji

Czy kiedykolwiek chciałeś generować obrazy AI bez polegania na narzędziach online? Wiele darmowych generatorów obrazów online ogranicza liczbę wyników i często wymaga subskrypcji po zaledwie kilku próbach. Przedstawiamy Stable Diffusion: darmowy i open-source’owy generator obrazów AI, który pozwala tworzyć obrazy w domu bez ograniczeń.

Czym jest dyfuzja stabilna?

Stable Diffusion to darmowy, open-source’owy framework, który przekształca tekst w obrazy wizualne na podstawie Twoich opisów. Chociaż nie jest to samodzielna aplikacja, służy jako kluczowa technologia wykorzystywana przez różne aplikacje. Jeśli chodzi o generatywną sztuczną inteligencję do tworzenia obrazów, Stable Diffusion pozostaje jednym z głównych kandydatów. Ten przewodnik podkreśla trzy podejścia do wykorzystania Stable Diffusion, od przyjaznych dla początkujących po bardziej złożone, z unikalnymi cechami w ramach każdej metody.

Wymagania systemowe

Oto zalecane wymagania, które należy spełnić, aby doświadczenie było udane:

- macOS: Apple Silicon (chip serii M)

- Windows lub Linux: GPU NVIDIA lub AMD

- Pamięć RAM: 16 GB dla optymalnej wydajności

- Pamięć VRAM GPU: co najmniej 4 GB (preferowane 8 GB)

- Pamięć masowa: 60-70 GB dostępnej przestrzeni

1. Korzystanie z interfejsu użytkownika Automatic1111 WebUI

Pierwsze podejście polega na wykorzystaniu internetowego interfejsu użytkownika AUTOMATIC1111 w celu uzyskania dostępu do Stable Diffusion, kompatybilnego ze wszystkimi głównymi systemami operacyjnymi.

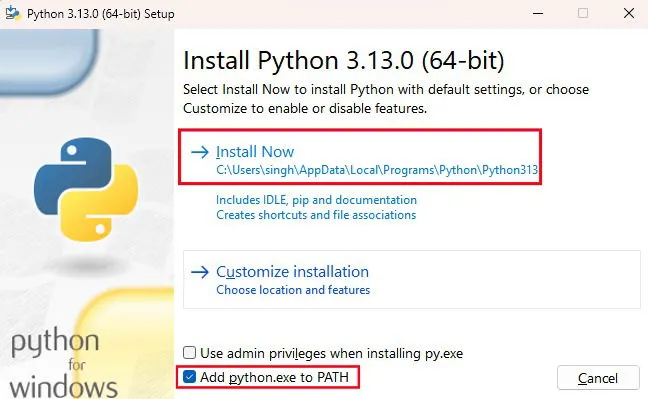

Zacznij od pobrania najnowszej stabilnej wersji Pythona . Po pobraniu uruchom instalator i upewnij się, że wybrałeś Dodaj python.exe do PATH przed kliknięciem Zainstaluj teraz .

Następnie przejdź do repozytorium AUTOMATIC1111 Web UI na GitHub, kliknij na Code i wybierz Download ZIP . Po zakończeniu pobierania rozpakuj plik i zapamiętaj lokalizację, w której zainstalowano WebUI.

Zainstaluj model

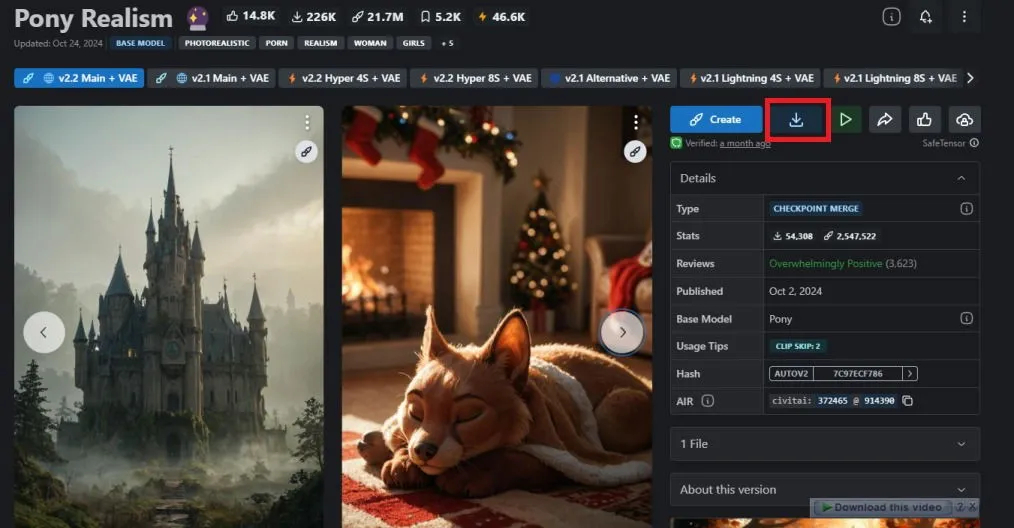

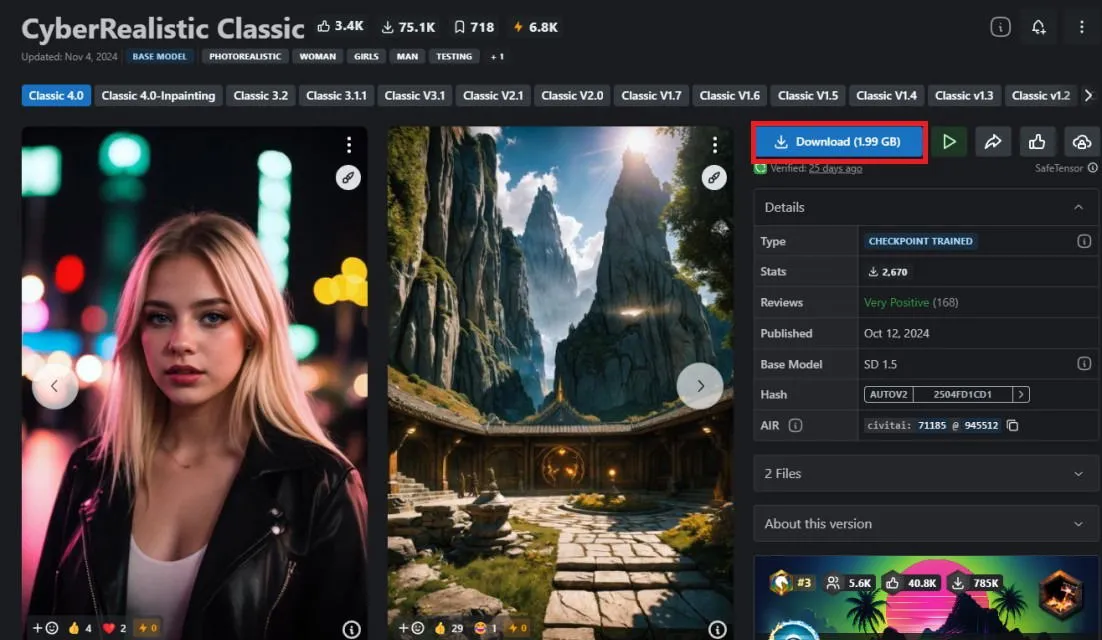

Zanim zaczniesz korzystać z interfejsu użytkownika sieci Web, musisz zainstalować co najmniej jeden model. Modele te są wstępnie wytrenowanymi punktami kontrolnymi, które określają styl artystyczny generowania obrazu. Aby wybrać model, odwiedź CIVITAI i wybierz ten, który Ci odpowiada.

Po znalezieniu preferowanego modelu kliknij przycisk pobierania. Po zakończeniu przenieś plik punktu kontrolnego „.safetensors” do właściwego folderu. Przejdź do katalogu pobierania dla swojego Automatic1111 WebUI, a następnie przejdź do webui -> models -> Stable-diffusion . Wklej pobrany plik modelu do tego katalogu i gotowe.

Uruchom i skonfiguruj WebUI

Teraz możesz uruchomić i używać Stable Diffusion bezpośrednio w przeglądarce internetowej.

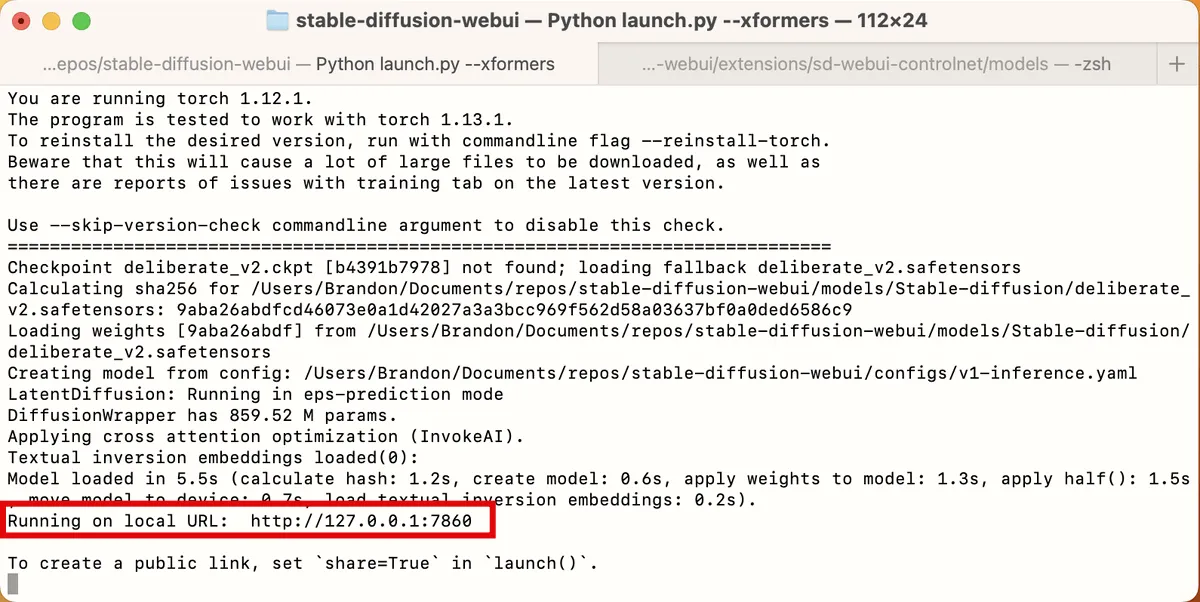

W systemie macOS uzyskaj dostęp do folderu „stable-diffusion-webui” za pomocą terminala i uruchom polecenie ./webui.sh --xformers. W przypadku użytkowników systemu Windows wykonaj polecenie ./webui-user.bat. Po zakończeniu skopiuj adres URL podany obok „Uruchomiony na lokalnym adresie URL”, który zwykle pojawia się jako http://127.0.0.1:7860 .

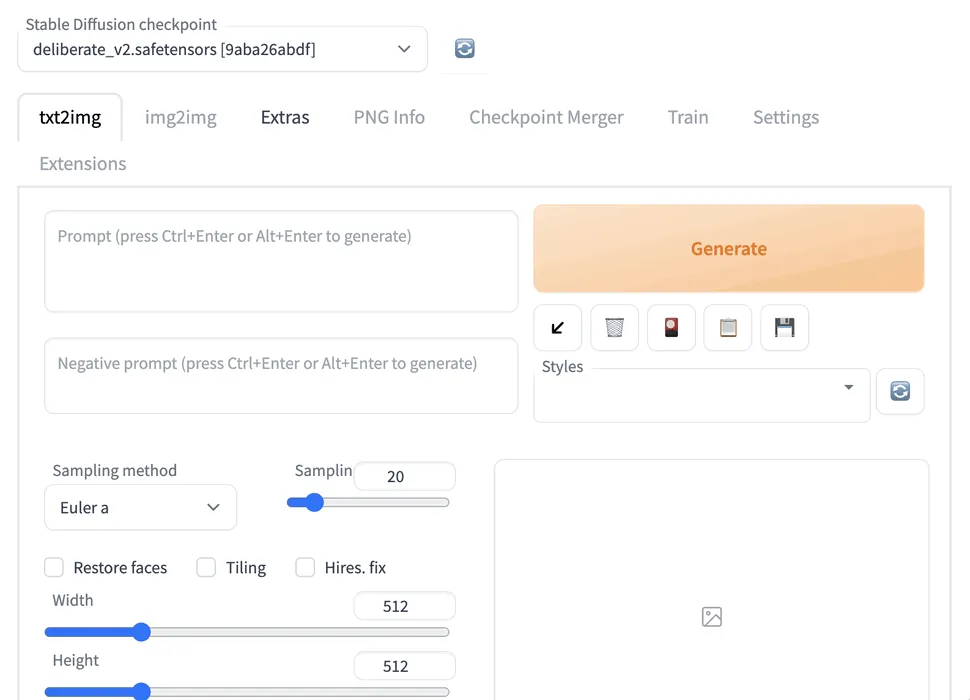

Wprowadź adres URL w pasku adresu przeglądarki i naciśnij Enter. Interfejs użytkownika sieci Web zostanie załadowany lokalnie w domyślnej przeglądarce internetowej. Chociaż początkowy interfejs może wydawać się przytłaczający, początkowo nie będziesz musiał dostosowywać wielu ustawień.

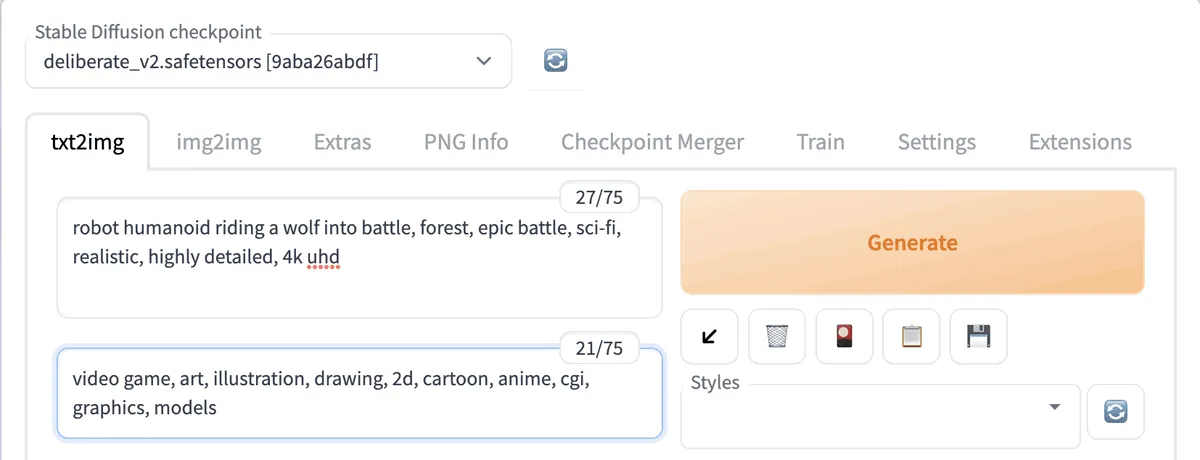

Zacznij od dostosowania parametrów Szerokość i Wysokość i ustawienia rozmiaru partii na 4, co spowoduje wygenerowanie czterech odrębnych obrazów dla każdego monitu.

Następnie wprowadź dowolny kreatywny monit w zakładce txt2img . Określ szczegółowo szczegóły, które chcesz uzyskać na obrazie, oddzielając różne deskryptory przecinkami. Ponadto opisz styl artystyczny, używając terminów takich jak „realistyczny”, „szczegółowy” lub „portret z bliska”.

W polu dla negatywnych podpowiedzi uwzględnij wszystkie elementy, które chcesz wykluczyć ze swojego obrazu. Rozważ modyfikację ustawienia „Skala CFG”; wyższa wartość powoduje, że generator ściślej trzyma się podanych przez Ciebie podpowiedzi, podczas gdy niższa wartość umożliwia bardziej kreatywne wyniki.

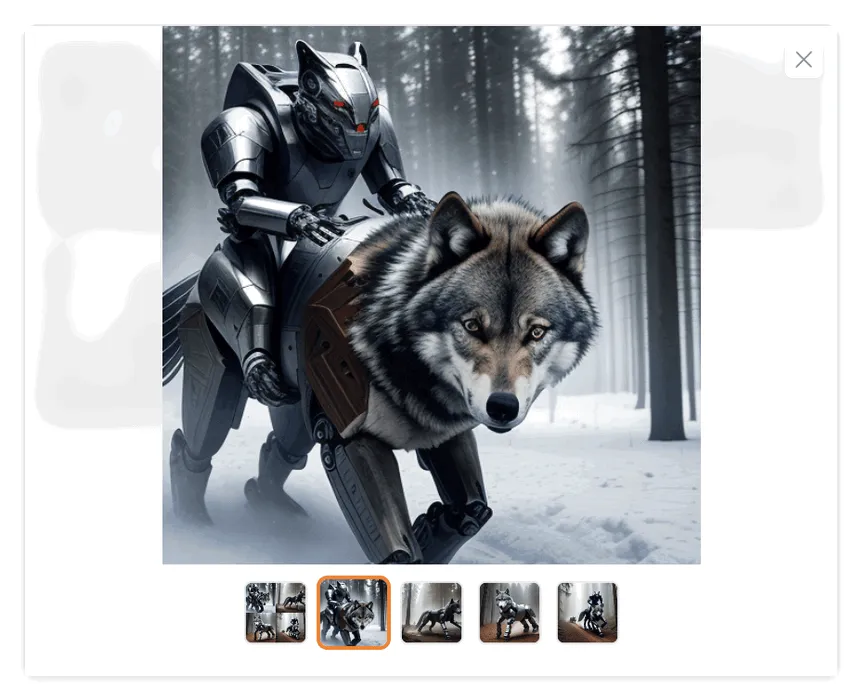

Pozostaw pozostałe ustawienia bez zmian i kliknij Generate na górze, aby rozpocząć proces generowania obrazu. Następnie możesz kliknąć miniatury obrazów, aby je wyświetlić i zdecydować, czy spełniają Twoje oczekiwania. Jeśli nie, możesz swobodnie dostosować skalę CFG i swoje monity. Na tym etapie Twój GPU będzie intensywnie wykorzystywany.

Jeśli znajdziesz obraz, który Ci się podoba, ale chcesz udoskonalić lub naprawić problemy (np. zniekształcone cechy), kliknij Wyślij do img2img lub Wyślij do inpaint . Ta opcja przeniesie Twój obraz i monity do odpowiednich kart w celu dalszego ulepszenia.

2. Odkrywanie Fooocus: najłatwiejszy generator obrazów AI

Fooocus wyróżnia się jako jedno z najprostszych i najskuteczniejszych dostępnych narzędzi do generowania obrazów AI. Jego intuicyjny interfejs sprawia, że jest on dostępny dla początkujących, którzy chcą eksperymentować z tworzeniem obrazów AI, zanim zanurzą się w bardziej skomplikowane metody.

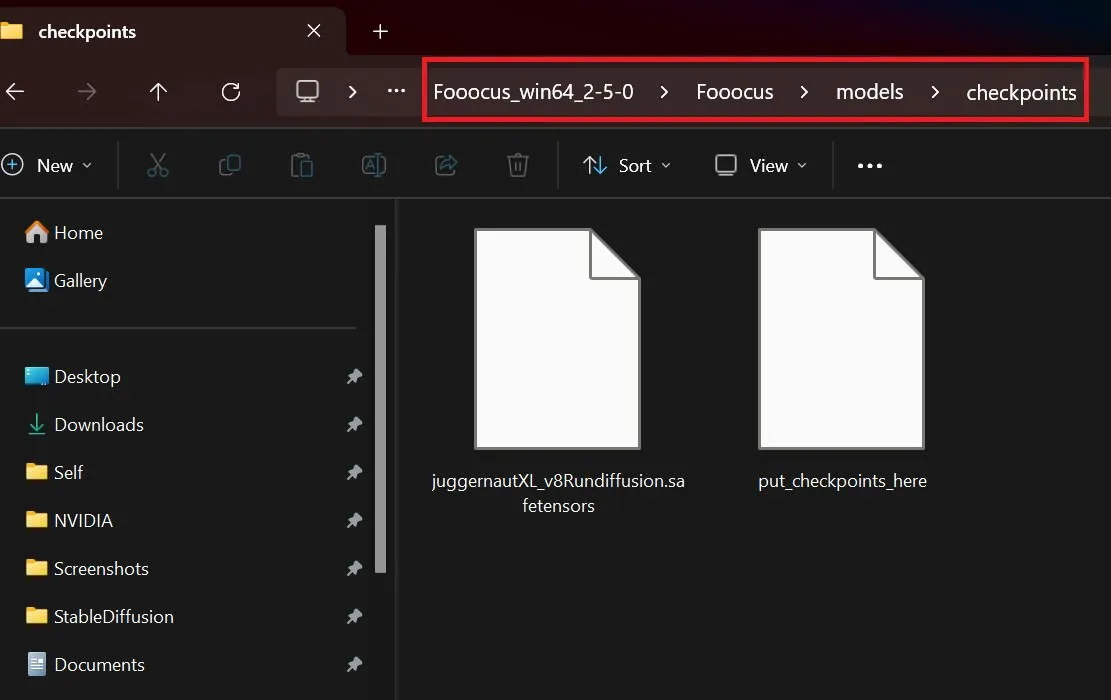

Pobierz skompresowany plik Fooocus i rozpakuj go po zakończeniu pobierania. Następnie przejdź do CIVITAI, aby wybrać punkt kontrolny, który Ci odpowiada. Po pobraniu punktu kontrolnego przejdź do folderu Fooocus. Kliknij Fooocus -> models -> checkpoints i umieść tam pobrany plik punktu kontrolnego.

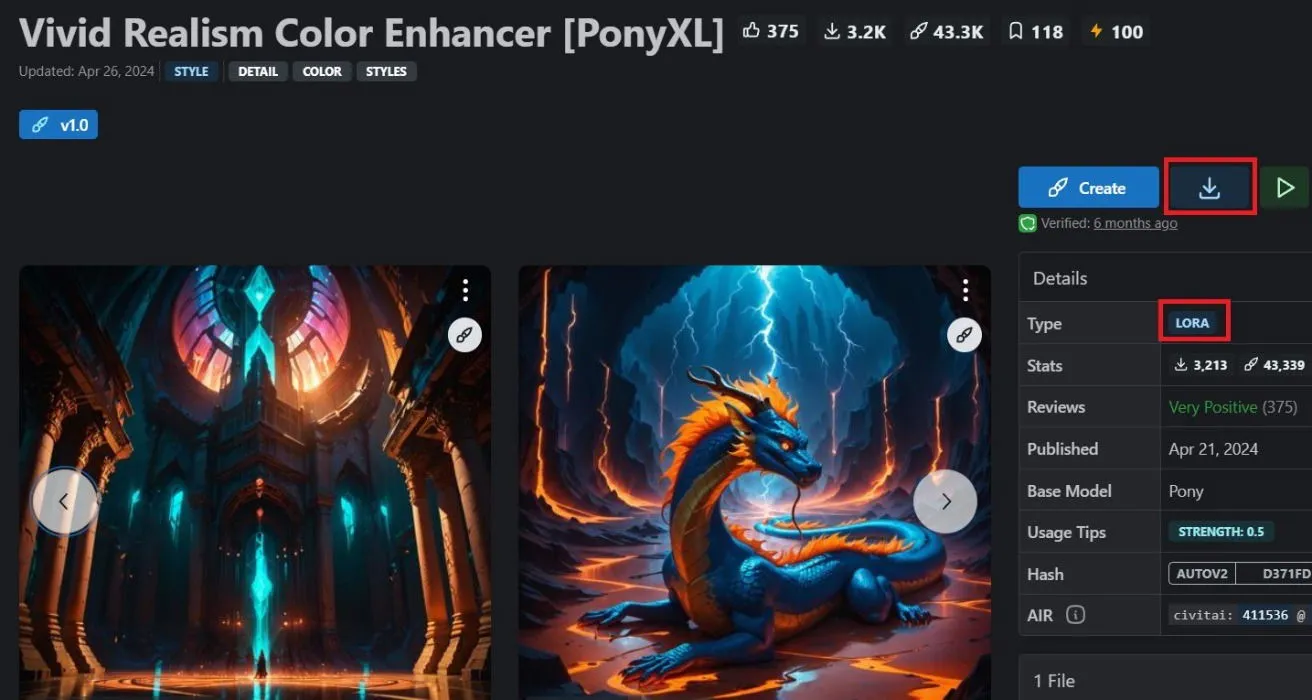

Możesz również pobrać LoRA z Civitai, które są mniejszymi plikami, które wzbogacają duże modele językowe o nowe koncepcje lub style. W przeciwieństwie do punktów kontrolnych, które mogą mieć kilka gigabajtów, LoRA dodają charakterystyczne elementy do ostatecznych obrazów, wykorzystując istniejący punkt kontrolny.

Jeśli zdecydujesz się na użycie LoRA w celu ulepszenia stylu wizualnego swoich obrazów AI, wróć do folderu models w katalogu Fooocus i wklej plik LoRA do folderu loras .

Bieganie Fooocus

Czas zacząć generować obrazy w Fooocus. Przejdź do folderu, w którym wypakowałeś oprogramowanie i kliknij dwukrotnie run.bat . Pojawi się wiersz poleceń i automatycznie załaduje interfejs Fooocus w przeglądarce internetowej.

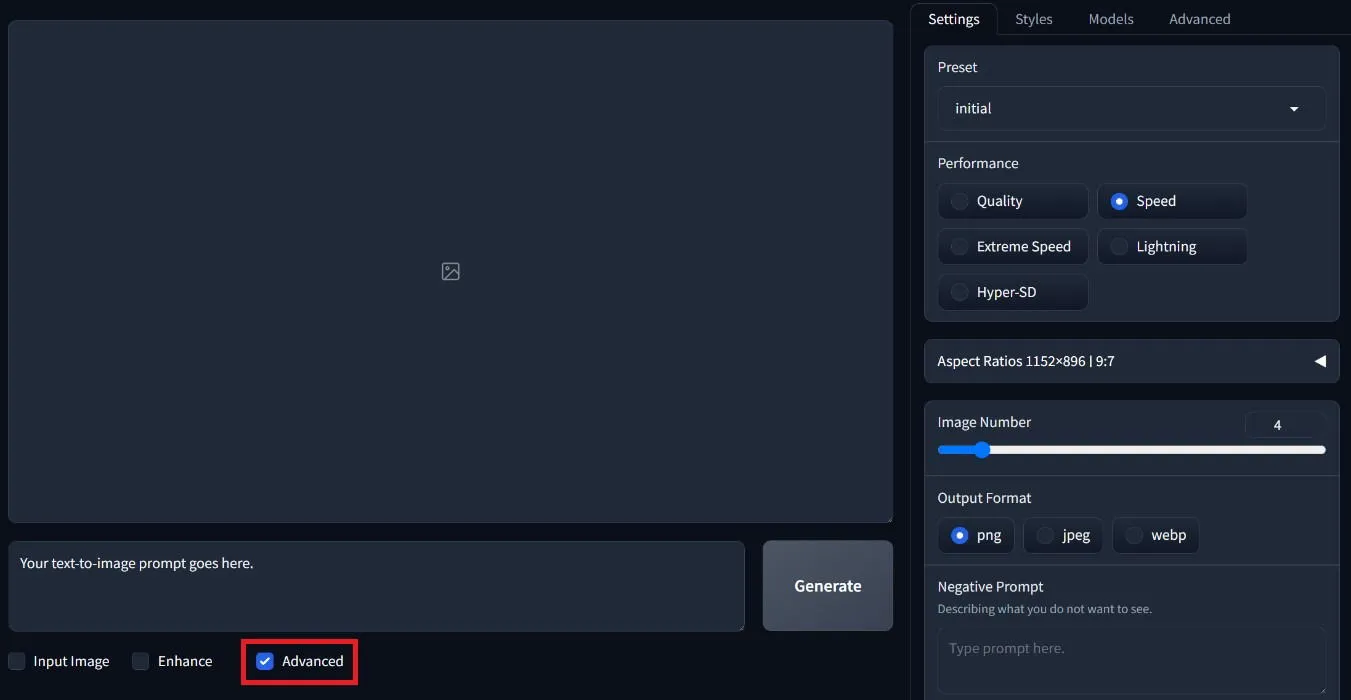

Na ekranie otwierającym upewnij się, że zaznaczyłeś opcję Zaawansowane na dole, która ujawni dodatkowe ustawienia. Tutaj możesz wybrać pożądany współczynnik proporcji, liczbę obrazów, które Fooocus wygeneruje na monit, i wybrać format pliku obrazu.

Początkowo ustaw opcję wydajności na Szybkość , ponieważ znacznie zwiększy to szybkość generowania obrazu. Na dole wprowadź negatywne monity dla niechcianych elementów.

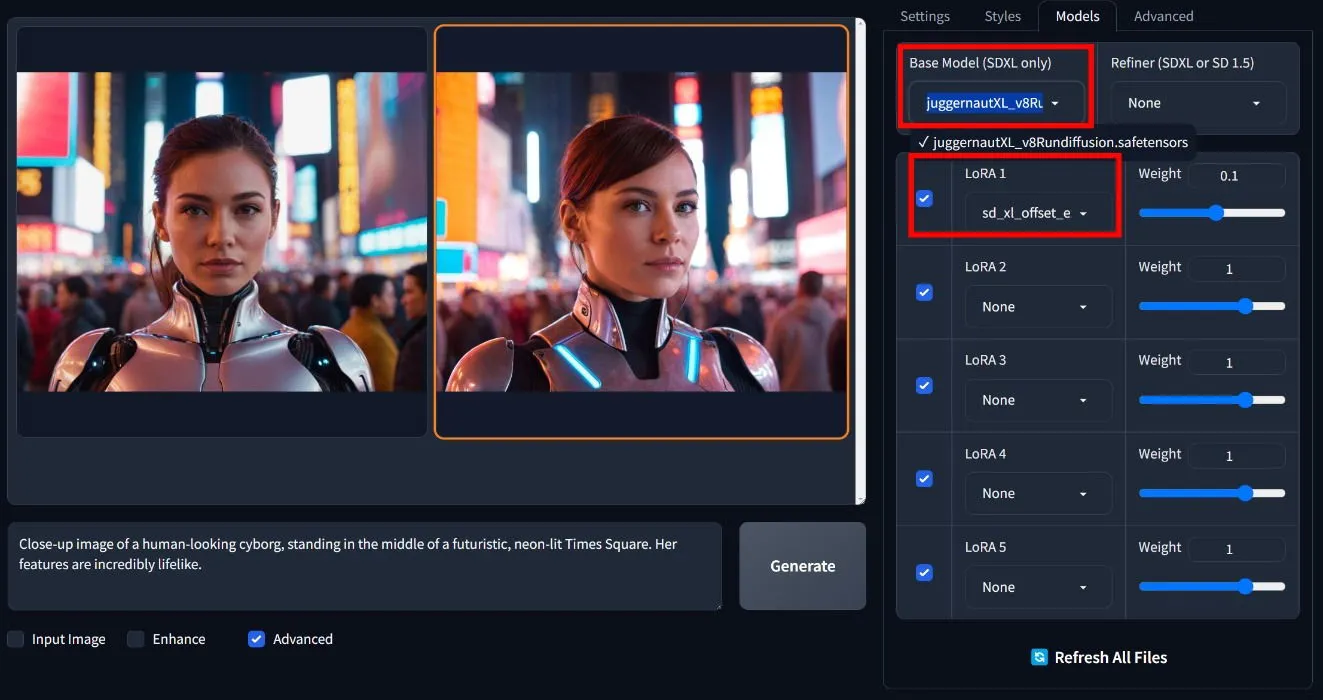

Najedź kursorem na każdy styl, aby go podejrzeć. Następnie przejdź do zakładki Modele, gdzie możesz wybrać model bazowy, który umieściłeś w folderze Fooocus. Bezpośrednio poniżej wybierz LoRA, jeśli masz zainstalowany.

Pozostaje tylko kliknąć przycisk Generate i zobaczyć, jak Fooocus tworzy pożądane obrazy. Choć może nie jest to najpotężniejszy dostępny generator obrazów, Fooocus z pewnością okazuje się najprostszą metodą, umożliwiającą łatwe dostosowywanie stylów, punktów kontrolnych i LoRA w celu tworzenia idealnych obrazów.

Wykorzystanie zamiany twarzy AI w Fooocus

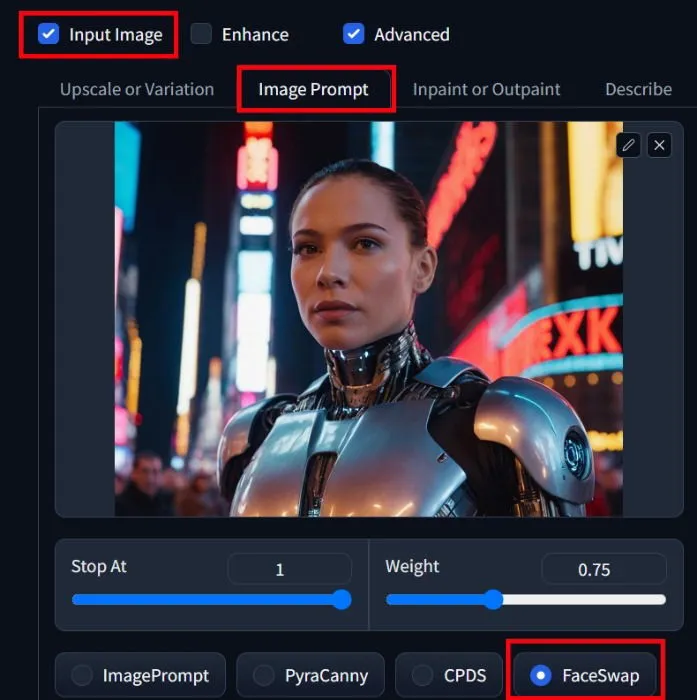

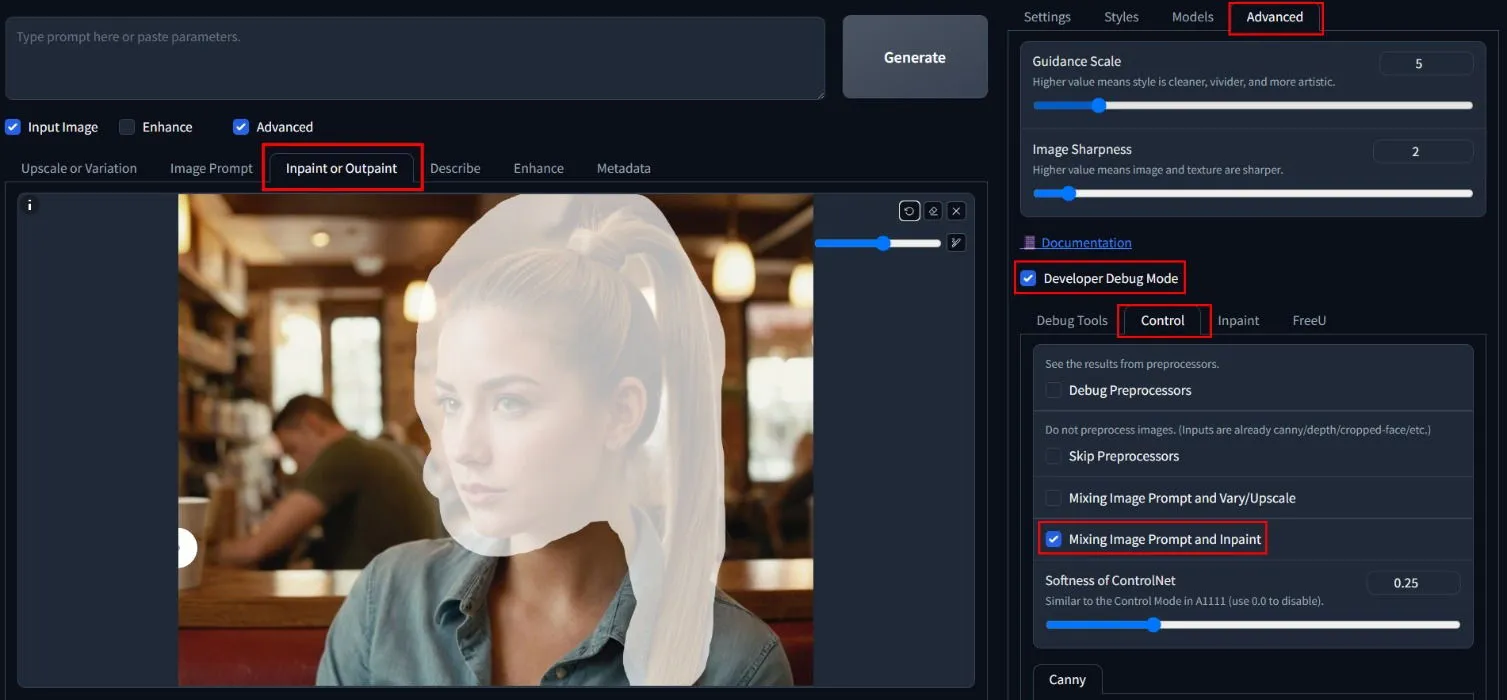

Fooocus oferuje nawet funkcję FaceSwap, która pozwala na zamianę twarzy na obrazie na inne. Najpierw zaznacz opcję Input Image na dole, a następnie wybierz Image Prompt . Tutaj prześlij obraz, na który chcesz zamienić twarz. Przewiń w dół, kliknij ponownie Advanced i z opcji wybierz FaceSwap .

Obok sekcji Image Prompt kliknij na zakładkę Inpaint lub Outpaint i prześlij obraz do zamiany twarzy. Narysuj kontur twarzy i włosów, a następnie przejdź do zakładki Advanced w prawym górnym rogu. Aktywuj tryb debugowania programisty , kliknij Control i zaznacz pole wyboru Mixing Image Prompt and Inpaint .

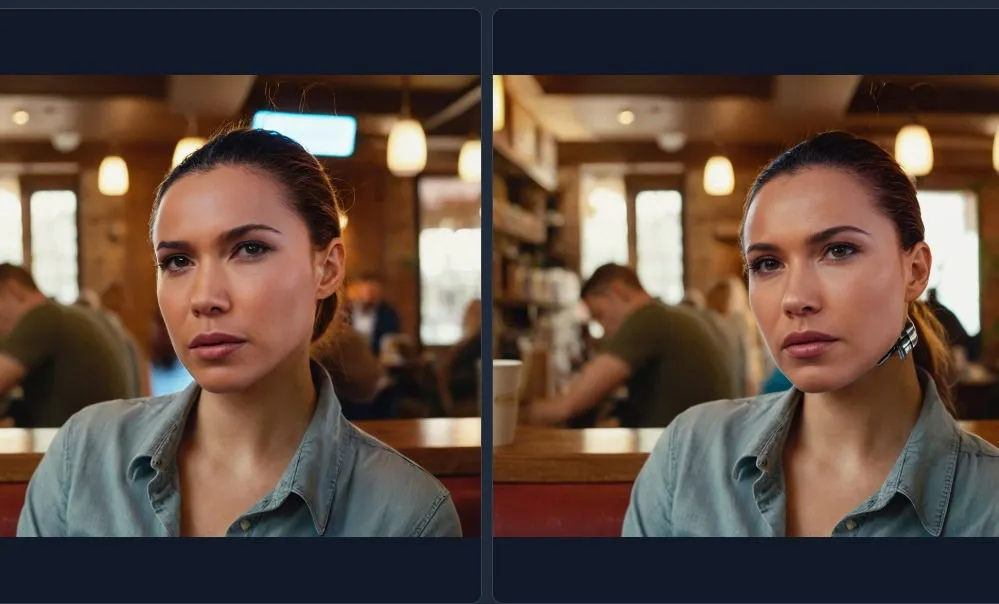

Po wykonaniu tej czynności wyczyść pole monitu i kliknij Generuj . Spowoduje to wykonanie zamiany twarzy z wybranym obrazem, co da różne rezultaty.

Po wygenerowaniu obrazów możesz chcieć je udoskonalić, korzystając z najlepszych narzędzi do skalowania obrazów opartych na sztucznej inteligencji (AI), aby zwiększyć ich rozdzielczość.

3. Generowanie obrazów AI za pomocą ComfyUI

ComfyUI to kolejna preferowana metoda wykorzystania Stable Diffusion do tworzenia obrazów AI. Chociaż przepływ pracy może być bardziej angażujący, jest również bardziej złożony. Aby rozpocząć, pobierz i wyodrębnij ComfyUI z GitHub.

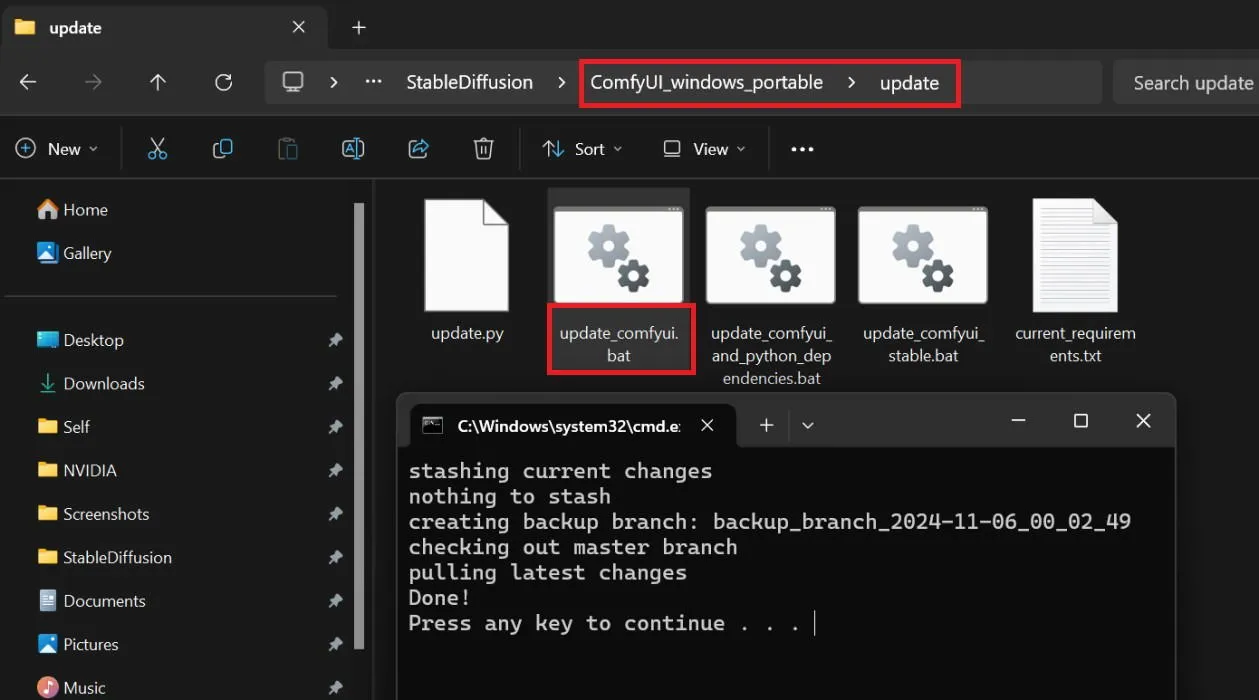

Prawdopodobnie jesteś już zaznajomiony z punktami kontrolnymi i LoRA. Jak wspomniano wcześniej, pobierz plik punktu kontrolnego (i plik LoRA, jeśli chcesz) i umieść go w odpowiednich folderach w katalogu models w ComfyUI. W katalogu ComfyUI otwórz folder Update i uruchom update_comfyui.bat , aby przygotować konfigurację.

Teraz czas uruchomić generator obrazów ComfyUI AI. Wróć do katalogu ComfyUI, gdzie powinieneś zobaczyć dwa pliki wsadowe. Jeśli masz kartę graficzną Nvidia, kliknij dwukrotnie run_nvidia_gpu.bat ; w przeciwnym razie uruchom run_cpu.bat .

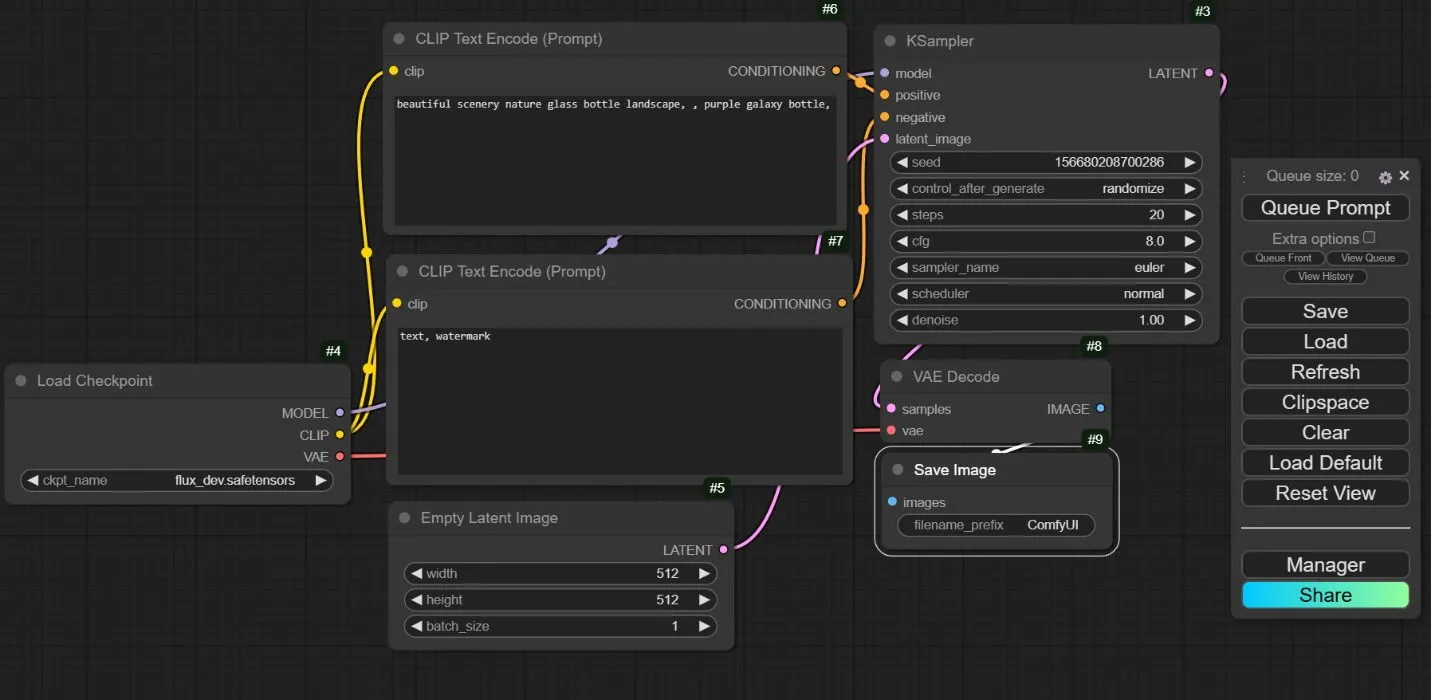

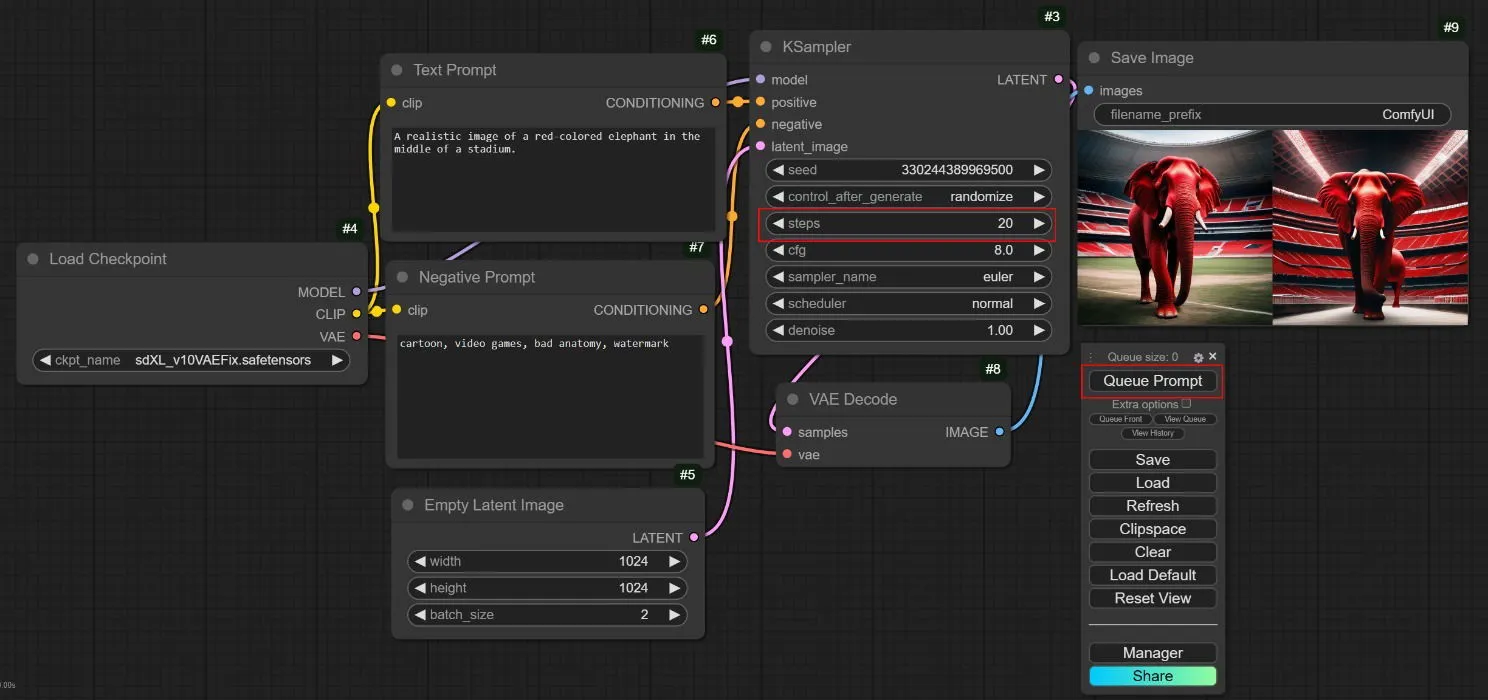

Po uruchomieniu ComfyUI w przeglądarce zobaczysz jego domyślny przepływ pracy, który obejmuje kilka połączonych ze sobą węzłów. Chociaż początkowo może to wyglądać skomplikowanie, węzły te reprezentują różne kroki w procesie generowania obrazu AI.

Wiele węzłów pozwala na tworzenie dostosowanego przepływu pracy, integrując różne węzły, modele, LoRA i rafinerie, zapewniając użytkownikom rozległą kontrolę nad końcowym wynikiem. Jednak ta złożoność może utrudniać nawigację i opanowanie ComfyUI.

Uruchamianie ComfyUI

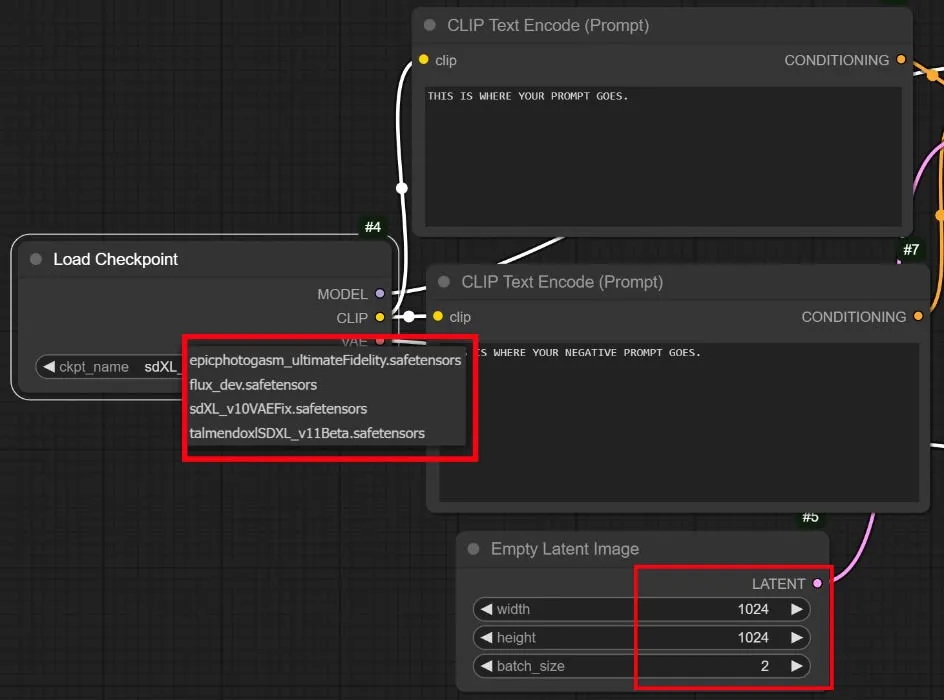

Aby rozpocząć, wybierz punkt kontrolny w węźle Load Checkpoint . Przejdź do węzła CLIP Text Encode (Prompt) , w którym wprowadzisz tekstowy monit dla obrazu. Poniżej znajduje się odpowiadający mu węzeł negatywnego monitu dla niechcianych deskryptorów. W węźle Empty Latent Image możesz dostosować szerokość, wysokość i liczbę obrazów, które chcesz wygenerować.

Gdy już ustawisz swoje monity, dostosuj wymiary obrazu, rozmiar partii i kluczowe kroki przetwarzania. Około 20 do 30 kroków zwykle daje obraz dobrej jakości. Na koniec naciśnij przycisk Queue Prompt i pozwól ComfyUI wykonać pracę.

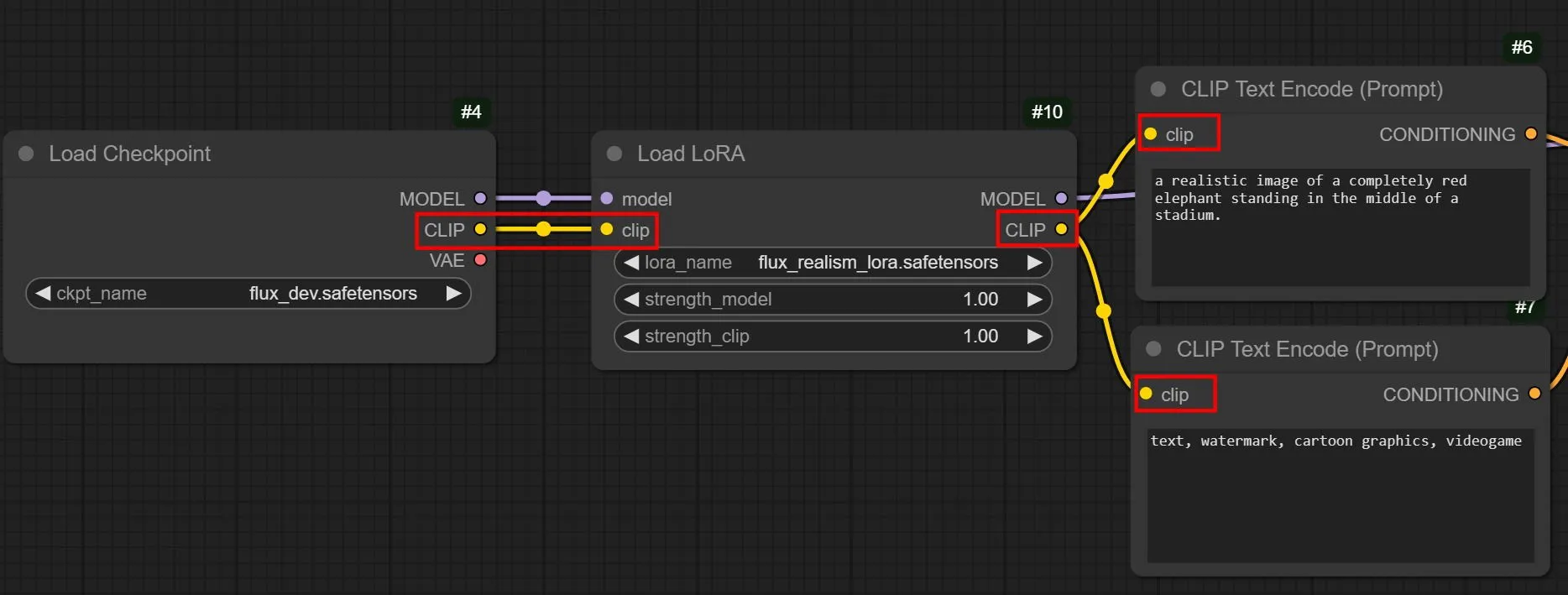

Korzystanie z LoRA w ComfyUI

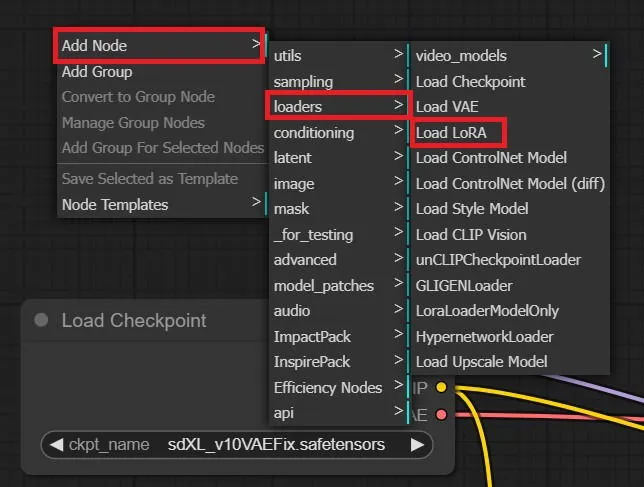

Aby uwzględnić określone LoRA w ComfyUI, po prostu kliknij prawym przyciskiem myszy w pobliżu węzła punktu kontrolnego i wybierz Dodaj węzeł -> ładowarki -> Załaduj LoRA . Wybierz dowolny LoRA ze swojego folderu w katalogu.

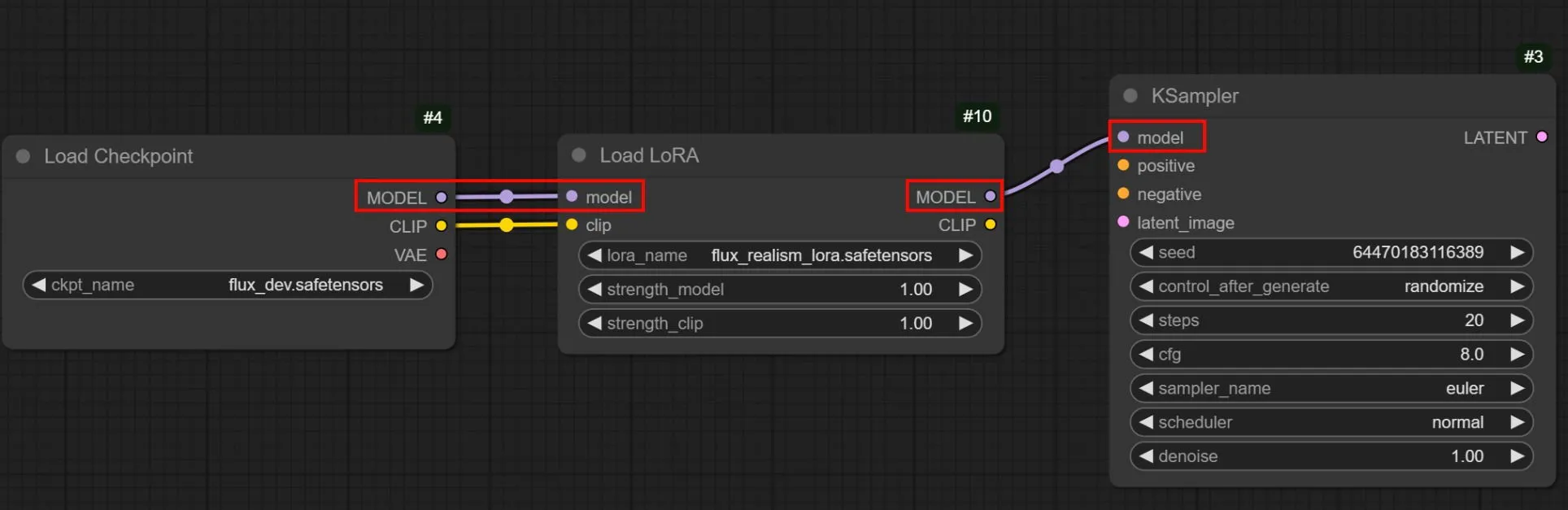

Należy jednak pamiętać, że za każdym razem, gdy dodawany jest nowy węzeł LoRA, konieczne będzie ponowne uporządkowanie połączeń. Przeciągnij linię z węzła Checkpoint oznaczonego jako Model do punktu wejścia modelu węzła LoRA po lewej stronie zamiast do KSampler. Następnie połącz punkt wyjścia węzła LoRA z powrotem do wejścia modelu KSampler.

Upewnij się, że obie linie Clip z węzła Checkpoint są kierowane do każdego węzła Prompt. Podobnie, połącz lewe punkty wejścia LoRA’s Clip zarówno z pozytywnymi, jak i negatywnymi monitami.

Dzięki zrozumieniu domyślnego przepływu pracy i stopniowemu dodawaniu niestandardowych węzłów, nabędziesz biegłości w korzystaniu z ComfyUI na potrzeby generowania obrazów za pomocą sztucznej inteligencji.

Często zadawane pytania

Jak odróżnić od siebie stabilną dyfuzję, DALL-E i Midjourney?

Wszystkie trzy systemy AI mogą generować obrazy z podpowiedzi tekstowych, ale tylko Stable Diffusion jest całkowicie darmowy i ma otwarte źródło. Możesz zainstalować i uruchomić go na swoim komputerze bez żadnych kosztów, podczas gdy DALL-E i Midjourney są zastrzeżonymi programami.

Czym właściwie jest model w Stable Diffusion?

Model służy jako plik, który ucieleśnia algorytm AI trenowany przy użyciu określonych obrazów i słów kluczowych. Różne modele doskonale radzą sobie z generowaniem różnych typów wizualizacji. Na przykład niektóre mogą być zoptymalizowane pod kątem realistycznych przedstawień ludzi, podczas gdy inne są lepiej dostosowane do ilustracji 2D lub różnych stylów artystycznych.

Źródło obrazu: Obraz główny autorstwa Stable Diffusion. Wszystkie zrzuty ekranu dostarczone przez Brandona Li i Samarveera Singha.

Dodaj komentarz