LLM’s lokaal uitvoeren op Android

Wat te weten

- Installeer een app zoals MLC Chat op uw Android-apparaat om lokaal met LLM’s te experimenteren en te chatten.

- Download een van de beschikbare modellen en tik op het pictogram ‘Chat’ om te beginnen met chatten met de door u gekozen LLM.

- Met de MLC Chat-app kun je Gemma 2b, RedPajama, Llama3, Phi-2, Mistral en Llama2 downloaden.

Er zijn verschillende LLM’s die u lokaal op uw pc kunt uitvoeren. Maar als het om smartphones gaat, zijn de mogelijkheden enigszins beperkt. Je moet een klein taalmodel gebruiken of een premiumapparaat hebben met voldoende verwerkingskracht om LLM’s aan te kunnen. Hoe dan ook, het is mogelijk om lokaal en offline met taalmodellen te chatten.

LLM’s lokaal uitvoeren op Android

Grote taalmodellen zijn, nou ja, groot, en vereisen behoorlijk wat rekenvaardigheid. Maar zelfs als uw Android-apparaat voldoende middelen heeft om zowel SLM’s (kleine taalmodellen) als LLM’s uit te voeren, heeft u nog steeds een app nodig waarmee u ermee kunt experimenteren met een gebruiksvriendelijke interface.

Dit is waar een app als MLC Chat van pas komt. Gebruik de onderstaande stappen om LLM’s lokaal op uw Android uit te voeren met behulp van de MLC Chat-app.

Stap 1: Installeer de MLC Chat-app

- MLC Chat-app | Download link

- Klik eerst op de bovenstaande link en download de APK voor de MLC Chat-app. Tik desgevraagd op Toch downloaden .

- Installeer de MLCChat-app. Als u klaar bent, opent u het .

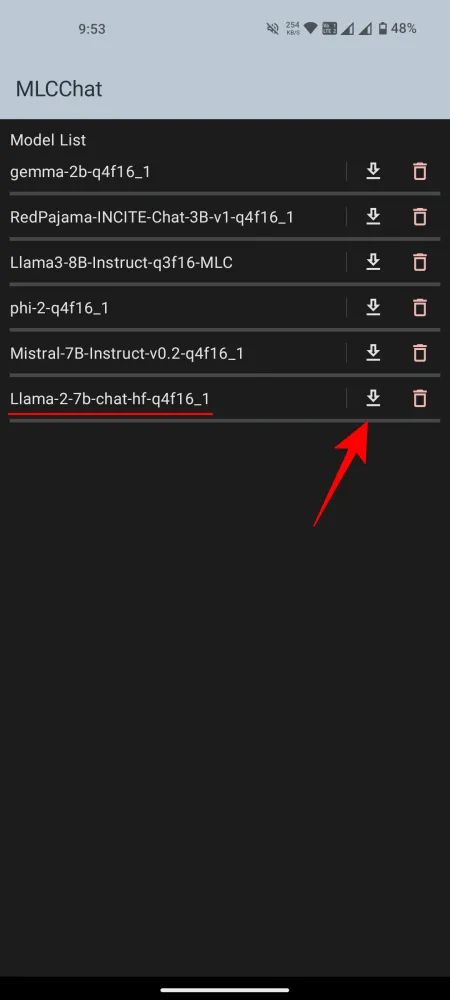

Stap 2: Download een LLM

In de MLCChat-app vindt u een lijst met beschikbare modellen die u kunt downloaden. Tik op de downloadlink naast een model dat u leuk vindt en wacht tot het is gedownload.

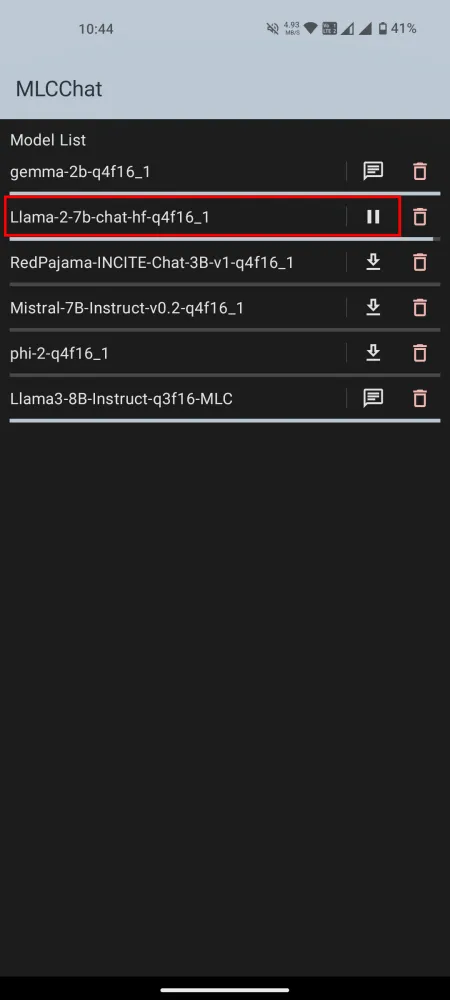

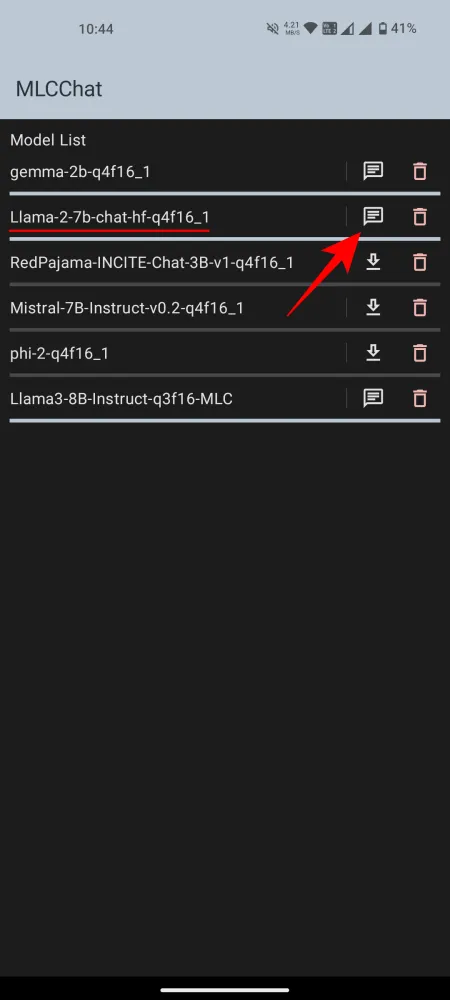

Stap 3: Voer de geïnstalleerde LLM uit

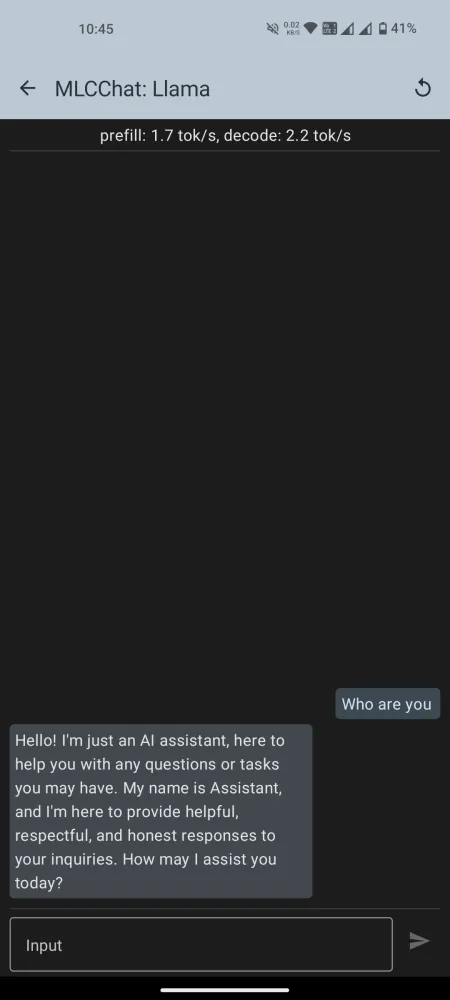

Eenmaal gedownload, tikt u op het chatpictogram ernaast om de chat te starten. Wacht tot het model is geïnitialiseerd. Als je klaar bent, ga je gang en begin je te chatten met de AI.

Merk op dat er uit de lijst met beschikbare modellen in de MLCChat-app enkele zullen zijn, zoals Llama3, die veel verwerkingskracht vereisen. Maar je kunt de modellen altijd installeren en testen of ze soepel genoeg werken. Als dit niet het geval is, probeer dan een kleiner taalmodel.

Tijdens onze tests (op Nothing Phone 1) kon Gemma-2b niet worden geladen, terwijl de Llama3 de systeeminterface doodde. Degenen die goed werkten waren Llama-2 en Phi-2. Het belangrijkste verschil tussen LLM’s en andere kleinere taalmodellen is de breedte van de informatie waarop ze zijn getraind (parameters). Kies dus uw modellen op basis van uw behoeften en de mogelijkheden van uw Android-apparaat.

We hopen dat je LLM’s lokaal op je Android-apparaat hebt kunnen installeren en uitvoeren. Tot de volgende keer!

Geef een reactie