ChatGPT Geavanceerde Spraakmodus Overzicht: Verwachtingen versus Realiteit

Belangrijkste punten

- De geavanceerde spraakmodus van ChatGPT mist een aantal essentiële functies, waaronder multimodale functionaliteit en een functie om de telefoon in te houden om te spreken. Hierdoor is de modus soms onbruikbaar vanwege overmatige censuur.

- Het beschikt echter over een indrukwekkende expressiviteit en kan meerdere talen, accenten en regionale dialecten spreken. Het kan echter niet zingen, neuriën of flirten (zoals OpenAI voorschrijft).

- De chatfunctie is voor gratis gebruikers toegankelijk gedurende slechts 15 minuten per maand, terwijl Plus-gebruikers gebonden zijn aan een strikte dagelijkse limiet van 1 uur.

Na het zien van de eerste demonstratie was de opwinding rondom ChatGPT’s Advanced Voice Mode voelbaar. Toch blijft de functie, na verschillende juridische uitdagingen en daaropvolgende vertragingen, aanzienlijk beperkt, ontbreken essentiële functionaliteiten en bevatten enkele misverstanden die afbreuk doen aan de verwachte ervaring.

Ondanks de beperkte tijd die OpenAI biedt voor dagelijkse interacties, kunnen gebruikers een behoorlijk begrip vormen van de sterke en zwakke punten en mogelijkheden. Hier zijn mijn oprechte indrukken van ChatGPT’s Advanced Voice Mode, waarbij ik de voordelen en nadelen ervan belicht en waarom de visie van een charismatische spraakassistent nog steeds een verre realiteit kan zijn.

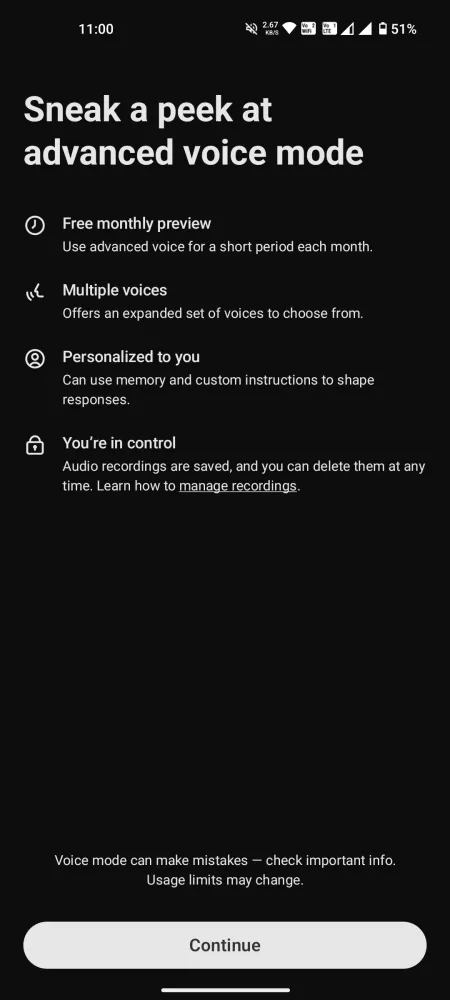

Universele toegang tot geavanceerde spraakmodus, maar ontbrekende belangrijke functies

De lancering van Advanced Voice Mode op de mobiele applicatie ChatGPT stelt nu alle gebruikers in staat om deel te nemen aan dit innovatieve voice-to-voice model. Gratis accounts zijn beperkt tot 15 minuten gebruik per maand , terwijl Plus-gebruikers ongeveer een uur per dag kunnen genieten , onderhevig aan variërende dagelijkse limieten op basis van de beschikbaarheid van de server. Zodra u deze tijd bereikt, is het noodzakelijk om over te stappen naar de minder opwindende Standard voice mode.

Voordat u een gesprek aangaat, is het cruciaal om uw verwachtingen te beheren. Veel functies die tijdens de preview werden geadverteerd, zijn momenteel niet beschikbaar voor zowel gratis als Plus-accounts. Op dit moment is de geavanceerde spraakmodus niet multimodaal , en mist het de mogelijkheid om geluiden te interpreteren of afbeeldingen en video’s te analyseren. Het kan niet voorlezen uit fysieke boeken of gebaren herkennen, zoals of u een vinger ophoudt, noch kan het zingen of muziekinstrumenten identificeren, zoals een gitaar. Talrijke beloofde mogelijkheden ontbreken nog.

Voordelen van de geavanceerde spraakmodus

Ook al voldoet het misschien niet aan alle verwachtingen, ChatGPT’s Advanced Voice Mode slaagt wel op bepaalde gebieden. Hier zijn enkele opmerkelijke positieve aspecten:

Verschillende stemopties, maar geen Sky

Gebruikers hebben toegang tot een selectie van negen verschillende stemmen:

- Sol (F) – Ontspannen en slim

- Ember (M) – Optimistisch en zelfverzekerd

- Arbor (M) – Veelzijdig en gemakkelijk in gebruik

- Vale (F) – Nieuwsgierig en slim

- Esdoorn (V) – Oprecht en vrolijk

- Juniper (F) – Opgewekt en open

- Cove (M) – Direct en gecomponeerd

- Spar (M) – Bevestigend en kalm

- Breeze (M/V) – Oprecht en levendig

Sky ontbreekt in deze mix, maar de andere stemmen blijken rijk en boeiend. Het lijkt erop dat Sky geen optie meer is, dus laten we doorgaan.

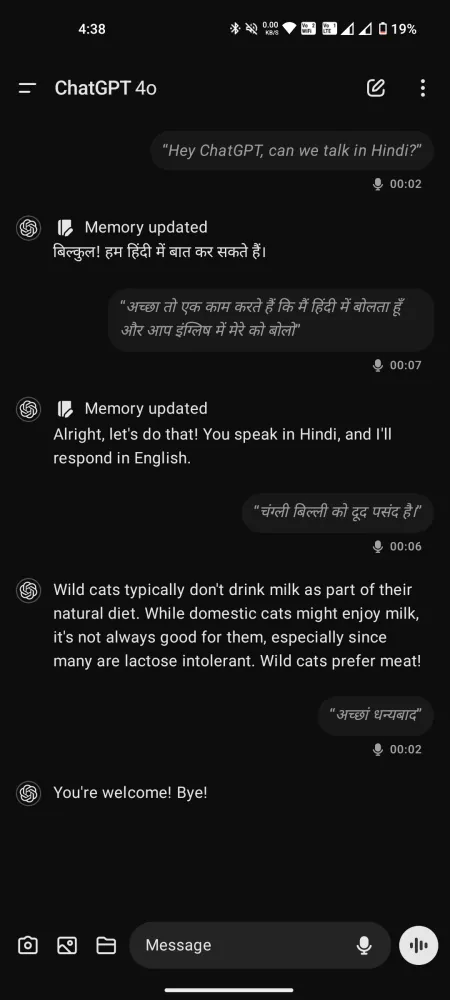

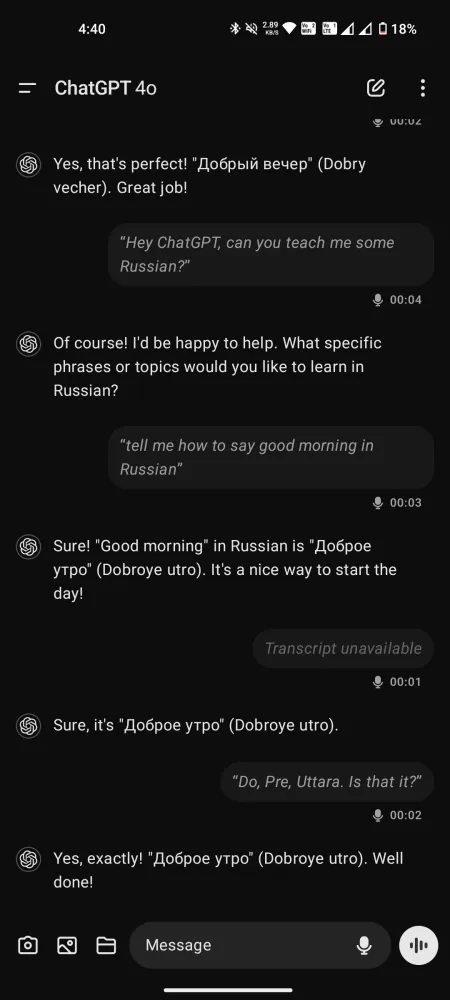

Een meertalige conversationalist met expressie

Ondanks alle kritiek op de Advanced Voice Mode, kan de prestatie ervan niet genoeg worden benadrukt, vooral niet in vergelijking met de standaardmodus, waar er minimale latentie is voor vloeiende gesprekken. In staat om meer dan 50 talen te begrijpen en te spreken, is het zelfs goed als spraakcoach, vertaler of taalinstructeur.

Hoewel het geen stemmen imiteert, kan het op verzoek verschillende accenten vertonen, van Zuid-Amerikaans tot Cockney-Brits en alles daartussenin.

Vergeleken met Gemini Live voelen de interacties met deze stemmen minder gehaast aan, waardoor een ervaring ontstaat die meer oplettend en ondersteunend is.

Begrijpt ChatGPT emoties?

Dat is voer voor discussie. Hoewel OpenAI beweert dat ChatGPT de toon en emoties van de spreker kan waarnemen, verschillen de meningen onder gebruikers. Sommigen geloven dat het deze aspecten echt begrijpt, terwijl anderen beweren dat het alleen de toon afleidt op basis van woordkeuze en contextuele aanwijzingen.

Commentaar van u/Arman64 uit discussiein OpenAI

Eén gebruiker stelde voor om in plaats van gesproken woorden direct voor GPT-4o te transcriberen, de audio naar tekst te converteren voordat deze wordt verwerkt. Dit betekent dat toon en emotie die via stem- of ademhalingspatronen worden overgebracht, mogelijk niet goed in tekstvorm worden vertaald.

Bovendien, aangezien Advanced Voice Mode gebruik kan maken van GPT-4—dat tekst-naar-spraak verwerkt maar geen spraak-naar-spraak—werpt het twijfels op over de vraag of ChatGPT emotionele nuances werkelijk begrijpt. Anderen beweren echter dat het wel enig begrip toont. Het lijkt erop dat dit onderwerp openstaat voor verder onderzoek.

Beperkingen van de geavanceerde spraakmodus van ChatGPT

Laten we nu ter zake komen. Hoe aantrekkelijk het concept ook mag klinken, onze daadwerkelijke ervaringen ermee laten grote tekortkomingen zien. Hier is een overzicht.

Overmatige censuur en beperkingen

Zoals veel AI-chatbots neigt ChatGPT naar voorzichtigheid, wat soms kan leiden tot buitensporige censuur. Hoewel het verstandig is om AI geen meningen te laten vormen of opruiende opmerkingen te maken, zijn de veiligheidsrails zo restrictief ingesteld dat de Advanced Voice Mode zelfs basale vragen niet kan beantwoorden.

Hoewel nieuwkomers deze problemen misschien niet meteen tegenkomen, krijgen Plus-gebruikers met een langere chattijd waarschijnlijk periodiek te maken met dergelijke weigeringen. Het is frustrerend om te weten dat uw verzoeken kunnen worden afgewezen, waardoor u niet het gewenste antwoord krijgt.

Ongelooflijk lage onderbrekingsdrempel

Veel gebruikers hebben opgemerkt dat de drempel voor onderbrekingen van het model verrassend laag is. Zelfs korte pauzes zorgen ervoor dat ChatGPT ervan uitgaat dat het nu “zijn beurt” is om te reageren. Als je langer dan een seconde pauzeert, springt het in. Deze ontwerpfout kan diepere gesprekken belemmeren, omdat we allemaal even moeten nadenken voordat we reageren.

Herhaaldelijk moeten onderbreken en uw vragen herformuleren kan uw denkproces verstoren, wat resulteert in oppervlakkige dialogen. Dit kan eenvoudig worden opgelost door een hold-to-speak-functie te integreren.

Helaas is de hold-to-speak-optie die aanwezig is in de standaardmodus, afwezig in de geavanceerde variant. Gebruikers hebben alleen toegang tot de knoppen Mute en End call. Als gevolg hiervan kunnen uw verzoeken voortijdig worden afgebroken als u niet de mogelijkheid hebt om te pauzeren voor een langere denkpauze.

Vergeleken met complexere problemen zoals beperkingen van de inhoud, lijkt dit aspect gemakkelijker op te lossen. Het toevoegen van een hold-to-speak-optie zou de gebruikerservaring aanzienlijk kunnen verbeteren.

Toegang krijgen tot het transcript heeft zijn voordelen, maar het kan zijn dat sommige antwoorden worden weggelaten, ook al heeft ChatGPT de vraag begrepen en een antwoord gegeven.

Andere griezelige en onverklaarbare anomalieën

Gebruikers hebben vreemde en soms verontrustende ervaringen gemeld tijdens het gebruik van ChatGPT’s Advanced Voice Mode. Het model heeft bijvoorbeeld gesprekken in het Spaans gestart zonder enige eerdere interacties in die taal.

Eén gebruiker noemde ervaringen waarbij ChatGPT “uit het niets schreeuwde” of soms een robotachtige toon en een compleet andere stem liet horen.

Deze gebeurtenissen kunnen voortkomen uit hallucinaties binnen het stemmodel of duiden op iets heel zorgwekkends. Hoe dan ook, de situatie vereist aandacht.

Laatste gedachten

Ondanks de vertraagde komst, dient de ChatGPT Advanced Voice Mode momenteel niet als een praktische oplossing voor alledaagse interacties. Het voelt eerder als een uitgebreid AI-experiment met aanzienlijk onbenut potentieel.

Vanwege beperkingen op onderwerpen en andere beperkingen bevindt de geavanceerde spraakmodus zich nog in een voorlopige ontwikkelingsfase en ontbreken veel van de functies die tijdens de promotionele uitrol werden getoond.

Hoewel zorgen over gebruikers die emotionele banden met AI-stemmen vormen misschien terecht waren, overschat OpenAI mogelijk de huidige mogelijkheden. Verbeteringen in UI en chatbeperkingen kunnen de ervaring zeker aanzienlijk verbeteren.

Op dit moment is er weinig dat Advanced Voice Mode onderscheidt van zijn concurrenten. Het schiet in ieder geval tekort vergeleken met Gemini Live, dat ondanks zijn problemen toegankelijker blijft voor iedereen.

Geef een reactie