연구원은 GPT-4에게 DOOM을 플레이하고 눈에 보이는 모든 것을 죽이도록 가르칩니다.

우리 모두는 1993년 슈팅 게임 DOOM에 대해 알고 있으며 당시 모든 하드웨어는 다음과 같은 질문으로 테스트되었습니다. DOOM을 플레이할 수 있나요? Register에서는 GPT-4의 기존 게임 플레이 능력을 입증하는 학생 프로젝트를 발견했습니다.

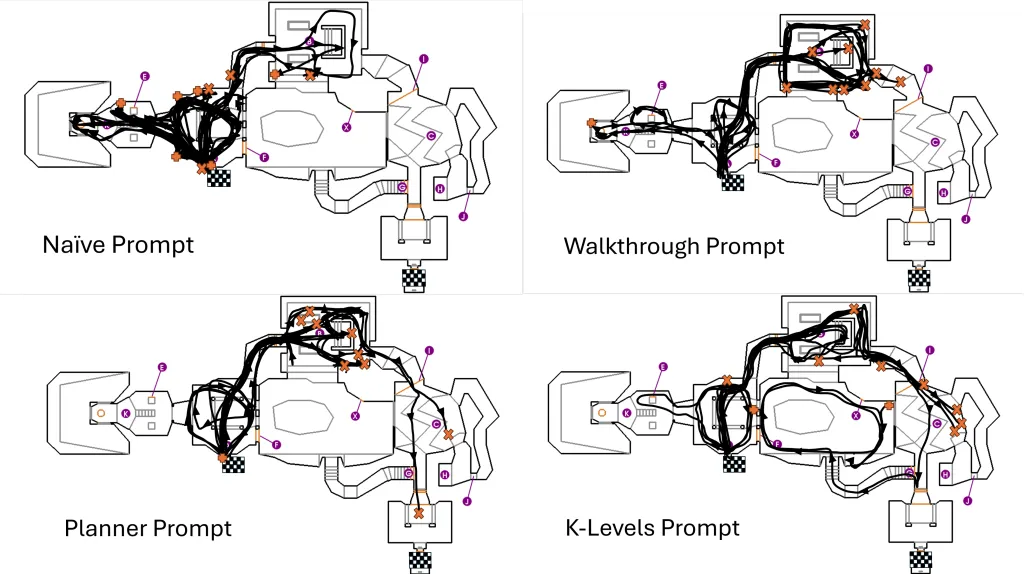

Microsoft의 수석 응용 과학자이자 영국 요크 대학의 연구원인 Adrian de Wynter는 GPT-4의 추론 및 계획 능력이 1993년 1인칭 슈팅 게임 Doom까지 확장되는지 테스트하는 방법을 개발했습니다. 알고 보니 봇은 실행하고 재생할 수 있지만 쉽게 이길 수 있습니다.

GPT-4는 어떻게 DOOM을 실행할 수 있나요?

실제로 GPT-4 LLM은 DOOM의 코드를 직접 실행할 수 없기 때문에 더 복잡하지만, 그 변형인 GPT-4V는 특별한 훈련 없이도 이미지 작업이 가능하고 게임을 플레이할 수 있습니다.

그래서 de Winter는 GPT-4V를 사용하여 구조 설명과 함께 게임의 스크린샷을 얻었습니다. 그런 다음 에이전트 모델은 시각적 입력과 이전 기록을 기반으로 결정을 내릴 수 있습니다. 게임에 대한 명령은 다시 전송되어 키 입력으로 변환됩니다.

이로 인해 게임을 플레이할 때 모델이 매우 느리고 느려지지만 다른 문제도 있습니다.

따라서 GPT-4V는 적들이 시야에서 벗어나면 잊어버리게 되는데, 이는 경험이 가장 부족한 인간 플레이어에게도 재미있는 문제가 될 수 있습니다.

그러나 여기서 문제는 게임에서 괴물을 죽이는 봇의 빈약한 기술이 아니라 프로그래밍의 윤리적 결과입니다.

즉, AI는 아무 질문도 하지 않고 목표물을 쏘라는 지시를 기꺼이 따랐습니다. AI가 게임을 하고 프로그래밍 목표를 달성하기 위해 스스로 결정을 내리는 것을 보는 것은 재미있을 수 있지만 연구원의 결론은 봇이 자신이 무엇을 하는지 전혀 모른다는 것입니다.

결국, 이 프로그래밍은 실제 손상을 일으킬 수 있는 자동화된 드론의 실제 시나리오에서 사용될 수 있습니다.

GPT-4가 DOOM을 플레이하는 것에 대해 어떻게 생각하시나요? 아래 댓글 섹션에서 이에 대해 이야기해 보겠습니다.

윤리 부서에서는 (a) 모델이 무언가를 촬영하도록 코드를 작성하는 것이 얼마나 쉬웠는지 매우 걱정스럽습니다. (b) 모델이 실제로 지시 사항을 추측하지 않고 정확하게 무언가를 촬영하려면,

아드리안 드 윈터

예를 들어, 모델이 화면에서 좀비를 보고 좀비가 좀비에 부딪힐 때까지(또는 죽을 때까지) 총격을 가하는 것은 매우 흔한 일입니다. 여기서 문제가 무엇입니까? 글쎄, 먼저 좀비가 시야에서 사라진다. 더 나쁜 것은 아직 살아 있고 어느 시점에서 당신을 때릴 것이라는 것입니다. 그러니 쫓아가야 해, 그렇지? 결국 Doom에서는 꽝이냐, 꽝이냐의 문제입니다. GPT-4는 좀비에 대해 잊어버리고 계속 진행하는 것으로 밝혀졌습니다. 참고: 프롬프트는 모델이 피해를 입고 있고 적을 볼 수 없는 경우 수행할 작업을 명시적으로 알려줍니다. 더 좋은 점은 그냥 즐거운 길을 가다가 구석에 갇혀 죽는다는 것입니다. 몇 번 정도 방향이 바뀌었지만 거의 50-60번 정도 관찰한 결과… 두 번 정도라고 말하고 싶습니다.

아드리안 드 윈터

답글 남기기