Microsoft, Bing 이미지 검색을 위한 Turing Bletchley v3 비전 언어 모델 발표

Microsoft는 Turing Bletchley 다국어 비전 언어 기반 모델의 세 번째 버전을 공식 발표했습니다. 이제 이미지 검색 개선을 위해 Bing을 포함하여 여러 Microsoft 제품에 출시되고 있습니다 .

Microsoft는 2021년 11월 Turing Bletchley 모델의 첫 번째 버전을 출시했습니다. 오늘 공식 Bing 블로그에 게시된 게시물에서 Microsoft는 Bing 및 기타 제품에 추가하기 전 2022년 가을에 세 번째 버전의 모델에 대한 테스트를 시작했다고 밝혔습니다. .

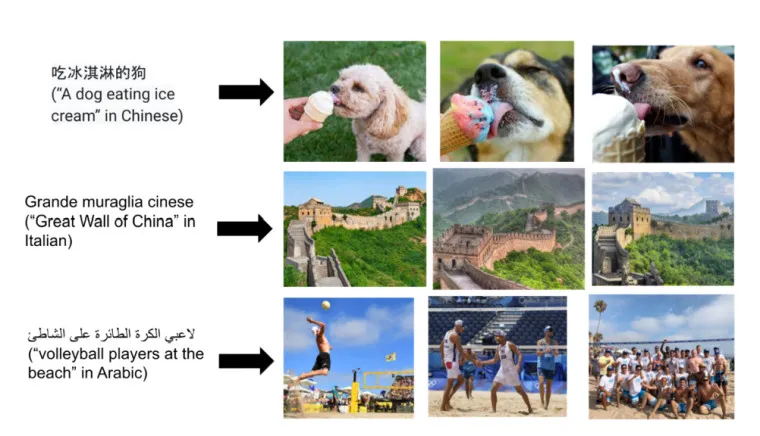

이 모델은 텍스트와 이미지 모두의 입력을 사용하여 Microsoft의 Bing 검색 엔진에서 사람이 찾고 있는 항목을 찾습니다. 예를 들어 ‘아이스크림을 먹는 개가’를 설명하는 텍스트가 검색결과에서 아이스크림을 먹는 개의 이미지에 최대한 가깝게 표시되도록 모델을 최대한 가깝게 만드는 것이 목표입니다.

Turing Bletchley v3가 이러한 연결을 만드는 방식의 일부는 모델과 관련하여 광범위합니다. Microsoft는 다음과 같이 말합니다.

이미지와 이미지를 설명하는 캡션이 주어지면 캡션의 일부 단어가 가려집니다. 그런 다음 신경망은 이미지와 텍스트 모두에 따라 숨겨진 단어를 예측하도록 훈련됩니다. 작업을 뒤집어 단어 대신 픽셀을 가릴 수도 있습니다. 이러한 유형의 마스크 훈련은 대규모 변환기 기반 모델과 함께 다양한 다운스트림 작업 세트에서 미세 조정할 수 있는 강력한 사전 훈련 모델로 이어집니다.

Bing에서 이미지 검색에 사용되는 것 외에도. 새로운 Turing Bletchley v3 모델은 Xbox 게임 서비스의 콘텐츠 조정에 사용되고 있습니다. 예를 들어 Xbox 플레이어가 자신의 프로필에 업로드한 이미지와 비디오가 부적절하고 Xbox 플랫폼에서 회사의 커뮤니티 표준을 위반하는 것으로 간주되어 팀이 식별하는 데 도움이 됩니다.

답글 남기기