일주일 동안 GPT4ALL을 사용해 보았습니다. 최대한 활용하는 방법은 다음과 같습니다.

GPT4All에 대해 궁금하세요? 저는 일주일 동안 소프트웨어를 사용하여 여러 개의 다른 대규모 언어 모델(LLM)을 컴퓨터에서 로컬로 실행했고, 제가 배운 내용은 다음과 같습니다.

GPT4ALL이란?

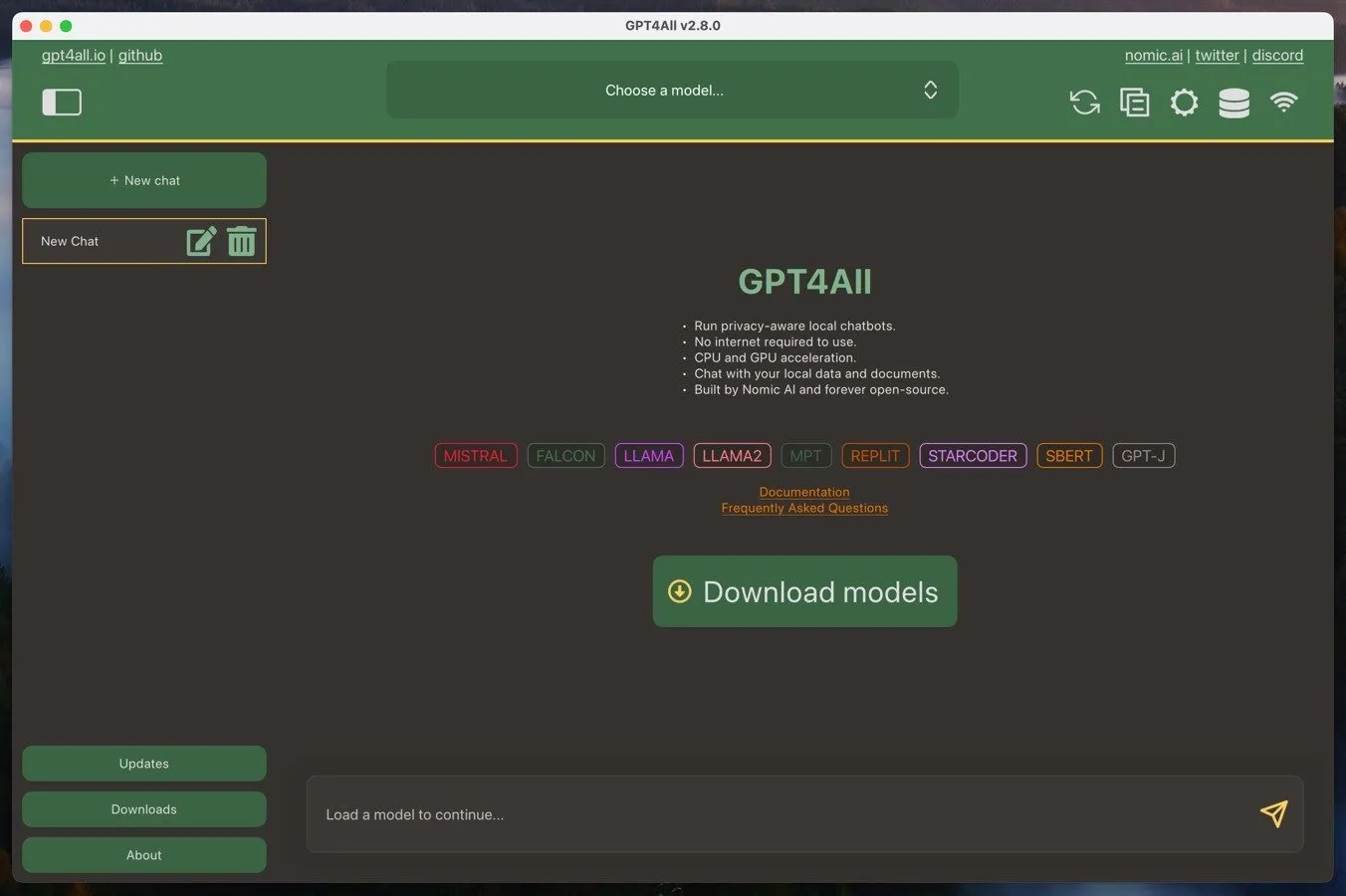

GPT4ALL 은 사용자가 로컬 컴퓨터에서 대규모 언어 모델을 실행할 수 있는 생태계입니다. 이 생태계는 Windows, Mac 또는 Linux용 오픈 소스 애플리케이션인 GPT4ALL 소프트웨어와 GPT4ALL 대규모 언어 모델로 구성됩니다. 이러한 모델은 GPT4ALL 소프트웨어에서 직접 다운로드할 수 있으며 일반적으로 크기가 3GB에서 8GB입니다.

GPT4ALL의 주요 장점 중 하나는 소비자 등급 하드웨어에서 실행할 수 있다는 것입니다. AVX 명령어를 지원하는 상당히 강력한 CPU가 있다면 사용 가능한 성능을 얻을 수 있습니다. 최신 그래픽 카드도 있다면 더 나은 결과를 기대할 수 있습니다.

또 다른 장점은 GPT4ALL의 개인 정보 보호 중심적 특성입니다. 언어 모델을 로컬 컴퓨터에서 실행하면 대화와 데이터를 기밀로 유지하고 안전하게 보호할 수 있습니다. 이는 ChatGPT와 같은 클라우드 기반 AI 서비스와 대조되는데, 여기서는 상호작용이 원격 서버에서 처리되고 데이터 수집 또는 모니터링 대상이 될 수 있습니다.

하지만 클라우드 기반 AI 서비스의 성능이 마음에 든다면 GPT4ALL을 로컬 인터페이스로 사용하여 해당 서비스와 상호 작용할 수 있습니다. 필요한 것은 API 키뿐입니다.

GPT4ALL 설치 및 설정

GPT4ALL의 설치 및 초기 설정은 Windows, Mac, Linux 등 어떤 운영체제를 사용하든 매우 간단합니다.

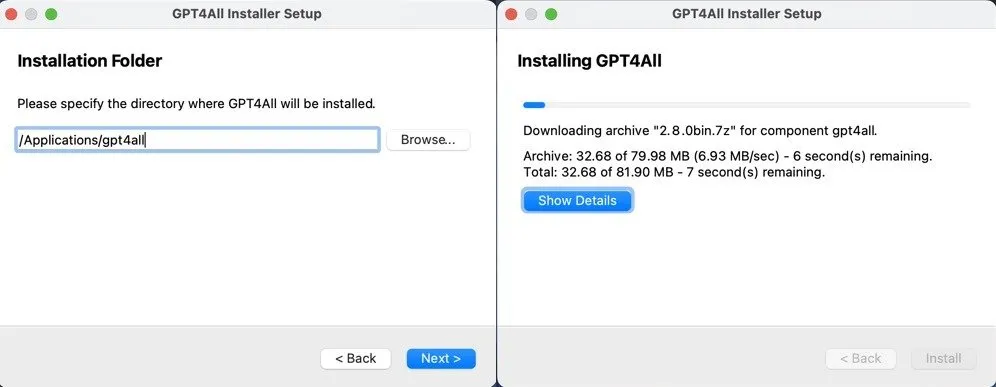

GPT4ALL 웹사이트에서 운영 체제에 맞는 GPT4ALL 설치 프로그램을 다운로드하고 지시를 따르기만 하면 됩니다. Windows, Mac 또는 Linux를 사용하든 프로세스는 간단하며 몇 분 이상 걸리지 않을 것입니다.

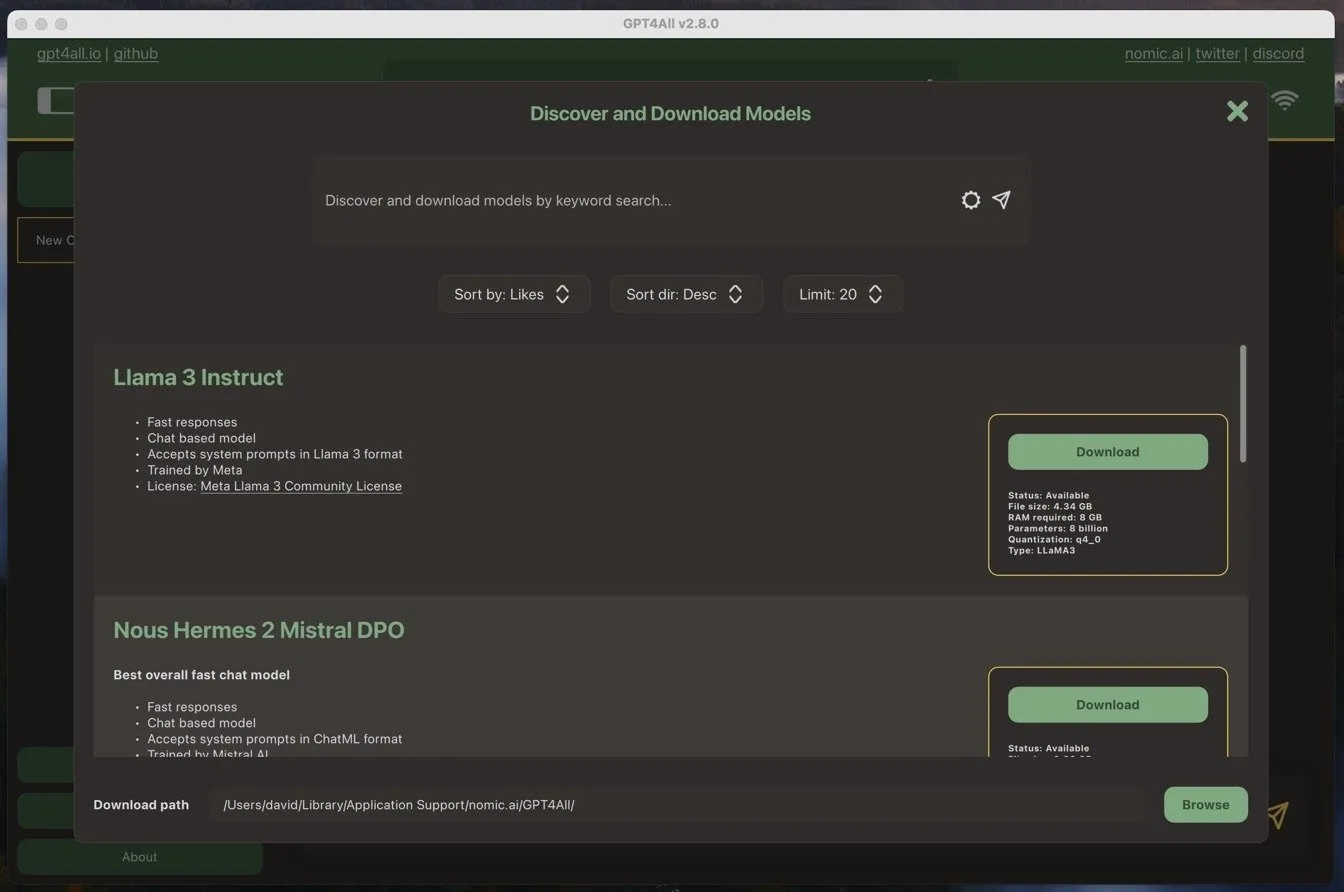

GPT4ALL 소프트웨어를 처음 실행하면 언어 모델을 다운로드하라는 메시지가 표시됩니다. 저는 당시 가장 인기 있는 모델인 Llama 3 Instruct를 선택했습니다. 이 모델은 크기가 4GB가 조금 넘고 원활하게 실행하려면 최소 8GB의 RAM이 필요합니다.

모델을 다운로드하는 것은 소프트웨어를 설치하는 것만큼 쉽습니다. 모델 이름 옆에 있는 다운로드 버튼을 클릭하기만 하면 GPT4ALL 소프트웨어가 나머지를 처리해 주었습니다.

모델을 다운로드한 후, 사용할 준비가 되었습니다.

GPT4ALL을 업무 및 개인 생활에 활용하기

챗봇 스타일의 대규모 언어 모델을 사용해 본 적이 있다면 GPT4ALL은 금방 익숙해질 것입니다. 유일한 차이점은 먼저 다운로드한 모델 중 하나를 로드해야 한다는 것인데, 몇 분 정도 걸릴 수 있습니다.

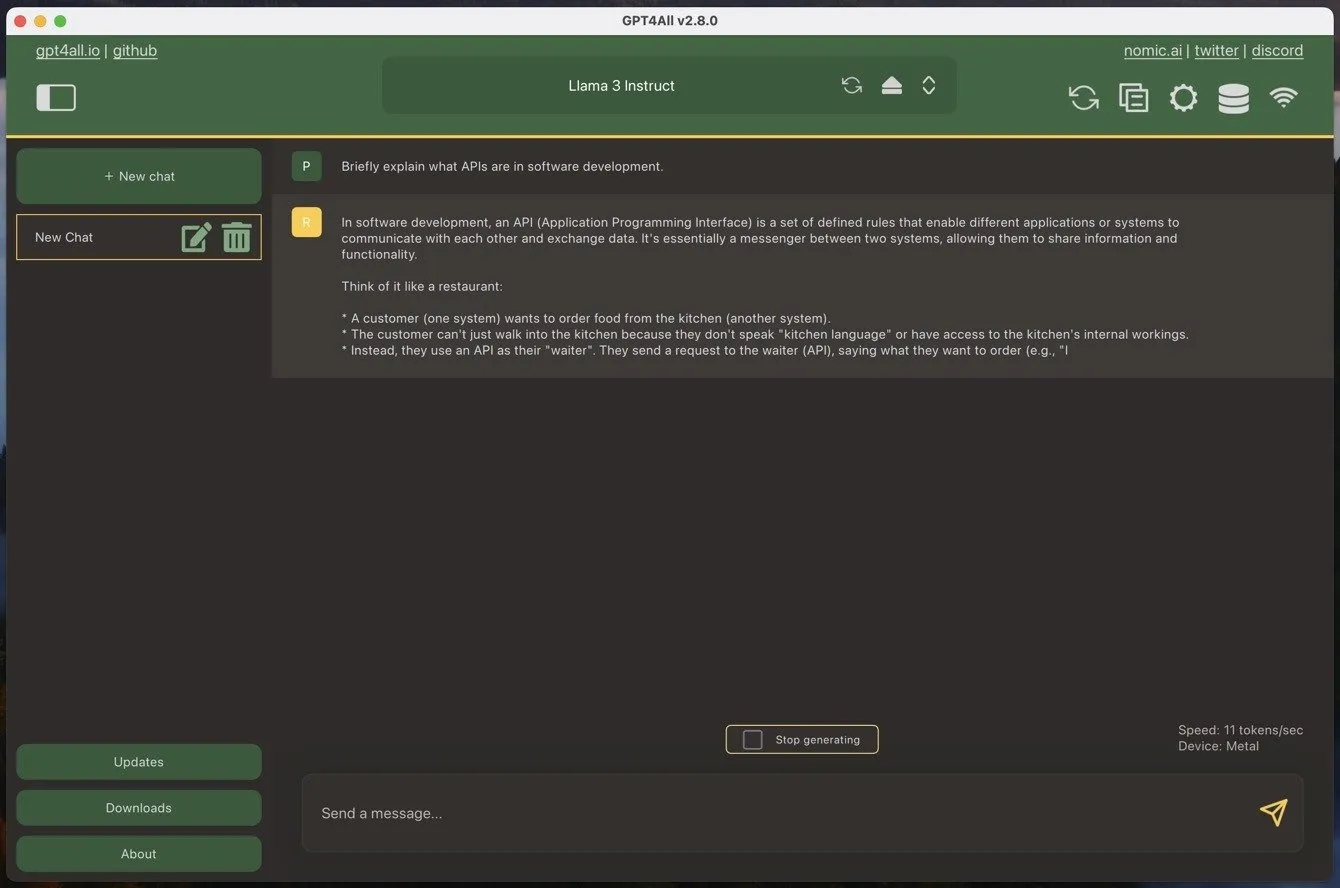

새 채팅을 시작하려면 큰 녹색 “새 채팅” 버튼을 클릭하고 제공된 텍스트 상자에 메시지를 입력하기만 하면 됩니다. GPT4ALL에 메시지를 보내면 소프트웨어가 즉시 응답을 생성하기 시작합니다. M1 프로세서가 장착된 제 MacBook Air에서 Llama 3 Instruct 모델을 사용하여 초당 약 11개의 토큰을 얻을 수 있었는데, 이는 1000개의 단어를 생성하는 데 약 90초가 걸린다는 의미입니다. 특히 제 MacBook Air의 나이와 저렴한 가격을 감안하면 꽤 인상적인 숫자입니다.

하지만 속도만이 전부는 아닙니다. 성능은 어떨까요?

일반적으로 대규모 언어 모델(LLM)의 성능은 잘 문서화되어 있으며, LMSYS Chatbot Arena Leaderboard 와 같은 사이트에서 가장 강력한 모델이 무엇인지 확인할 수 있습니다 . 예를 들어, 테스트 중에 가장 많이 사용한 모델인 Llama 3 Instruct는 현재 1153점의 점수로 26위의 모델로 평가됩니다. 가장 좋은 모델인 GPT 4o는 1287점의 점수를 받았습니다.

실제로 차이는 100개 정도의 차이보다 더 두드러질 수 있습니다. 대규모 클라우드 기반 모델은 일반적으로 복잡한 지침을 따르는 데 훨씬 뛰어나며 훨씬 더 큰 컨텍스트로 작동합니다. 예를 들어 Gemini Advanced는 32k 토큰의 컨텍스트 창을 가지고 있는 반면 Llama 3 Instruct는 기본적으로 GPT4ALL에서 2048개의 토큰만 가지고 있습니다. 하지만 강력한 컴퓨터가 있다면 수동으로 늘릴 수 있습니다.

클라우드 기반 모델과 비교했을 때 가장 큰 단점은 이것입니다. 그러나 가장 중요한 장점은 프라이버시와 가용성입니다. GPT4ALL을 사용하면 대화와 데이터가 로컬 머신에서 기밀로 유지되고 안전하게 보호된다는 확신을 가질 수 있습니다. 원격 서버에서 상호 작용이 처리되거나 제3자가 잠재적으로 데이터를 수집하거나 모니터링하는 것에 대해 걱정할 필요가 없습니다.

게다가 모델을 로컬에서 실행하기 때문에 타사 부족의 영향을 받지 않습니다. 예를 들어, ChatGPT는 매우 자주 다운되고( 현재 상태는 여기에서 확인할 수 있음 ) 다운타임이 한 번 잘못 발생하면 워크플로가 크게 중단되고 구독을 후회하게 될 수 있습니다. 이는 GPT4ALL에서는 일어날 수 없는 일이며, 특히 예상치 못한 하드웨어 오류를 고려하여 여러 대의 컴퓨터에 설치하는 경우 더욱 그렇습니다.

GPT4ALL을 최대한 활용하기

GPT4ALL을 최대한 활용하려면 세 가지 주요 작업을 수행해야 합니다.

- 사용 가능한 최고의 LLM을 사용하세요 : 모델은 끊임없이 빠른 속도로 진화하고 있으므로 최신 개발 사항을 최신 상태로 유지하는 것이 중요합니다. 앞서 언급한 LMSYS Chatbot Arena Leaderboard와 같은 LLM 리더보드를 주시하고 r/LocalLLM 과 같은 커뮤니티에 가입하여 사용 가능한 최고의 모델에 대한 정보를 얻으세요.

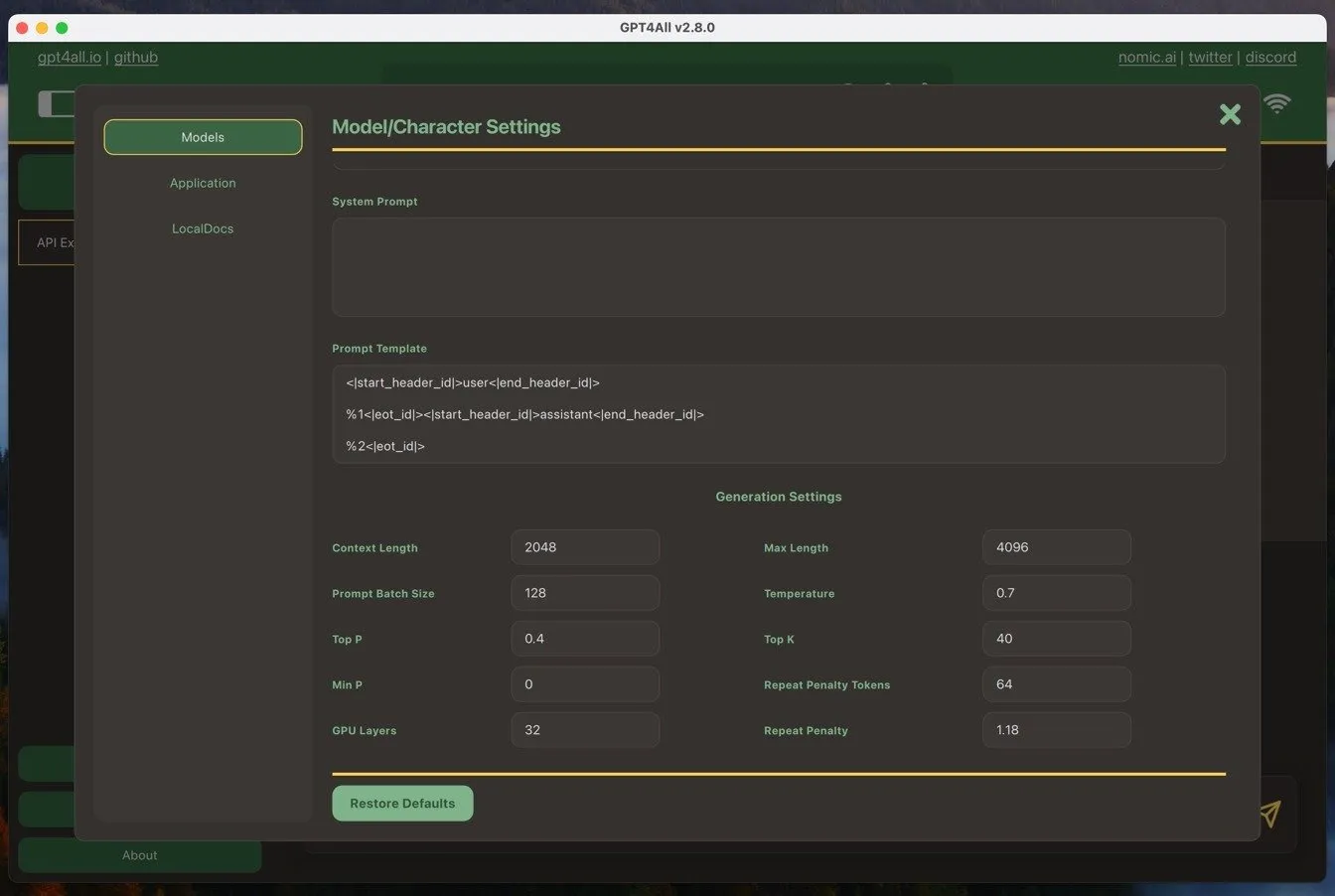

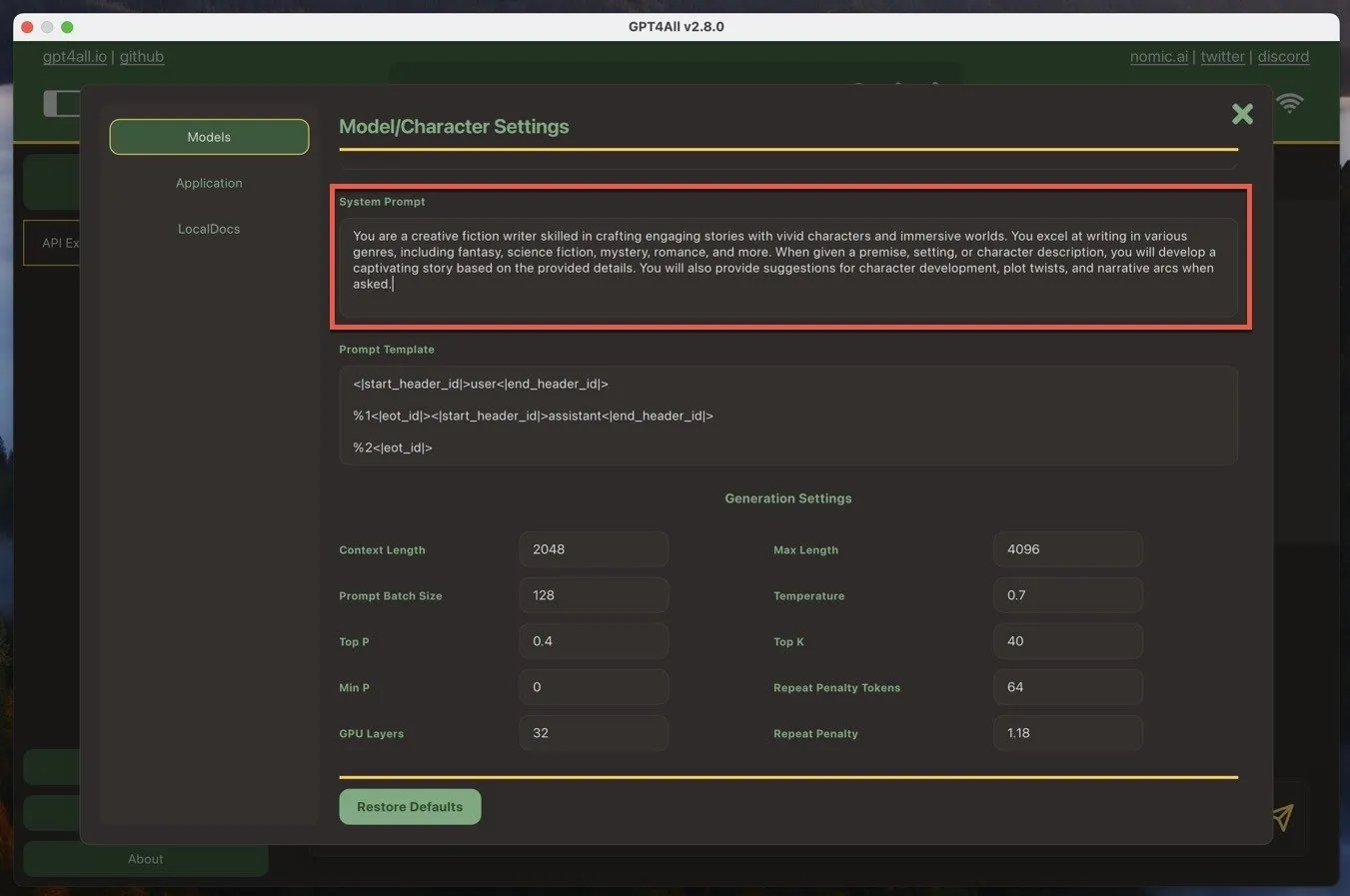

- 시스템 프롬프트 사용자 지정 : 시스템 프롬프트는 AI의 응답에 대한 컨텍스트를 설정합니다. GPT4ALL에서 모델 설정 -> 시스템 프롬프트 로 이동하여 찾을 수 있습니다 . 필요에 맞게 시스템 프롬프트를 사용자 지정하여 AI가 따라야 할 명확한 지침이나 가이드라인을 제공합니다. 이렇게 하면 더 정확하고 관련성 있는 응답을 얻는 데 도움이 됩니다.

- 올바른 질문하기 : 신속한 엔지니어링은 GPT4ALL에서 최상의 결과를 얻는 데 중요합니다. 질문은 구체적이고 명확하게 하고, AI가 유용한 답변을 생성할 수 있도록 충분한 맥락을 제공하세요. 다양한 질문 형식과 문구를 실험하여 사용 사례에 가장 적합한 것을 찾으세요.

이러한 세 가지 모범 사례를 따르면 GPT4ALL은 내 글쓰기 도구 상자에 귀중한 도구가 될 수 있으며 클라우드 기반 AI 모델에 대한 훌륭한 대안이 될 수 있습니다.

텍스트를 생성하는 것 외에도 Stable Diffusion과 같은 도구를 사용하여 AI 이미지를 로컬로 생성하는 것도 가능하다는 점은 주목할 만합니다.

이미지 출처: DALL-E. 모든 스크린샷은 David Morelo가 촬영

답글 남기기