I migliori strumenti gratuiti per eseguire LLM in locale su PC Windows 11

Stai cercando di proteggere i tuoi dati e di assicurarti che rimangano sul tuo dispositivo? Molti servizi LLM basati su cloud impongono costi di abbonamento continui legati all’utilizzo dell’API. Inoltre, le persone in località remote o quelle con accesso a Internet incoerente spesso non favoriscono queste soluzioni cloud. Quindi, quali alternative sono disponibili?

Fortunatamente, l’utilizzo di strumenti LLM locali può aiutare a eliminare queste spese, consentendo agli utenti di utilizzare modelli direttamente sul proprio hardware personale. Questi strumenti consentono l’elaborazione dei dati senza una connessione Internet, assicurando che le tue informazioni rimangano inaccessibili ai server esterni. Inoltre, forniscono un’interfaccia su misura specificatamente per il tuo flusso di lavoro.

Questa guida presenta un elenco selezionato di strumenti LLM locali gratuiti che soddisfano le tue esigenze in termini di privacy, convenienza e prestazioni.

I migliori strumenti LLM gratuiti per PC Windows 11

Di seguito sono riportati alcuni eccezionali strumenti LLM locali gratuiti che sono stati sottoposti a test e valutazioni approfonditi.

- gennaio

- Studio LM

- GPT4ALL

- QualsiasiLLM

- Essere

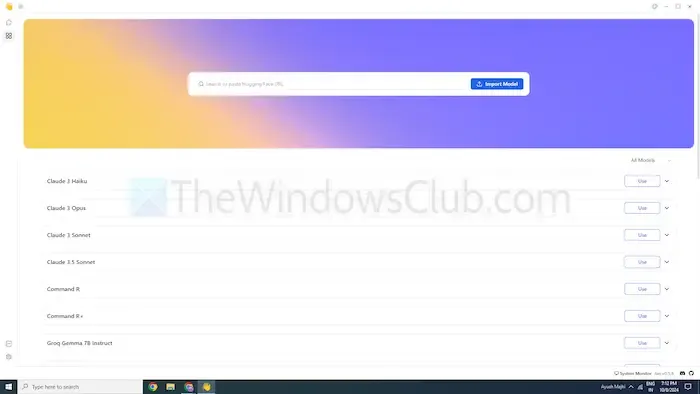

1] gennaio

Se hai familiarità con ChatGPT, Jan è uno strumento simile progettato per funzionare offline. Funziona esclusivamente sul tuo dispositivo, consentendoti di creare, analizzare ed elaborare privatamente testo sulla tua rete locale.

Jan presenta modelli di alto livello come Mistral, Nvidia o OpenAI, consentendo l’utilizzo senza inviare dati a server esterni. Ciò lo rende una scelta eccellente per gli utenti che danno priorità alla sicurezza dei dati rispetto alle opzioni basate su cloud.

Caratteristiche

- Modelli preconfigurati: dotati di modelli di intelligenza artificiale pronti all’uso che non richiedono alcuna installazione aggiuntiva.

- Personalizzazione: personalizza i colori della dashboard e scegli un tema uniforme o trasparente.

- Controllo ortografico: utilizza questa funzione per correggere gli errori ortografici.

Professionisti

- Consente l’importazione di modelli tramite la sorgente Hugging Face.

- Supporta le estensioni per una maggiore personalizzazione.

- Completamente gratuito.

Contro

- Supporto limitato da parte della comunità, con conseguente riduzione dei tutorial e delle risorse disponibili.

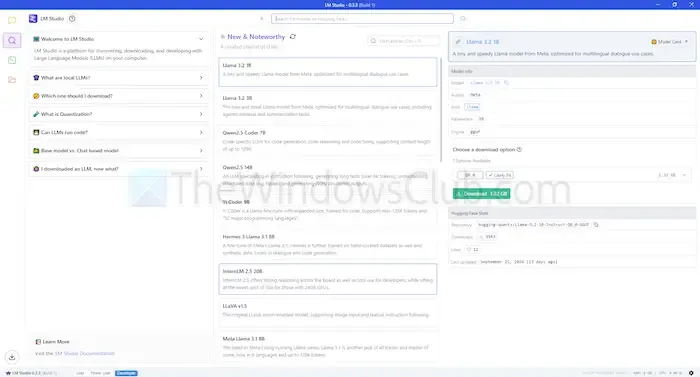

2] Studio LM

LM Studio è un altro strumento LLM locale che ti consente di utilizzare modelli linguistici come ChatGPT direttamente sul tuo computer. Offre modelli avanzati che migliorano la tua capacità di comprendere e rispondere alle query, mantenendo con precisione la localizzazione per una migliore privacy e controllo.

Questo strumento può riassumere documenti, generare contenuti, fornire risposte e persino assistere nella programmazione, il tutto mentre è in esecuzione in locale. Puoi valutare la compatibilità di vari modelli con il tuo sistema prima della distribuzione, assicurando un uso efficiente di tempo e risorse.

Caratteristiche

- Caricamento file e integrazione RAG: carica vari tipi di documenti come PDF, DOCX, TXT e CSV per risposte personalizzate.

- Ampie opzioni di personalizzazione: scegli tra diversi temi colore e livelli di complessità per l’interfaccia.

- Ricco di risorse: fornisce documentazione e risorse di apprendimento per gli utenti.

Professionisti

- Compatibile con Linux, Mac e Windows.

- Configurazione del server locale disponibile per gli sviluppatori.

- Offre una selezione curata di modelli linguistici.

Contro

- Potrebbe presentare delle difficoltà per i principianti, in particolare durante la configurazione iniziale.

3] GPT4ALL

GPT4ALL è un altro strumento LLM avanzato progettato per funzionare senza richiedere una connessione Internet o l’integrazione API. Questa applicazione è in grado di funzionare senza GPU, sebbene possa utilizzarle se disponibili, rendendola accessibile a una vasta gamma di utenti. Supporta varie architetture LLM, garantendo la compatibilità con molti modelli e framework open source.

Questo strumento impiega llama.cpp per il suo backend, migliorando le prestazioni sia su CPU che su GPU senza richiedere risorse di elaborazione di fascia alta. GPT4ALL funziona perfettamente con processori Intel e AMD, consentendogli di utilizzare GPU per velocità di elaborazione ottimizzate.

Caratteristiche

- Integrazione di file locali: i modelli possono interrogare e interagire con documenti locali come PDF o file di testo tramite Local Docs.

- Efficienza della memoria: molti modelli sono disponibili in versioni a 4 bit per ridurre i requisiti di memoria e di elaborazione.

- Vasto repository di modelli: GPT4ALL ospita oltre 1000 modelli open source da repository come Hugging Face.

Professionisti

- Open source e trasparente nelle operazioni.

- Offre soluzioni specifiche su misura per le aziende che desiderano utilizzare l’intelligenza artificiale offline.

- Forte attenzione alla privacy dell’utente.

Contro

- Supporto limitato per i processori ARM, come quelli utilizzati nei Chromebook.

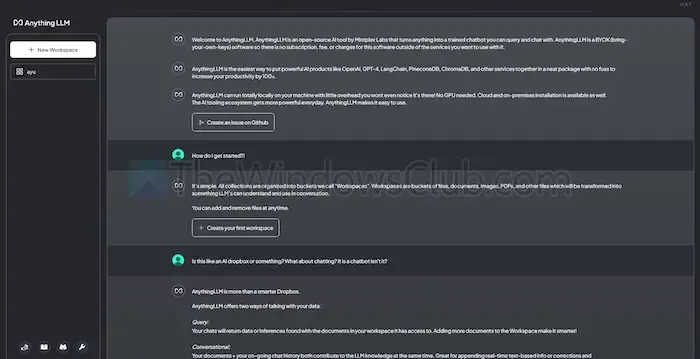

4] QualsiasiLLM

AnythingLLM è un LLM open source che consente un’ampia personalizzazione e garantisce un’esperienza AI privata. Consente agli utenti di implementare ed eseguire LLM offline sui loro dispositivi locali, indipendentemente dal fatto che utilizzino Windows, Mac o Linux, garantendo la totale riservatezza dei dati.

Questo strumento è particolarmente adatto per utenti individuali che cercano un’installazione semplice con una configurazione minima richiesta. Funziona in modo simile a un sistema ChatGPT privato che singoli individui o aziende possono implementare.

Caratteristiche

- Adatto agli sviluppatori: offre un’API completa per integrazioni personalizzate.

- Integrazione degli strumenti: possibilità di incorporare strumenti aggiuntivi e generare chiavi API.

- Installazione rapida: progettata per un’esperienza di installazione con un solo clic.

Professionisti

- Elevata flessibilità nell’utilizzo dell’LLM.

- Capacità incentrate sui documenti.

- Una piattaforma con agenti AI per automatizzare le attività degli utenti.

Contro

- Non supporta più utenti.

- Le funzionalità avanzate possono risultare difficili da utilizzare.

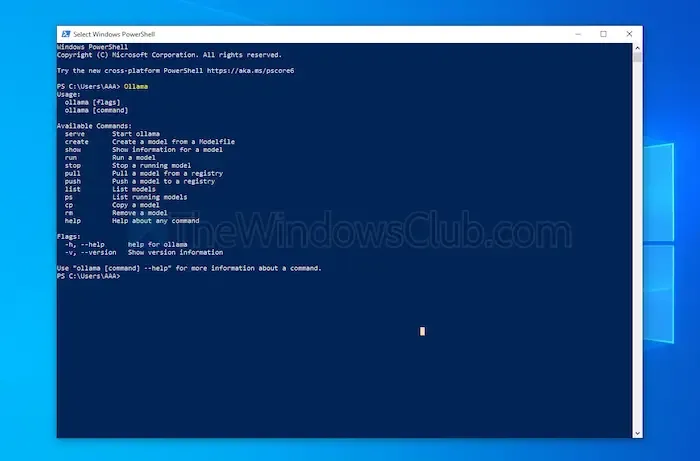

5] Essere

Ollama fornisce agli utenti il controllo completo sulla creazione di chatbot locali senza affidarsi alle API. Questo strumento beneficia attualmente di contributi significativi da parte degli sviluppatori, garantendo aggiornamenti e miglioramenti frequenti per una funzionalità migliorata. A differenza di altre opzioni discusse, Ollama funziona tramite un’interfaccia terminale per installazioni e lanci di modelli.

Ogni modello che installi può avere configurazioni e impostazioni di peso distinte, impedendo qualsiasi conflitto software sulla tua macchina. Inoltre, Ollama presenta un’API compatibile con OpenAI, consentendo un’integrazione senza sforzo con qualsiasi applicazione che utilizzi modelli OpenAI.

Caratteristiche

- Hosting di modelli locali: Ollama consente di eseguire offline modelli linguistici di grandi dimensioni, come Llama e Mistral.

- Personalizzazione del modello: gli utenti avanzati hanno la possibilità di modificare i comportamenti del modello tramite un Modefile.

- Integrazione con l’API OpenAI: Ollama include un’API REST in linea con l’offerta di OpenAI.

- Gestione delle risorse: garantisce un utilizzo efficiente delle risorse della CPU e della GPU per evitare il sovraccarico del sistema.

Professionisti

- Una vasta gamma di modelli diversi disponibili.

- Capacità di importare modelli da librerie come PyTorch.

- Si integra bene con il supporto di librerie estese.

Contro

- Non è fornita alcuna interfaccia utente grafica.

- Requisiti di archiviazione relativamente elevati.

Conclusione

In conclusione, gli strumenti LLM locali rappresentano un’eccellente alternativa ai modelli basati su cloud, garantendo maggiore privacy e pieno controllo senza costi. Che tu cerchi una semplice usabilità o ampie opzioni di personalizzazione, gli strumenti evidenziati soddisfano vari livelli di competenza e requisiti.

La scelta dello strumento giusto dipende da fattori quali capacità di elaborazione e compatibilità, consentendo di sfruttare la potenza dell’intelligenza artificiale senza sacrificare la privacy o incorrere in costi di abbonamento.

Lascia un commento