Il ricercatore insegna a GPT-4 a giocare a DOOM e uccidere tutto ciò che vede

Conosciamo tutti lo sparatutto DOOM del 1993 e all’epoca qualsiasi hardware veniva testato con la domanda: giocherà a DOOM? Il Register ha individuato un progetto studentesco che dimostra la capacità di GPT-4 di riprodurre il vecchio gioco.

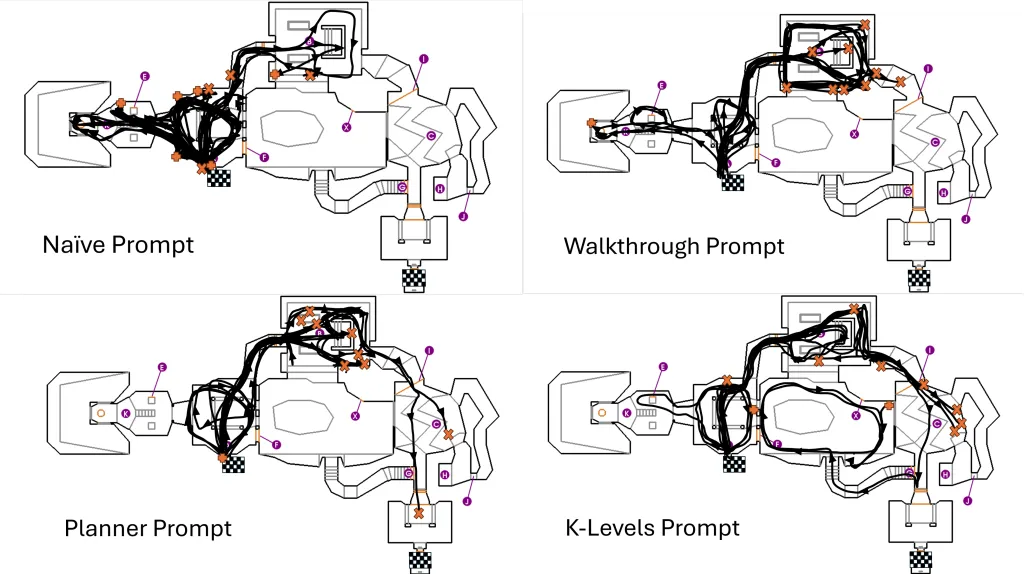

Adrian de Wynter, uno dei principali scienziati applicati della Microsoft e ricercatore presso l’Università di York in Inghilterra, ha sviluppato un metodo per verificare se le capacità di ragionamento e pianificazione di GPT-4 si estendono allo sparatutto in prima persona Doom del 1993. A quanto pare, sì, il bot può eseguirlo e riprodurlo, ma potresti batterlo facilmente.

Come può GPT-4 eseguire DOOM?

In realtà, è più complicato perché GPT-4 LLM non può eseguire direttamente il codice di DOOM, ma la sua variante, GPT-4V, può anche funzionare con le immagini e giocare senza alcuna formazione speciale.

Quindi, de Winter ha utilizzato GPT-4V per ottenere gli screenshot del gioco, insieme alle descrizioni della struttura. Quindi, un modello di agente può prendere decisioni in base all’input visivo e alla cronologia precedente. I comandi al gioco vengono rispediti e tradotti in sequenze di tasti.

Ciò rende il modello piuttosto lento e lento nel gioco, ma presenta anche altri problemi:

Quindi, GPT-4V si dimentica dei nemici se scompaiono dalla vista, il che potrebbe essere un problema esilarante anche per il giocatore umano più inesperto.

Ma il problema qui non sono le scarse capacità del bot nell’uccidere i mostri in un gioco, ma le implicazioni etiche della programmazione:

In altre parole, l’IA è stata più che felice di seguire le istruzioni per sparare ai bersagli senza fare domande. Anche se può essere divertente vedere un’intelligenza artificiale giocare e prendere le proprie decisioni per completare i propri obiettivi di programmazione, la conclusione del ricercatore è che il bot non ha idea di cosa sta facendo.

Dopotutto, questa programmazione potrebbe essere utilizzata in scenari reali per droni automatizzati che potrebbero produrre danni reali.

Cosa ne pensi di GPT-4 che gioca a DOOM? Ne parliamo nella sezione commenti qui sotto.

Per quanto riguarda il dipartimento di etica, è abbastanza preoccupante quanto sia stato facile per (a) me creare un codice per convincere il modello a girare qualcosa; e (b) che il modello possa sparare con precisione a qualcosa senza effettivamente indovinare le istruzioni,

Adriano de Wynter

Ad esempio, sarebbe molto comune per il modello vedere uno zombie sullo schermo e iniziare a sparargli finché non lo colpisce (o muore). Qual è il problema qui? Bene, prima di tutto lo zombie scompare dalla vista. Peggio ancora, è ancora vivo e ad un certo punto ti colpirà. Quindi devi inseguirlo, giusto? Dopotutto, in Doom, o colpisci o vieni colpito. Si scopre che GPT-4 si dimentica dello zombi e continua ad andare avanti. Nota: il messaggio dice esplicitamente al modello cosa fare se sta subendo danni e non può vedere un nemico. Meglio ancora, se ne va per la sua strada, rimane bloccato in un angolo e muore. Si è girato un paio di volte, ma in quasi 50-60 corse l’ho osservato… due volte, voglio dire.

Adriano de Wynter

Lascia un commento