Il brevetto Microsoft svela la tecnologia per prevenire le allucinazioni dell’intelligenza artificiale

Uno dei principali ostacoli che l’intelligenza artificiale deve affrontare oggi è la sua propensione alle allucinazioni, il che significa che può generare informazioni fuorvianti o inventate mentre tenta di completare le attività. Sebbene la maggior parte dei sistemi di intelligenza artificiale utilizzi risorse online per fornire risposte accurate, conversazioni prolungate possono talvolta portare l’intelligenza artificiale a fare affidamento su informazioni infondate.

All’inizio di quest’anno, Microsoft ha iniziato a sviluppare una soluzione per affrontare le allucinazioni dell’intelligenza artificiale e ha anche pubblicato un documento di ricerca che descrive in dettaglio una tecnologia brevettata volta a prevenire in modo preventivo queste imprecisioni.

Il documento intitolato “Interazione con un modello linguistico mediante conoscenza esterna e feedback” descrive in che modo funzionerebbe questo meccanismo.

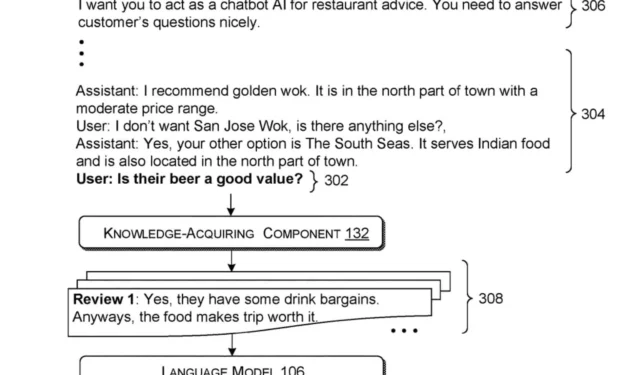

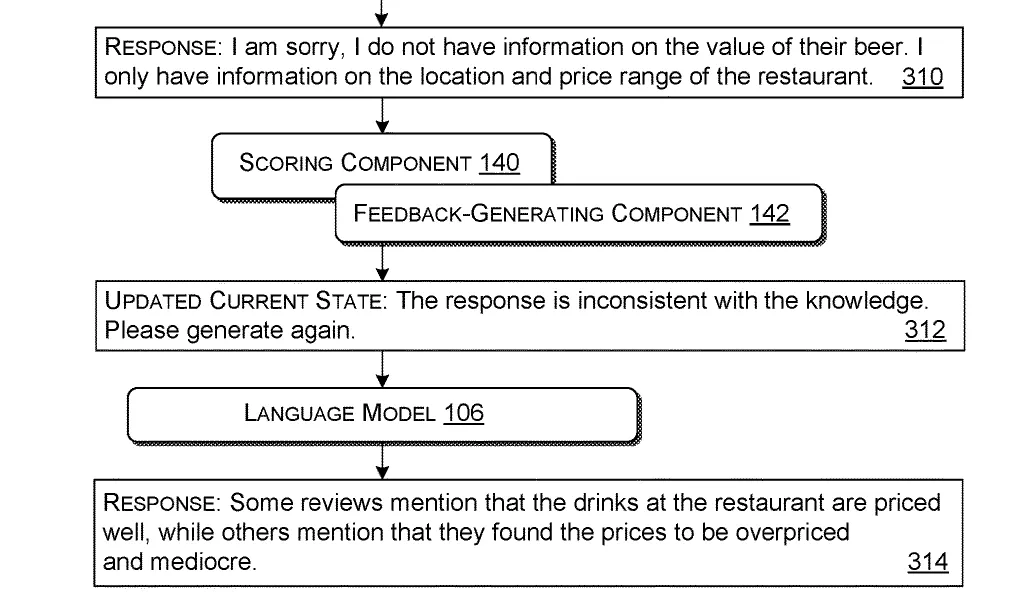

Questo sistema funziona elaborando una query, una domanda o una richiesta da parte di un utente. Prosegue recuperando informazioni rilevanti da fonti esterne in base a tale query. Successivamente, sintetizza queste informazioni insieme alla query originale in un pacchetto coeso adatto all’utilizzo del modello linguistico.

Una volta costruito il pacchetto, viene introdotto nel modello linguistico, addestrato a formulare risposte basate sull’input fornito. Il modello AI genera quindi una risposta iniziale basata su questo pacchetto di input.

Per garantire la pertinenza della risposta, il sistema impiega criteri predefiniti per valutare se l’output iniziale soddisfa gli standard di utilità. Se la prima risposta non ha valore (indicativo di allucinazioni dell’IA), il sistema costruisce un pacchetto di input migliorato che include feedback sulle informazioni errate o mancanti.

Questo input appena rivisto viene reimmesso nel modello linguistico, che quindi produce una risposta aggiornata basata su queste informazioni perfezionate.

Questa tecnologia innovativa ha il potenziale non solo per combattere le allucinazioni dell’IA, ma anche per varie applicazioni nel mondo reale. Ad esempio, come spiegato nel documento, questo sistema potrebbe essere utilizzato dagli assistenti AI nei ristoranti, consentendo loro di fornire informazioni fattuali e verificate ai clienti e di adattare le loro risposte in base alle richieste dei clienti in evoluzione durante le conversazioni.

Questo processo iterativo migliora l’accuratezza e l’utilità delle risposte del modello linguistico, perfezionando costantemente l’input e il feedback.

Sebbene al momento si tratti solo di un brevetto, i concetti discussi suggeriscono che Microsoft è impegnata a migliorare la funzionalità e l’affidabilità dei suoi modelli di intelligenza artificiale, come Copilot.

Il colosso della tecnologia ha già espresso la sua ambizione di affrontare ed eliminare le allucinazioni nei modelli di intelligenza artificiale, delineando un futuro in cui informazioni accurate potranno essere generate in modo affidabile in funzioni come l’assistenza nei ristoranti.

Con strategie per eliminare le allucinazioni, i modelli di intelligenza artificiale potrebbero fornire risposte accurate senza ricorrere a informazioni errate. Se abbinata alle capacità vocali dell’ultimo Copilot, l’intelligenza artificiale potrebbe sostituire lavori entry-level, come i sistemi di assistenza clienti automatizzati.

Cosa pensi di questo sviluppo?

Potete leggere l’articolo completo qui .

Lascia un commento