Microsoft porta gli strumenti di integrità dei contenuti nell’UE con l’obiettivo di combattere la disinformazione

Il 2024 è l’anno delle elezioni, con oltre 60 paesi che si recheranno alle urne. E questa volta la disinformazione è al culmine. Notizie false, immagini generate dall’intelligenza artificiale, video, clip audio e media manomessi sono diventati grossi problemi. È qui che entra in gioco l’integrità dei contenuti di Microsoft.

Inizialmente rilasciato per le campagne politiche statunitensi, Microsoft sta ora portando la versione di anteprima degli strumenti di integrità dei contenuti nell’UE. Ciò aiuterà l’elettorato a identificare la disinformazione spesso reperibile online.

Inoltre, gli strumenti di integrità dei contenuti aiuteranno le campagne politiche e le redazioni, poiché aiutano i due a verificare se la sospetta disinformazione disponibile online proviene dai loro canali ufficiali o è stata modificata utilizzando l’intelligenza artificiale.

Le campagne politiche e le redazioni possono allegare credenziali di contenuto ai loro media originali per accertarne la fonte e identificare tentativi di manomissione. Qualsiasi modifica apportata ai media può essere verificata attraverso la cronologia delle modifiche una volta aggiunte le credenziali del contenuto.

Il blog ufficiale di Microsoft enumera i tre componenti di Content Integrity:

Provando il sito Web pubblico di integrità dei contenuti di Microsoft

Quindi, non appena Microsoft ha lanciato un sito Web di integrità dei contenuti , abbiamo pensato di testarne l’affidabilità. I risultati non furono troppo impressionanti. Ma inizialmente era previsto, dato che la maggior parte delle campagne politiche in tutto il mondo devono ancora integrare le credenziali di contenuto nei propri media ufficiali.

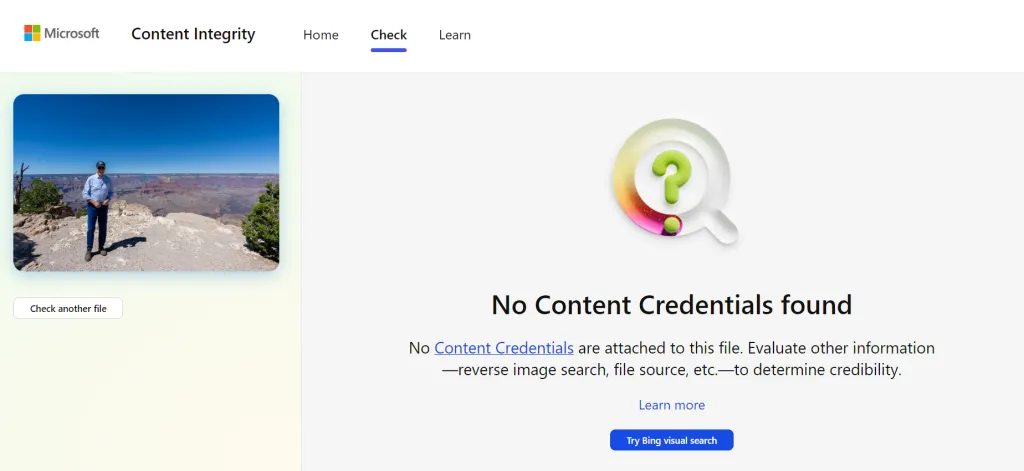

Dopo aver eseguito l’esecuzione delle immagini provenienti dagli handle ufficiali di X (in precedenza Twitter) del primo ministro britannico Rishi Sunak e del presidente degli Stati Uniti Joe Biden, lo strumento pubblicamente disponibile diceva: Nessuna credenziale di contenuto trovata.

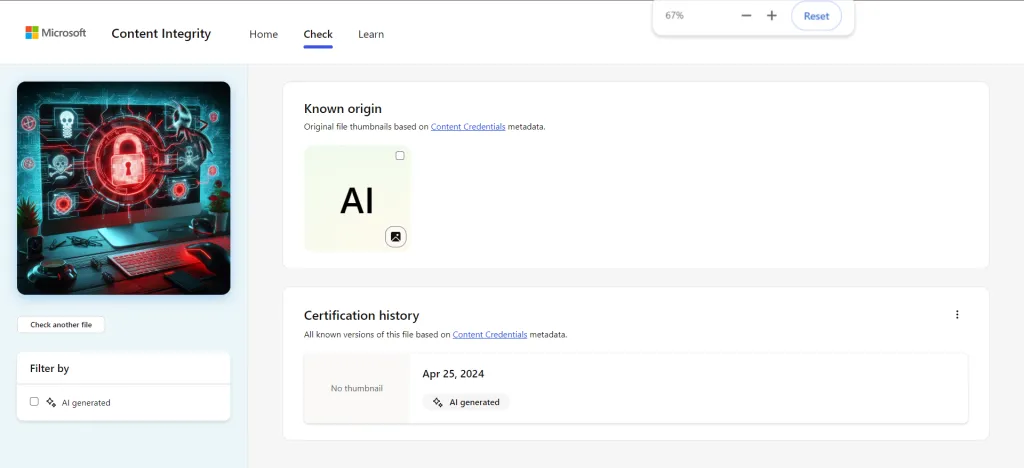

Quindi, abbiamo eseguito un’immagine generata dall’intelligenza artificiale da Copilot. Questa volta, lo strumento è stato in grado di identificare la fonte dell’immagine e di etichettarla come generata dall’intelligenza artificiale.

Ci aspettiamo risultati migliori dal Content Integrity di Microsoft poiché sempre più campagne politiche, candidati e redazioni allegano credenziali di contenuto ai propri media.

Pubblicato all’inizio di quest’anno, un rapporto del Center of Countering Digital Hate (CCDH) spiega come gli strumenti basati sull’intelligenza artificiale di Microsoft vengono utilizzati per diffondere disinformazione durante le elezioni.

Inoltre, anche se Microsoft ha negato agli autori delle minacce l’accesso ai suoi strumenti di intelligenza artificiale, resta da vedere quanto sarebbe efficace, soprattutto nell’anno elettorale più importante!

Hai provato l’integrità dei contenuti di Microsoft? Se è così, condividi la tua recensione con i nostri lettori nella sezione commenti.

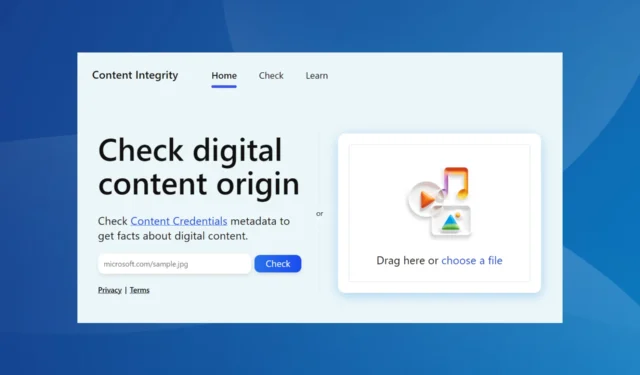

1. Un’applicazione Web privata di facile utilizzo disponibile per campagne politiche, testate giornalistiche e funzionari elettorali in modo che possano aggiungere credenziali di contenuto ai contenuti autorevoli di loro proprietà.2. Un’applicazione mobile privata per acquisire fotografie, video e audio sicuri e autenticati aggiungendo credenziali di contenuto in tempo reale da uno smartphone, sviluppata in collaborazione con Truepic.3. Un sito Web pubblico per verificatori di fatti e qualsiasi membro del pubblico per verificare l’esistenza di credenziali di contenuto in immagini, audio o video.

Lascia un commento