Microsoft apporte des outils d’intégrité du contenu à l’UE et vise à lutter contre la désinformation

2024 est l’année des élections, avec plus de 60 pays se rendant aux urnes. Et cette fois-ci, la désinformation est à son paroxysme. Les fausses nouvelles, les images, vidéos, clips audio et médias falsifiés générés par l’IA sont devenus des problèmes majeurs. C’est là qu’intervient l’intégrité du contenu de Microsoft.

Initialement publié pour les campagnes politiques américaines, Microsoft propose désormais la version préliminaire des outils Content Integrity dans l’UE. Ceux-ci aideront l’électorat à identifier les informations erronées souvent trouvées en ligne.

En outre, les outils d’intégrité du contenu faciliteront les campagnes politiques et les salles de rédaction, car ils les aideront à vérifier si les informations suspectes disponibles en ligne proviennent de leurs chaînes officielles ou ont été éditées à l’aide de l’IA.

Les campagnes politiques et les rédactions peuvent associer des informations d’identification de contenu à leurs médias d’origine pour vérifier la source et identifier les tentatives de falsification. Toute modification apportée au média peut être vérifiée via l’historique d’édition une fois les informations d’identification de contenu ajoutées.

Le blog officiel de Microsoft énumère les trois composants de l’intégrité du contenu :

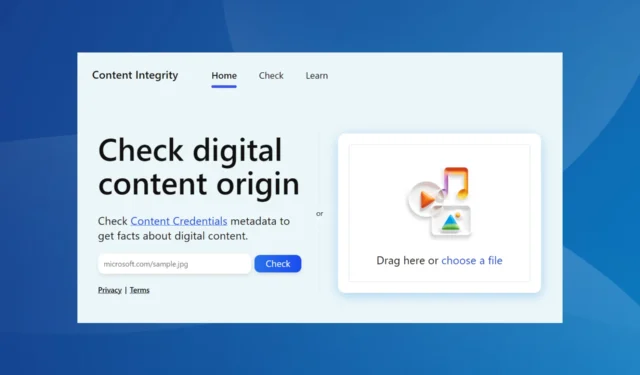

Essayer le site Web public d’intégrité du contenu de Microsoft

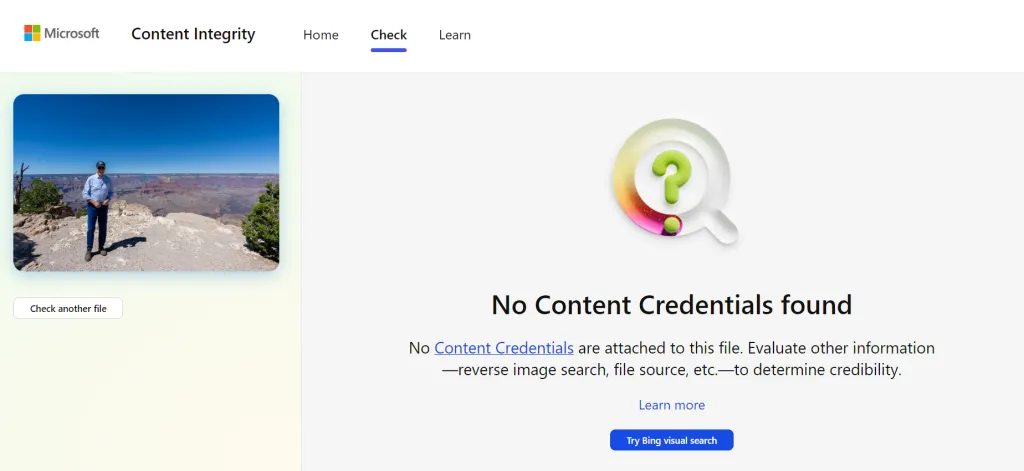

Ainsi, dès que Microsoft a lancé un site Content Integrity , nous avons pensé à tester sa fiabilité. Les résultats n’étaient pas trop impressionnants. Mais c’était initialement prévu, étant donné que la plupart des campagnes politiques à travers le monde n’ont pas encore intégré les informations d’identification de contenu dans leurs médias officiels.

Après avoir diffusé des images provenant des poignées officielles X (anciennement Twitter) du Premier ministre britannique Rishi Sunak et du président américain Joe Biden, l’outil accessible au public a lu : Aucune information d’identification de contenu trouvée.

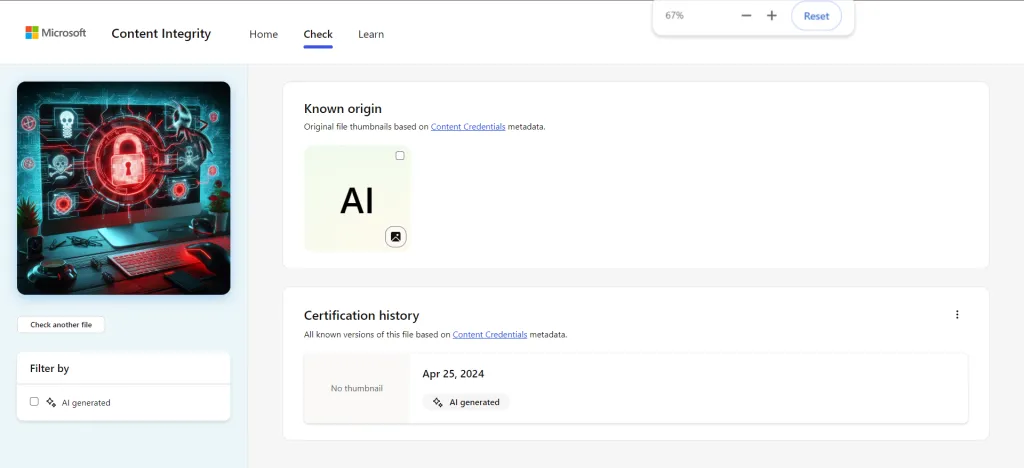

Ensuite, nous avons généré une image générée par l’IA à partir de Copilot. Cette fois, l’outil a pu identifier la source de l’image et l’étiqueter comme étant générée par l’IA.

Nous attendons de meilleurs résultats de la part de l’intégrité du contenu de Microsoft, à mesure que davantage de campagnes politiques, de candidats et de salles de rédaction attachent des informations d’identification de contenu à leurs médias.

Publié plus tôt cette année, un rapport du Centre de lutte contre la haine numérique (CCDH) explique comment les outils basés sur l’IA de Microsoft sont utilisés pour diffuser de la désinformation pendant les élections.

De plus, même si Microsoft a refusé aux acteurs malveillants l’accès à ses outils d’IA, il reste à voir dans quelle mesure cela serait efficace, en particulier au cours de la plus grande année électorale !

Avez-vous essayé l’intégrité du contenu de Microsoft ? Si tel est le cas, partagez votre avis avec nos lecteurs dans la section commentaires.

1. Une application Web privée facile à utiliser, disponible pour les campagnes politiques, les agences de presse et les responsables électoraux afin qu’ils puissent ajouter des informations d’identification de contenu à leur contenu faisant autorité.2. Une application mobile privée pour capturer des photographies, des vidéos et des fichiers audio sécurisés et authentifiés en ajoutant des informations d’identification de contenu en temps réel à partir d’un smartphone, développée en partenariat avec Truepic.3. Un site Web public permettant aux vérificateurs de faits et à tout membre du public de vérifier les images, les fichiers audio ou les vidéos pour détecter l’existence d’informations d’identification de contenu.

Laisser un commentaire