Cómo usar la difusión estable para crear imágenes generadas por IA

Los chatbots de inteligencia artificial, como ChatGPT, se han vuelto increíblemente poderosos recientemente: ¡están en todas las noticias! Pero no se olvide de los generadores de imágenes de IA (como Stable Diffusion, DALL-E y Midjourney). Pueden hacer prácticamente cualquier imagen cuando se les proporciona solo unas pocas palabras. Siga este tutorial para aprender cómo hacer esto de forma gratuita y sin restricciones ejecutando Stable Diffusion en su computadora.

¿Qué es la difusión estable?

Stable Diffusion es un modelo de aprendizaje automático de texto a imagen gratuito y de código abierto. Básicamente, es un programa que te permite describir una imagen usando texto y luego crea la imagen para ti. Se le dieron miles de millones de imágenes y descripciones de texto que las acompañaban y se le enseñó a analizarlas y reconstruirlas.

Stable Diffusion no es el programa que usa directamente; piense en él más como la herramienta de software subyacente que usan otros programas. Este tutorial muestra cómo instalar un programa Stable Diffusion en su computadora. Tenga en cuenta que hay muchos programas y sitios web que usan Stable Diffusion, pero muchos le cobrarán dinero y no le darán tanto control.

Requisitos del sistema

Las pautas aproximadas de lo que debe aspirar son las siguientes:

- macOS: Apple Silicon (un chip de la serie M)

- Windows o Linux: GPU NVIDIA o AMD

- RAM: 16GB para mejores resultados

- GPU VRAM: al menos 4 GB

- Almacenamiento: al menos 15GB

Instale la interfaz de usuario web AUTOMATIC1111

Estamos utilizando el programa AUTOMATIC1111 Web UI , disponible en todos los principales sistemas operativos de escritorio, para acceder a Stable Diffusion. Asegúrese de tomar nota de dónde se descarga el directorio «stable-diffiusion-webui».

Interfaz de usuario web AUTOMATIC1111 en macOS

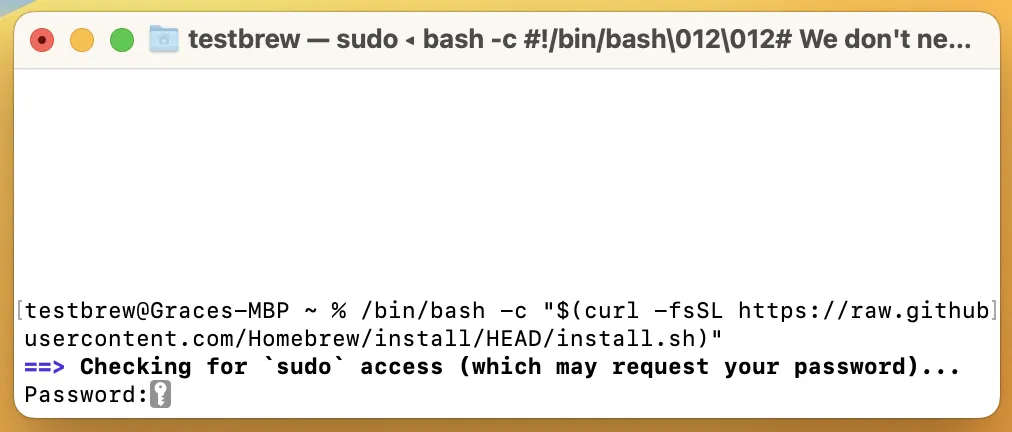

- En Terminal, instala Homebrew ingresando el comando:

/bin/bash -c "$(curl -fsSL https://raw.githubusercontent.com/Homebrew/install/HEAD/install.sh)"

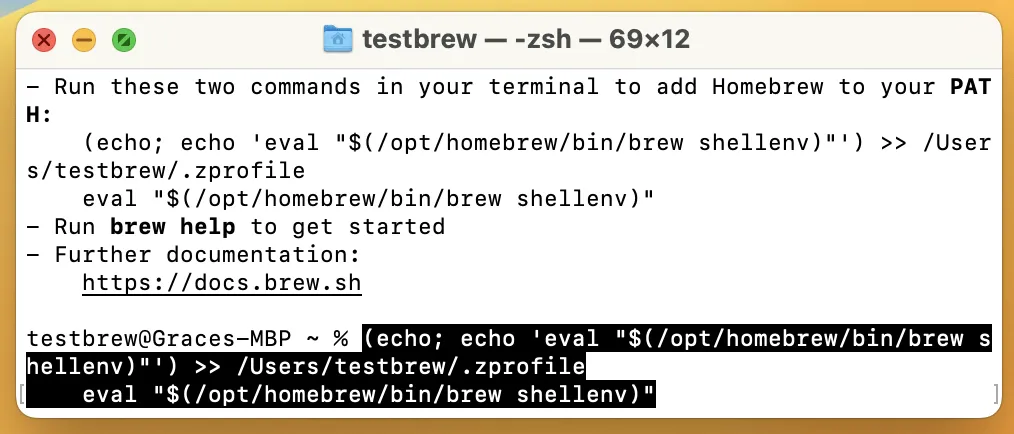

- Copie los dos comandos para agregar Homebrew a su RUTA e ingréselos.

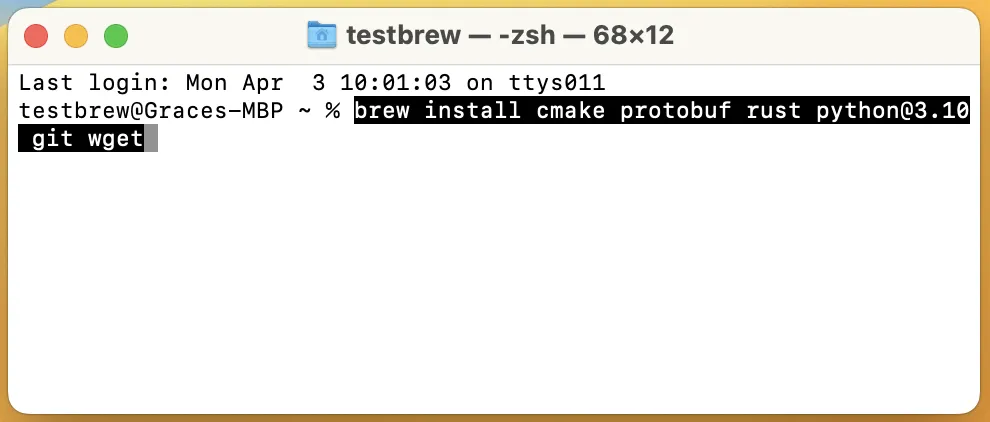

- Salga y vuelva a abrir la Terminal, luego ingrese:

brew install cmake protobuf rust python@3.10 git wget

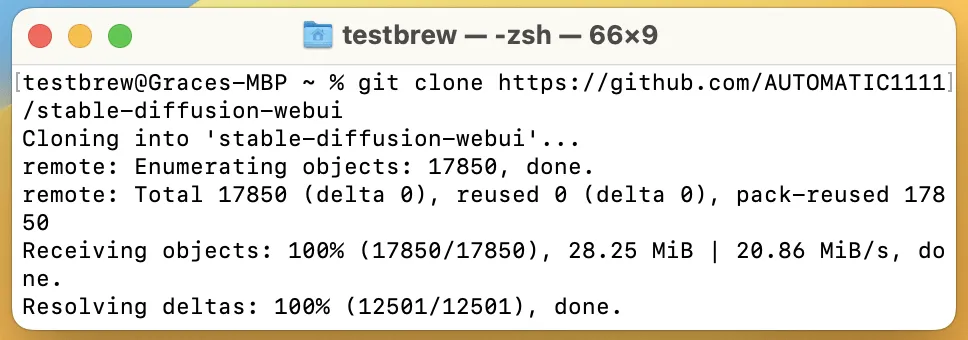

- Ingresar:

git clone https://github.com/AUTOMATIC1111/stable-diffusion-webui

Interfaz de usuario web AUTOMATIC1111 en Windows

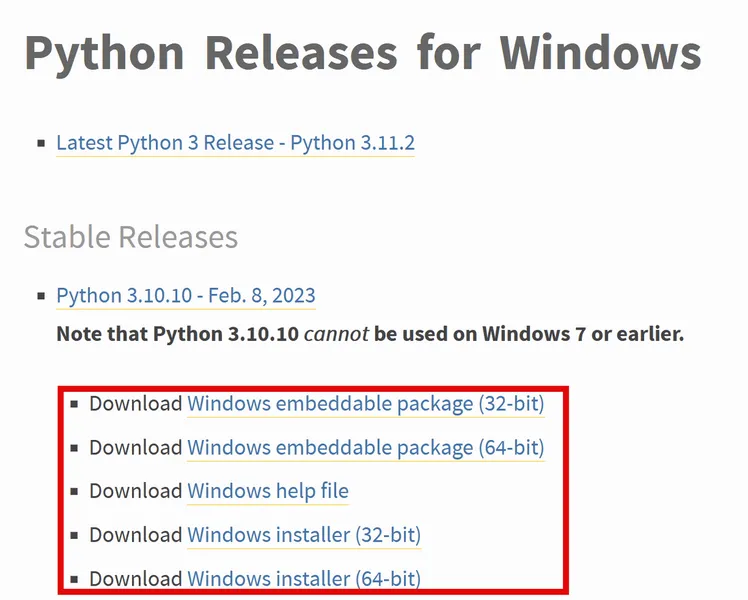

- Descargue la última versión estable de Python 3.10 .

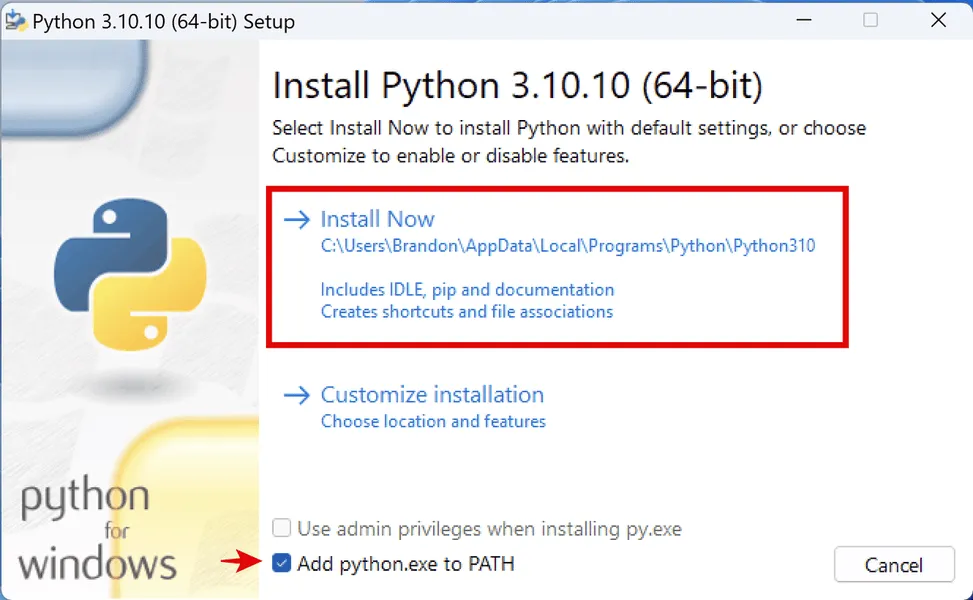

- Ejecute el instalador de Python, marque «Agregar python.exe a PATH» y haga clic en «Instalar ahora».

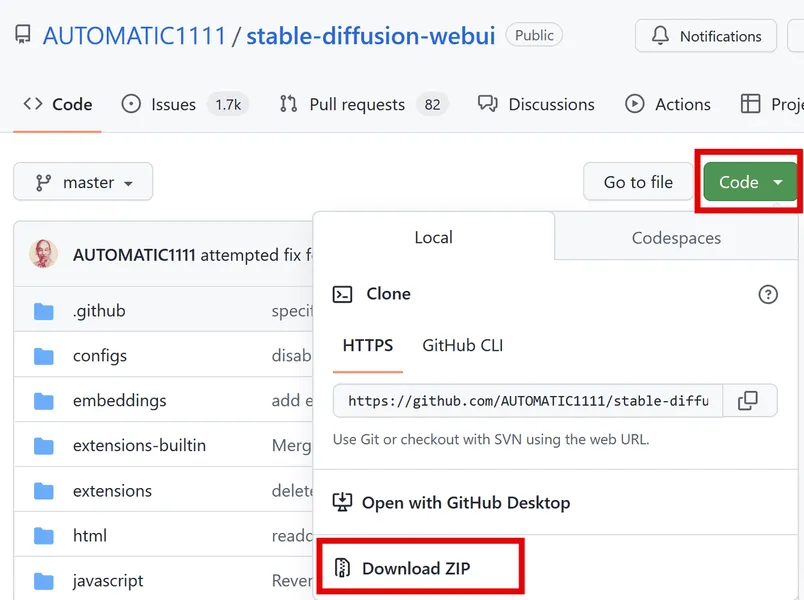

- Vaya al repositorio AUTOMATIC1111 Web UI en GitHub, haga clic en «Código», luego haga clic en «Descargar ZIP» y extráigalo.

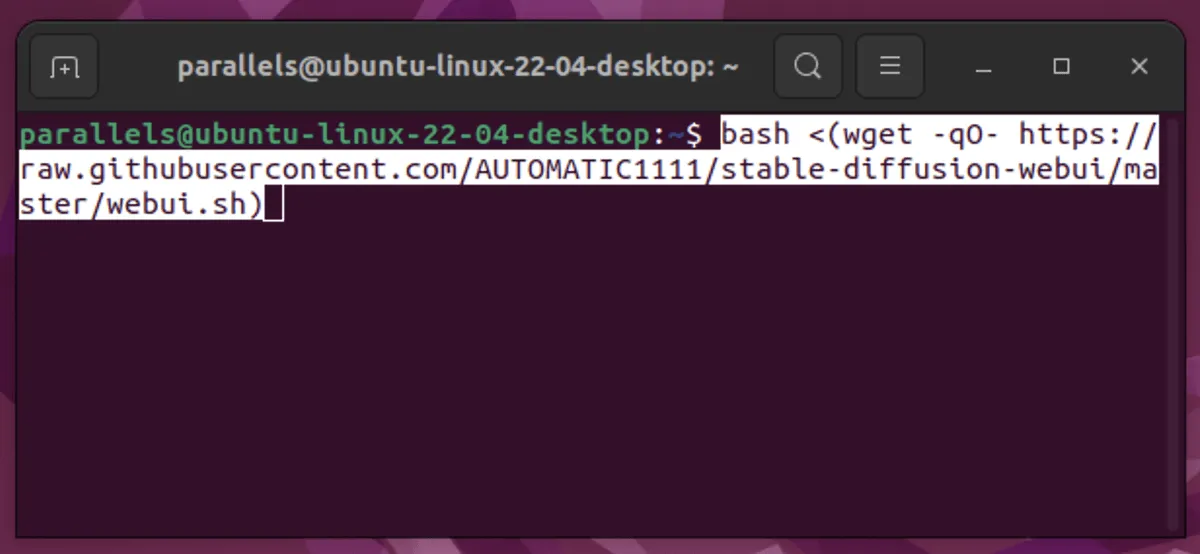

Interfaz de usuario web AUTOMATIC1111 en Linux

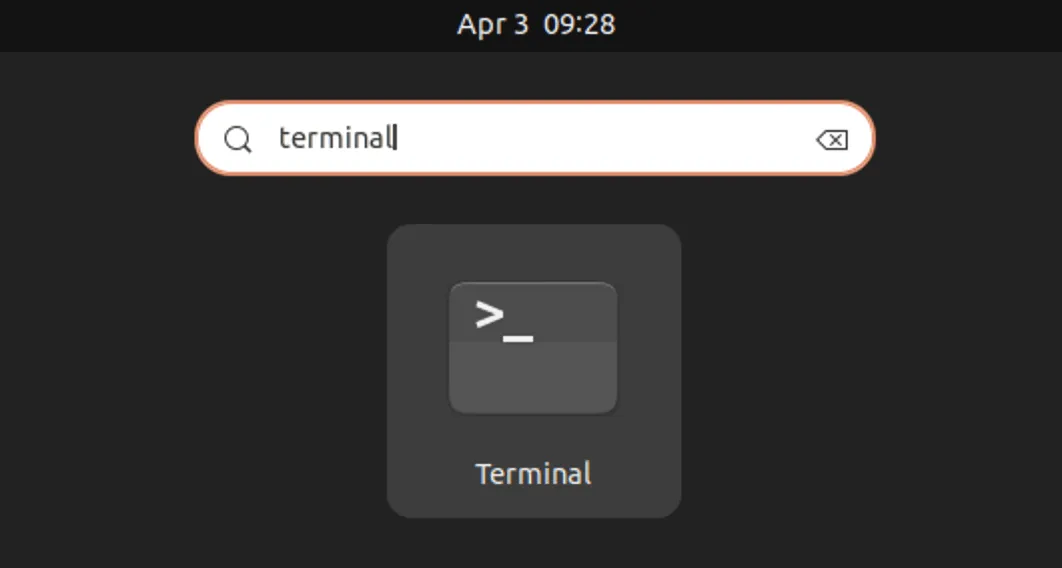

- Abre la Terminal.

- Ingrese uno de los siguientes comandos, según su versión de Linux:

Basado en Debian, incluido Ubuntu:

sudo apt-get updatesudo apt install wget git python3 python3-ven

Basado en Red Hat:

sudo dnf install wget git python3

Basado en arco:

sudo pacman -S wget git python3

- Instale en “/home/$(whoami)/stable-diffusion-webui/” ejecutando este comando:

bash <(wget -qO- https://raw.githubusercontent.com/AUTOMATIC1111/stable-diffusion-webui/master/webui.sh)

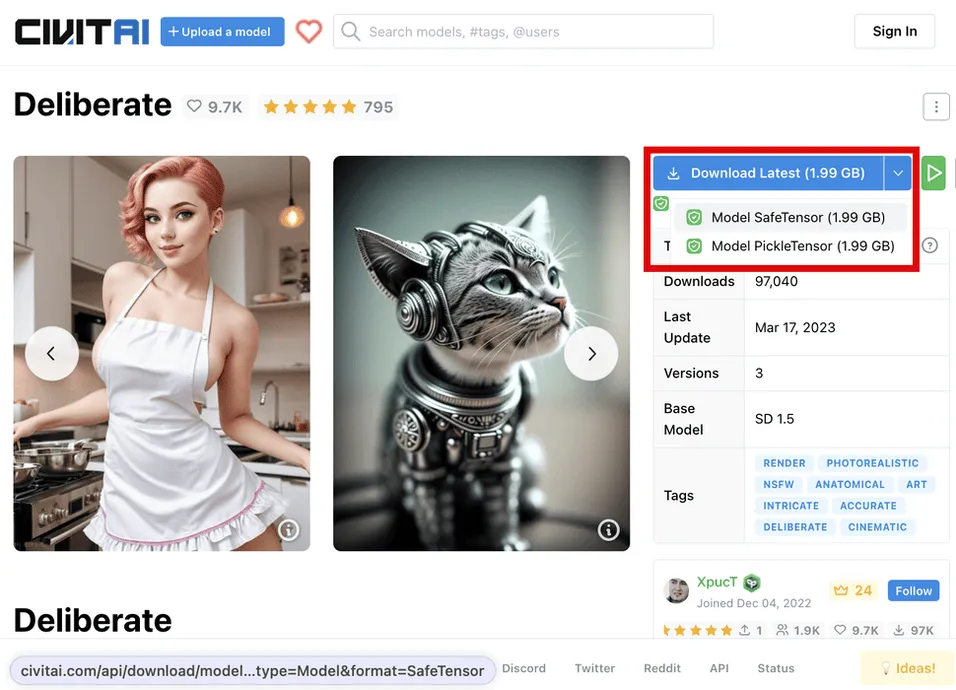

Instalar un modelo

Aún deberá agregar al menos un modelo antes de poder comenzar a usar la interfaz de usuario web.

- Ir a CIVITAI .

- Haga clic en la flecha desplegable del botón de descarga y seleccione «Modelo SafeTensor».

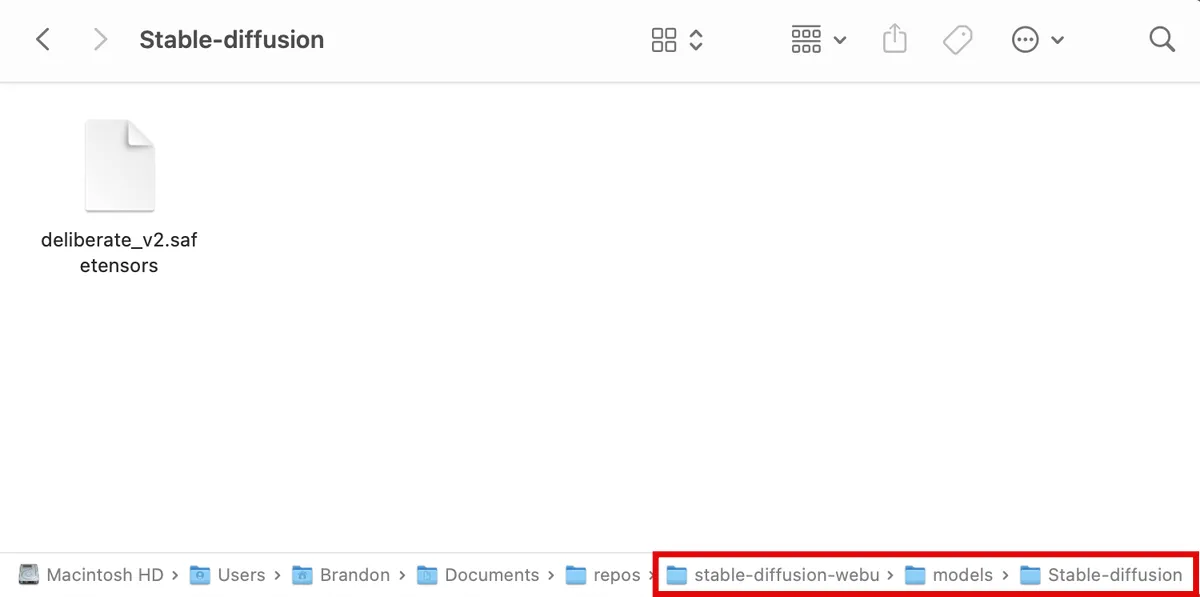

- Mueve el. archivo safetensors descargado en el paso 2 en su carpeta «stable-diffiusion-webui/models/Stable-diffusion».

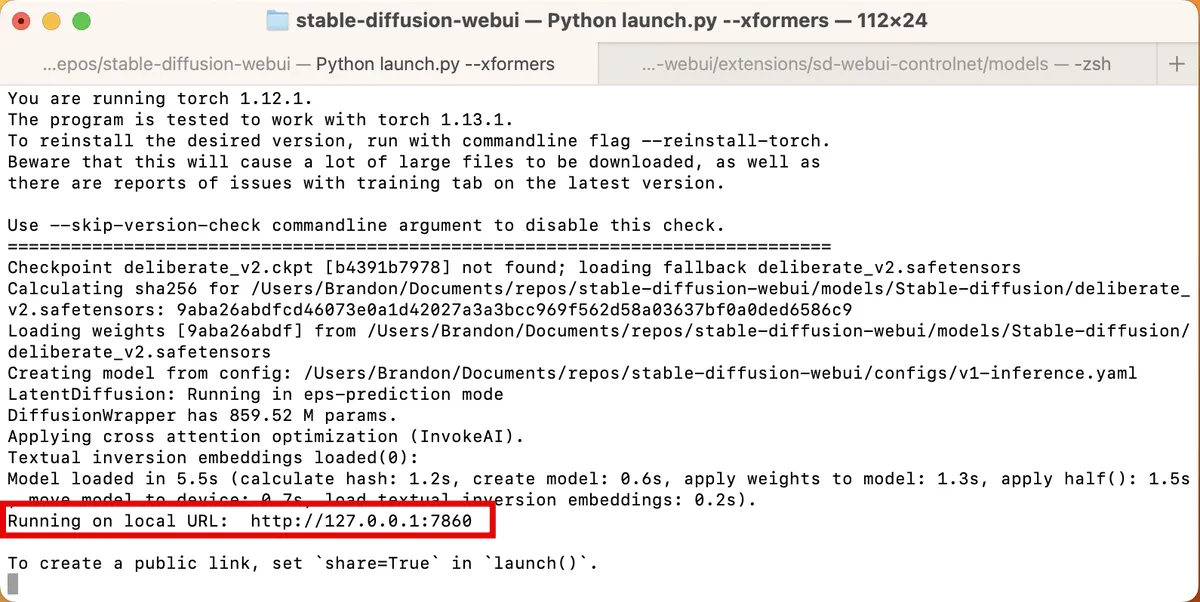

Ejecutar y configurar la interfaz de usuario web

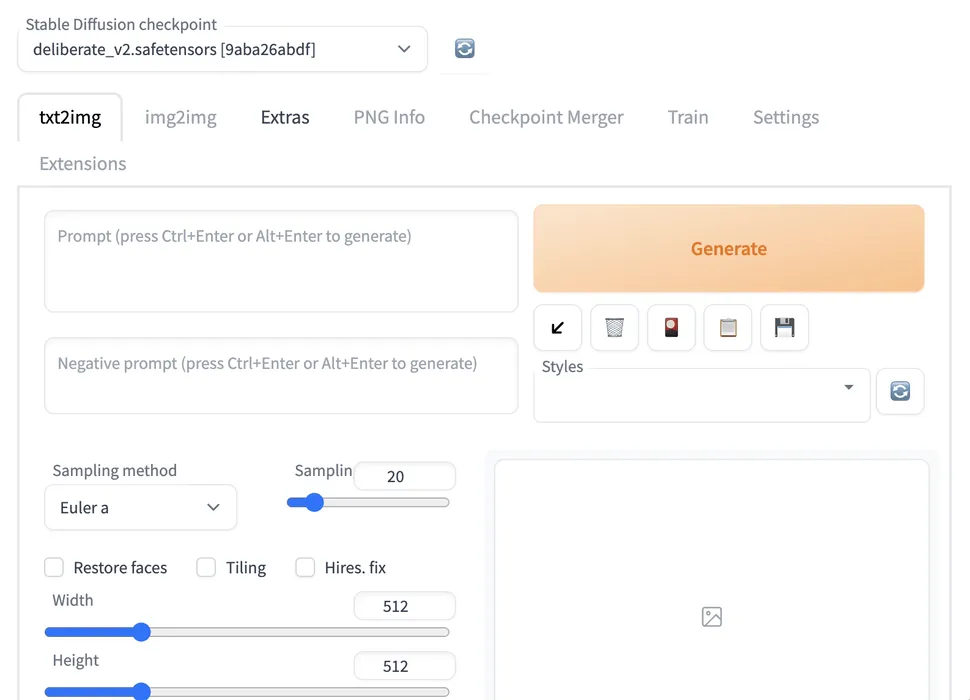

En este punto, está listo para ejecutar y comenzar a usar el programa Stable Diffusion en su navegador web.

- En su terminal, abra su directorio «stable-diffusion-webui» e ingrese el comando

./webui.sh --xformerspara Linux / macOS o./webui-user.batpara Windows. Cuando haya terminado, seleccione y copie la URL junto a «Ejecutando en URL local», que debería verse como http://127.0.0.1:7860.

- Pegue el enlace en la barra de direcciones de su navegador y presione Enter. Aparecerá el sitio web de la interfaz de usuario web.

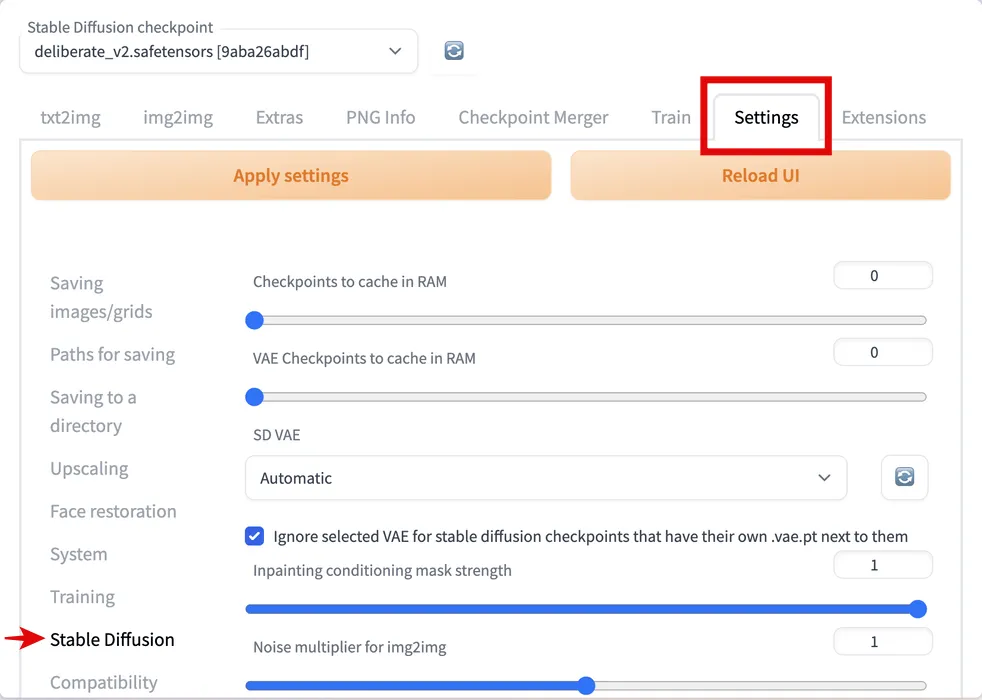

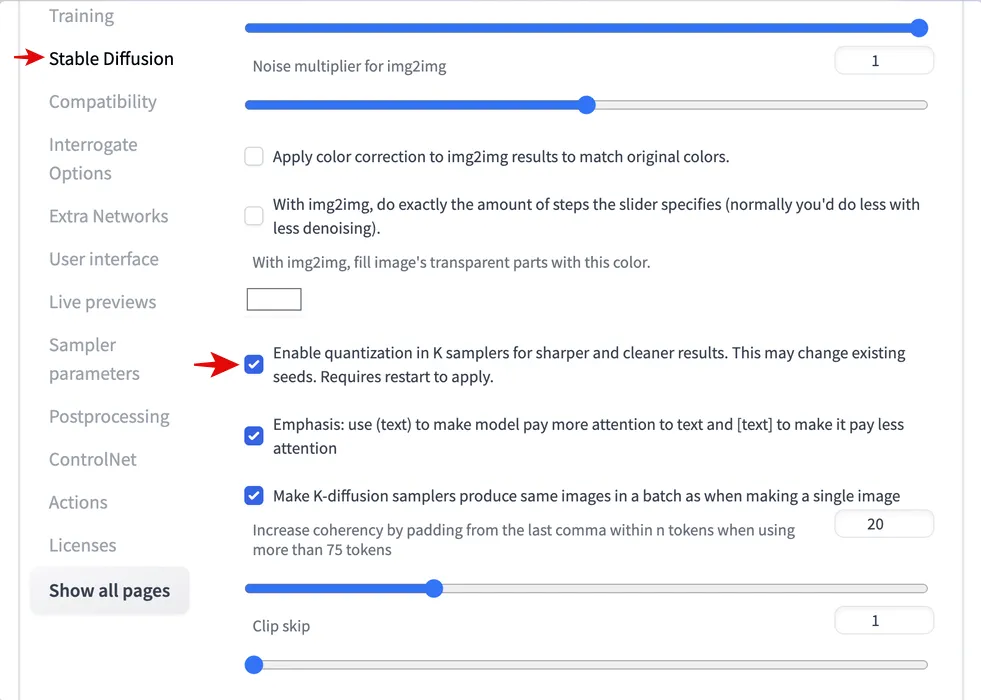

- Vamos a cambiar algunas configuraciones para obtener mejores resultados. Vaya a «Configuración -> Difusión estable».

- Desplácese hacia abajo y marque «Habilitar la cuantificación en muestras K para obtener resultados más nítidos y limpios».

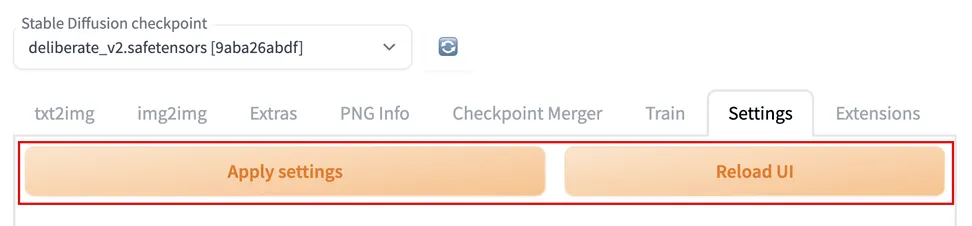

- Desplácese hacia arriba y haga clic en «Aplicar configuración», luego «Recargar IU».

FYI: si necesita encontrar una fuente de imagen, use Google.

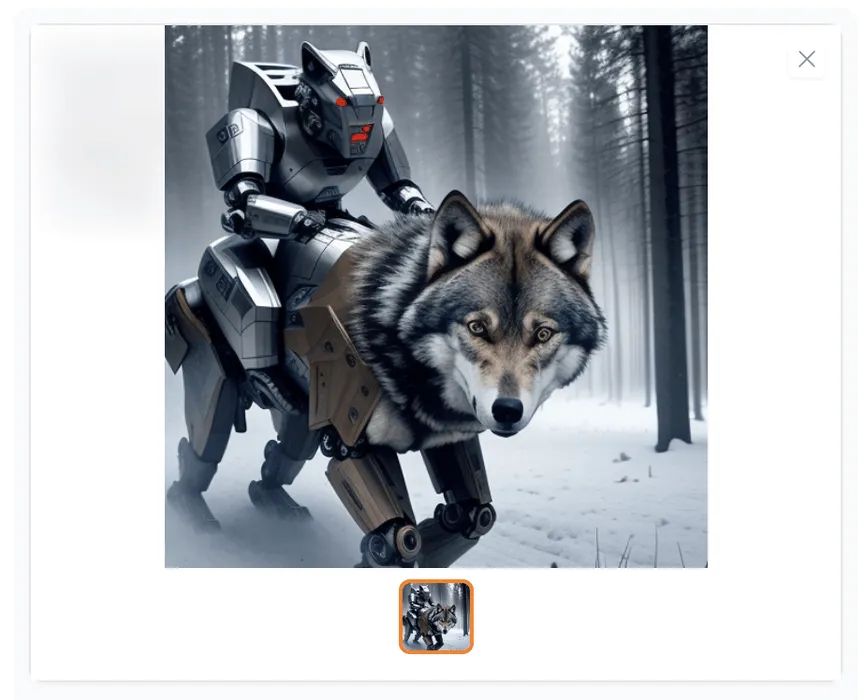

Use txt2txt para generar imágenes conceptuales

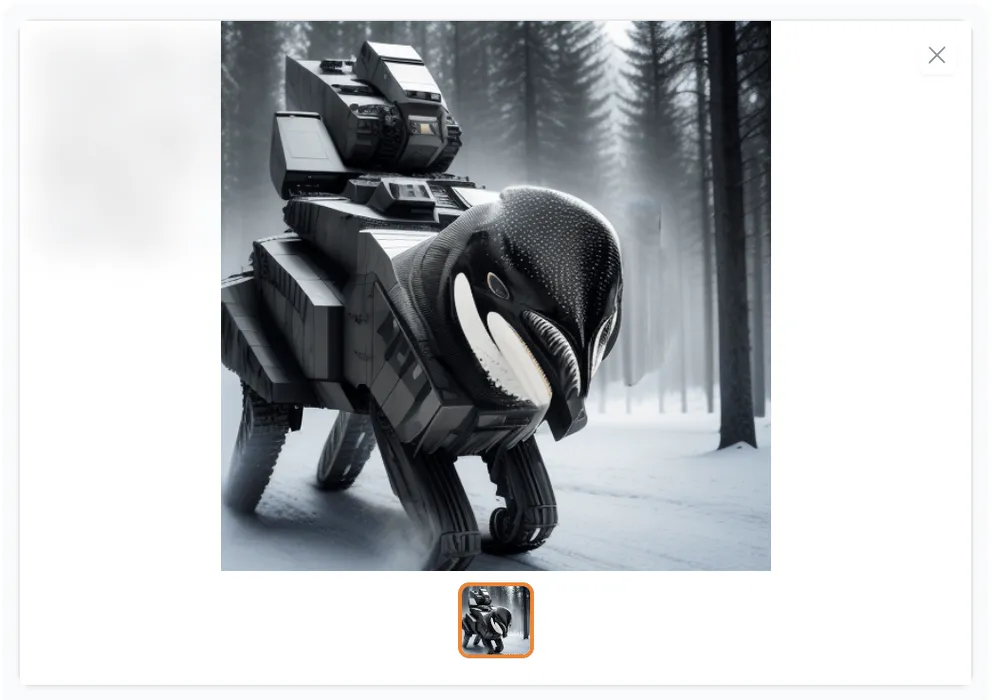

Ahora viene la parte divertida: crear algunas imágenes iniciales y buscar la que más se asemeje al aspecto que deseas.

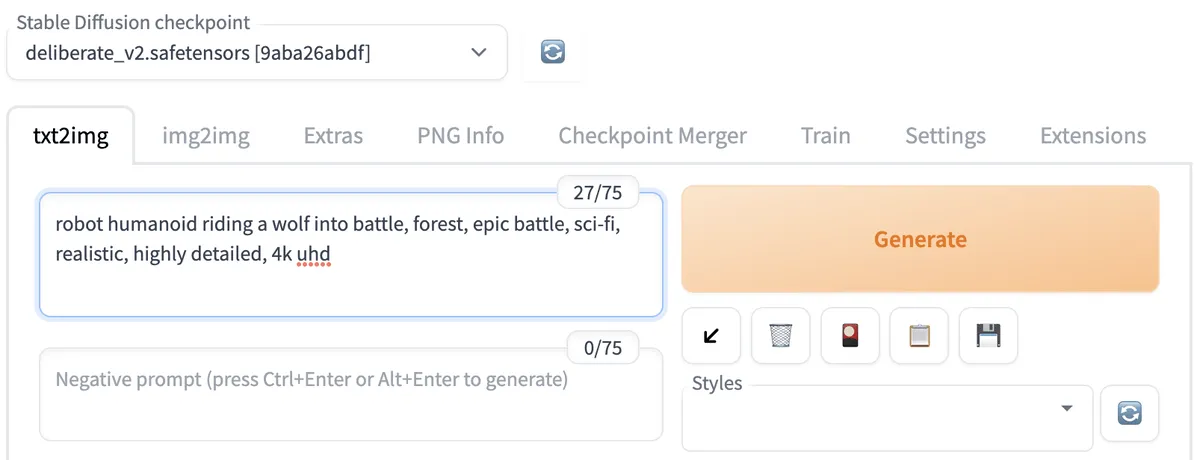

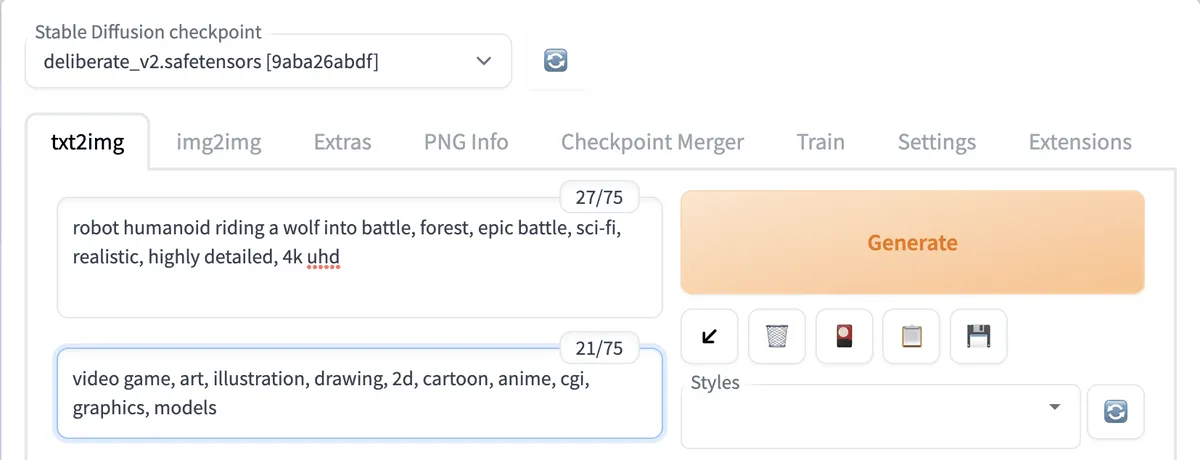

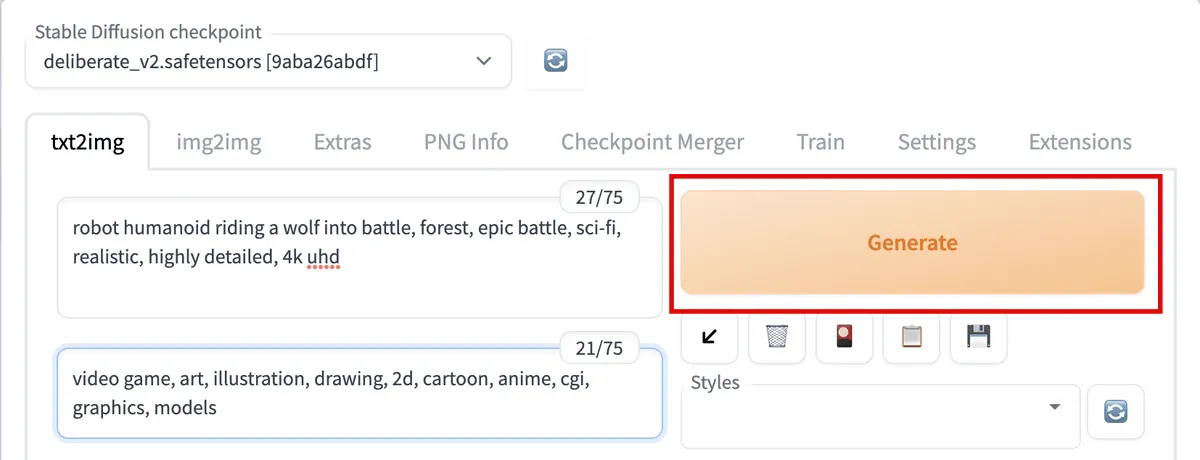

- Vaya a la pestaña «txt2img».

- En el primer cuadro de texto de solicitud, escriba palabras que describan su imagen separadas por comas. Es útil incluir palabras que describan el estilo de la imagen, como «realista», «detallado» o «retrato de primer plano».

- En el cuadro de texto de mensaje negativo a continuación, escriba las palabras clave a las que no desea que se vea su imagen. Por ejemplo, si intenta crear imágenes realistas, agregue palabras como «videojuego», «arte» e «ilustración».

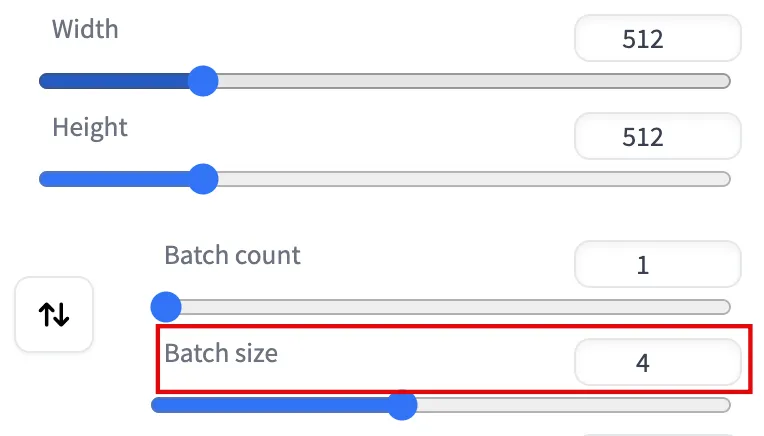

- Desplácese hacia abajo y establezca «Tamaño del lote» en «4». Esto hará que Stable Diffusion produzca cuatro imágenes diferentes a partir de su aviso.

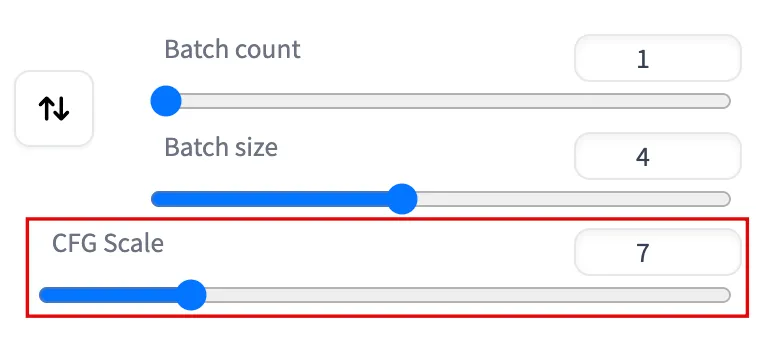

- Haga que la «Escala CFG» tenga un valor más alto si desea que Stable Diffusion siga sus palabras clave de manera más estricta o un valor más bajo si desea que sea más creativo. Un valor bajo (como el valor predeterminado de 7) generalmente produce imágenes creativas y de buena calidad.

- Deje las otras configuraciones en sus valores predeterminados por ahora. Haga clic en el botón grande «Generar» en la parte superior para que Stable Diffusion comience a funcionar.

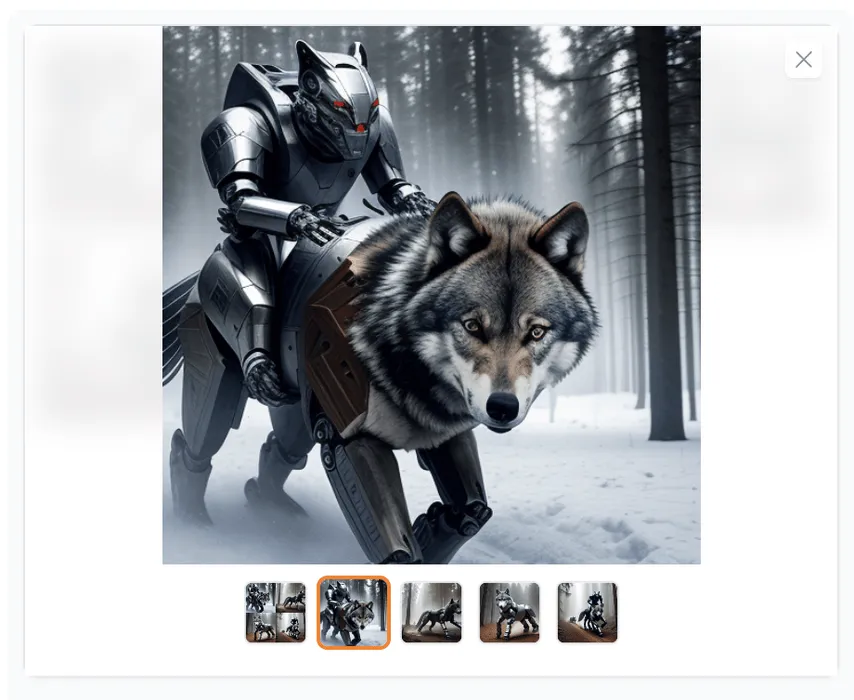

- Debajo del botón «Generar», haga clic en las miniaturas de las imágenes para obtener una vista previa y determinar si le gusta alguna de ellas.

Si no le gusta ninguna de las imágenes, repita los pasos del 1 al 5 con ligeras variaciones.

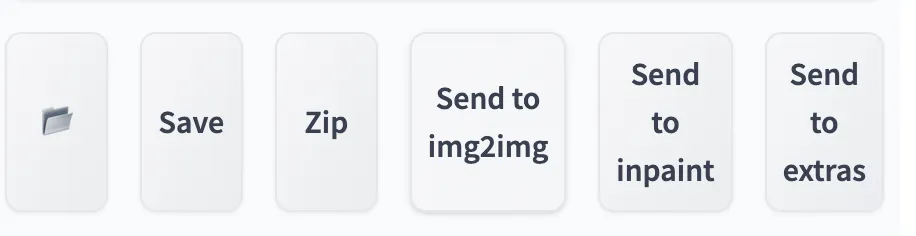

Si le gusta una imagen en general pero desea modificarla o solucionar problemas (una cara distorsionada, problemas anatómicos, etc.), haga clic en «Enviar a img2img» o «Enviar a inpaint». Esto copiará su imagen y le indicará las pestañas respectivas donde puede mejorar la imagen.

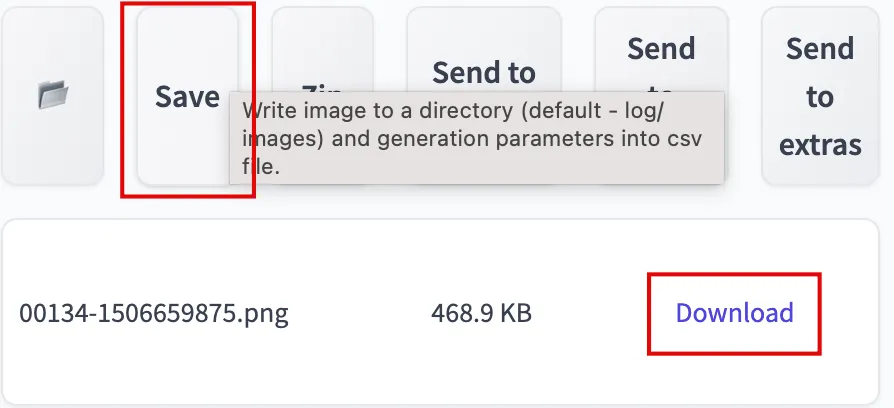

Si una imagen es excepcionalmente interesante o buena, haga clic en el botón «Guardar» seguido del botón «Descargar».

Búsqueda de indicaciones utilizadas para imágenes anteriores

Una vez que haya generado algunas imágenes, es útil obtener las indicaciones y configuraciones utilizadas para crear una imagen después del hecho.

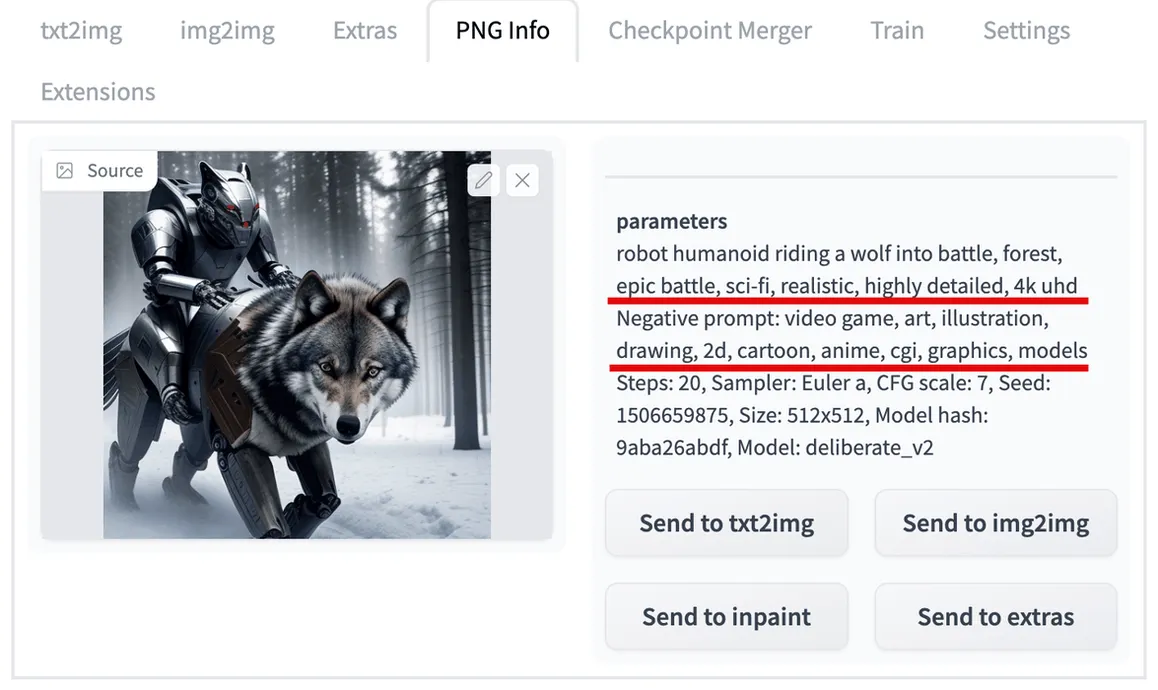

- Haga clic en la pestaña «Información PNG».

- Cargue una imagen en el cuadro. Todas las indicaciones y otros detalles de su imagen aparecerán a la derecha.

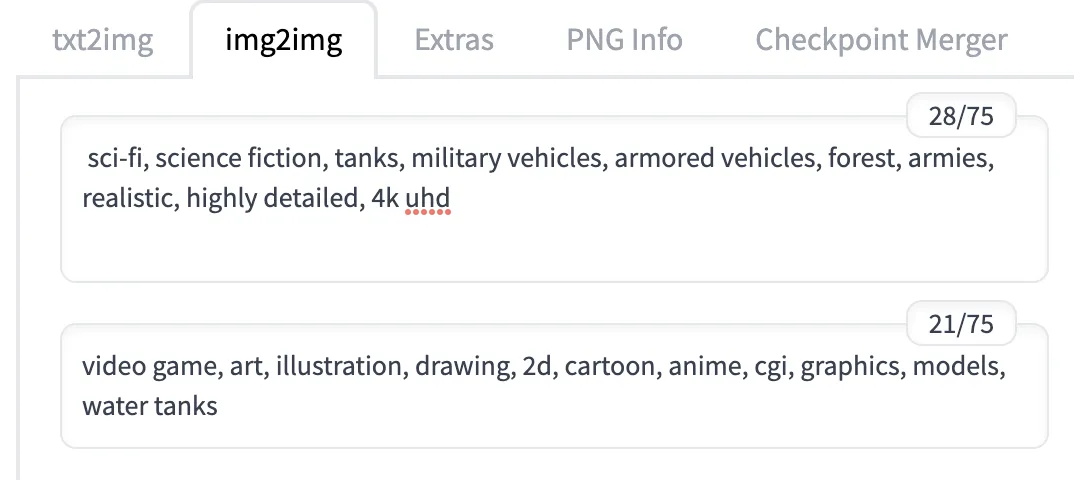

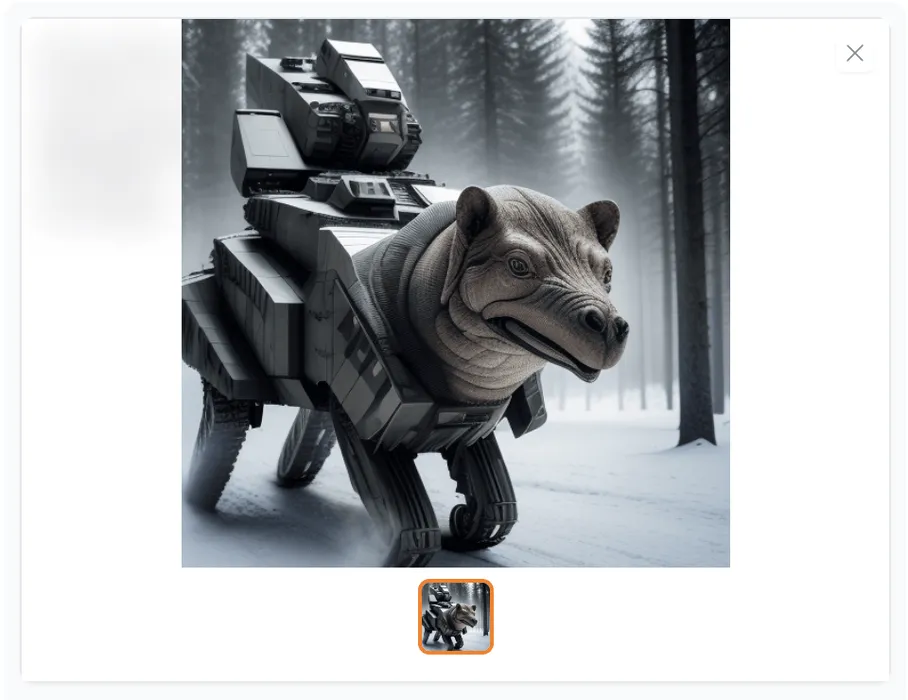

Usa img2img para generar imágenes similares

Puede usar la función img2img para generar nuevas imágenes que imiten el aspecto general de cualquier imagen base.

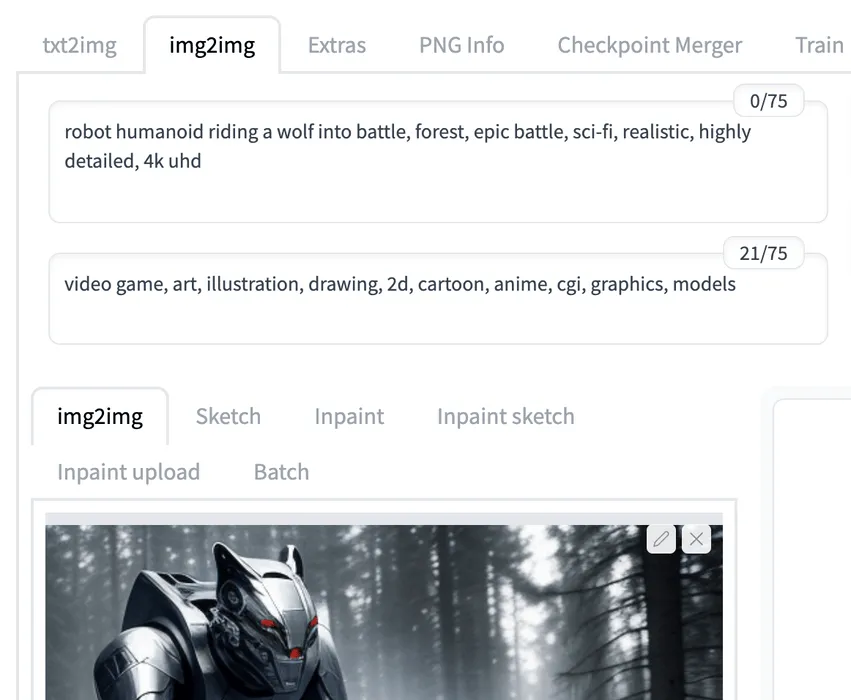

- En la pestaña «img2img», asegúrese de estar usando una imagen generada previamente con las mismas indicaciones.

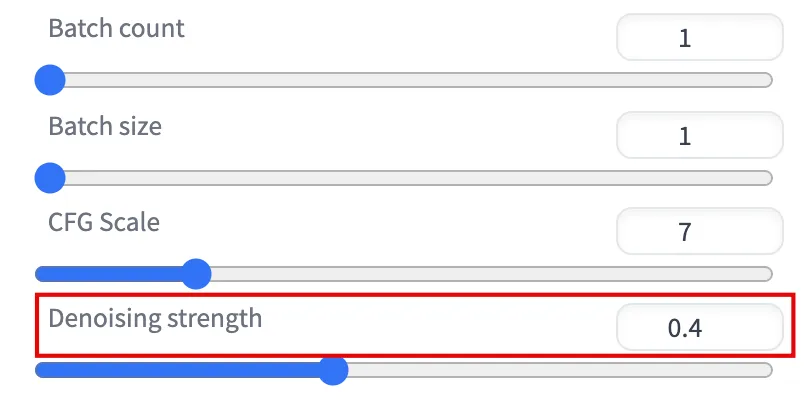

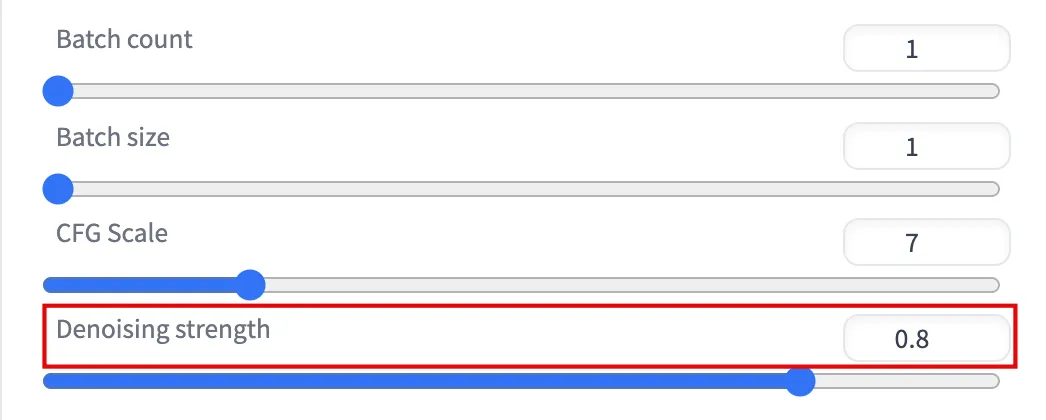

- Establezca el valor de «Fuerza de eliminación de ruido» más alto o más bajo para regenerar más o menos de su imagen (0.50 regenera el 50% y 1 regenera el 100%).

- Haga clic en «Generar» y revise las diferencias. Si no está satisfecho, repita los pasos 1 a 3 después de ajustar la configuración.

- Alternativamente, haga clic en «Enviar a img2img» para seguir haciendo modificaciones basadas en la nueva imagen.

- Vuelva a escribir las indicaciones para agregar elementos completamente nuevos a la imagen y ajuste otras configuraciones según lo desee.

- Haga clic en «Generar» y revise el resultado.

Use inpaint para cambiar parte de una imagen

La función inpaint es una poderosa herramienta que le permite realizar correcciones puntuales precisas en una imagen base utilizando el mouse para «pintar» sobre partes de una imagen que desea regenerar. Las partes que no has pintado no se modifican.

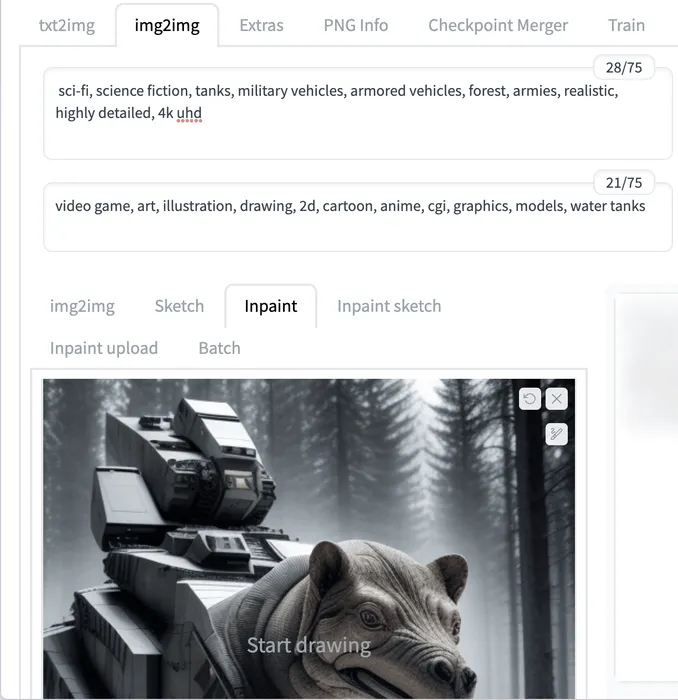

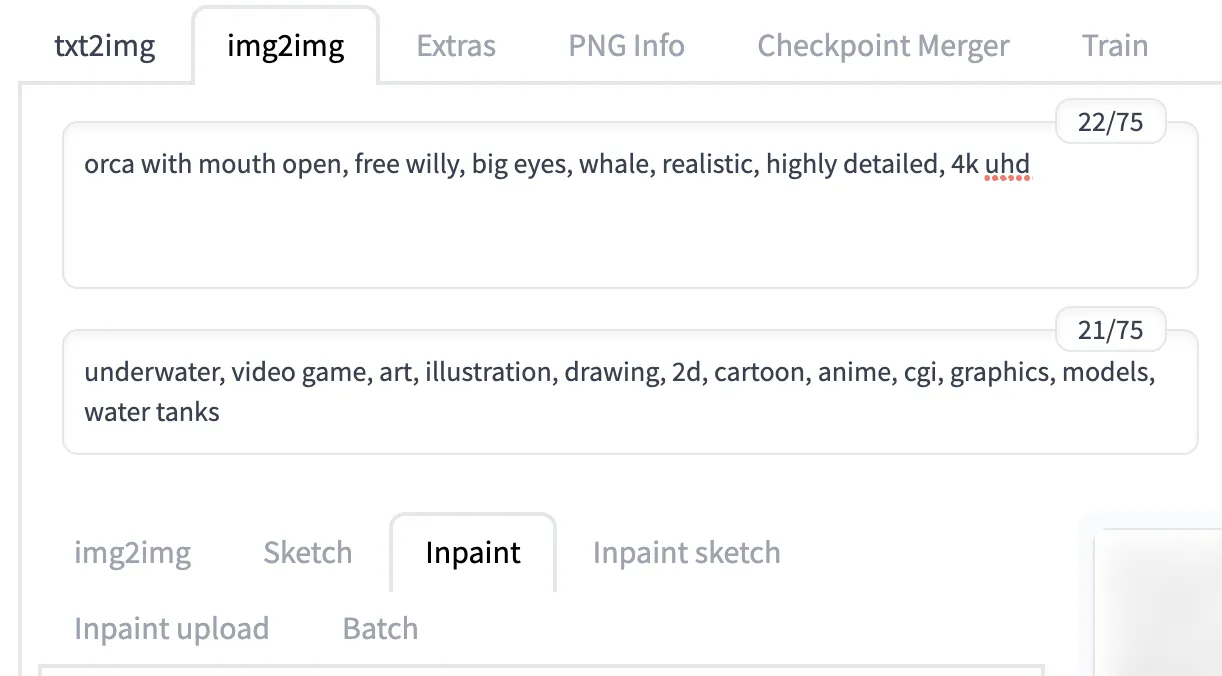

- En la pestaña «img2img -> pestaña Inpaint», asegúrese de estar utilizando una imagen generada previamente.

- Cambie sus indicaciones si desea nuevos elementos visuales.

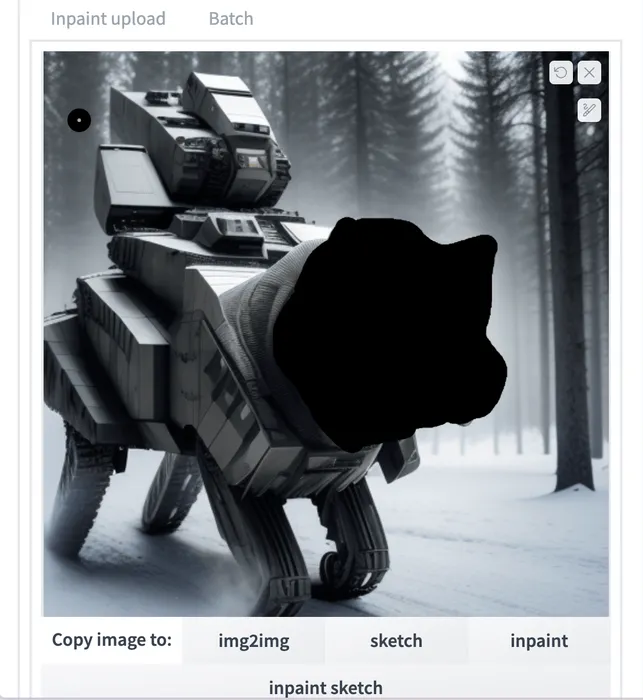

- Use su mouse para pintar sobre la parte de la imagen que desea cambiar.

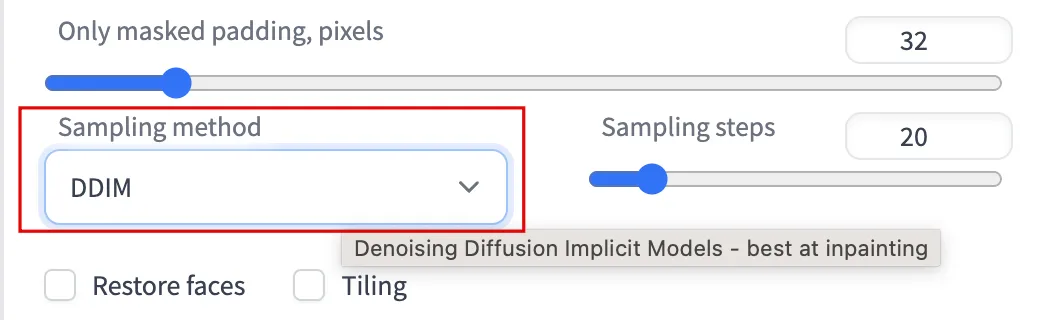

- Cambie el «Método de muestreo» a DDIM, que se recomienda para pintar.

- Establezca la «Fuerza de eliminación de ruido», eligiendo un valor más alto si está realizando cambios extremos.

- Haga clic en «Generar» y revise el resultado.

Es probable que Stable Diffusion no arregle todo en el primer intento, por lo que puede hacer clic en «Enviar a inpaint» y repetir los pasos anteriores tantas veces como desee.

Mejore su imagen

Ha estado creando imágenes relativamente pequeñas de 512 x 512 píxeles hasta este punto, pero si aumenta la resolución de su imagen, también aumenta el nivel de detalle visual.

Instale la extensión Ultimate SD Upscale

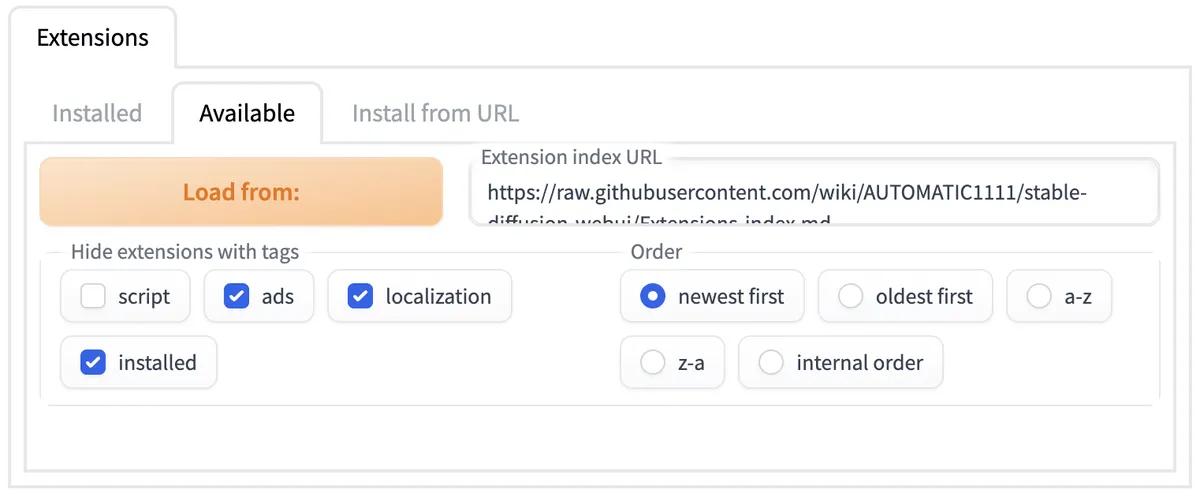

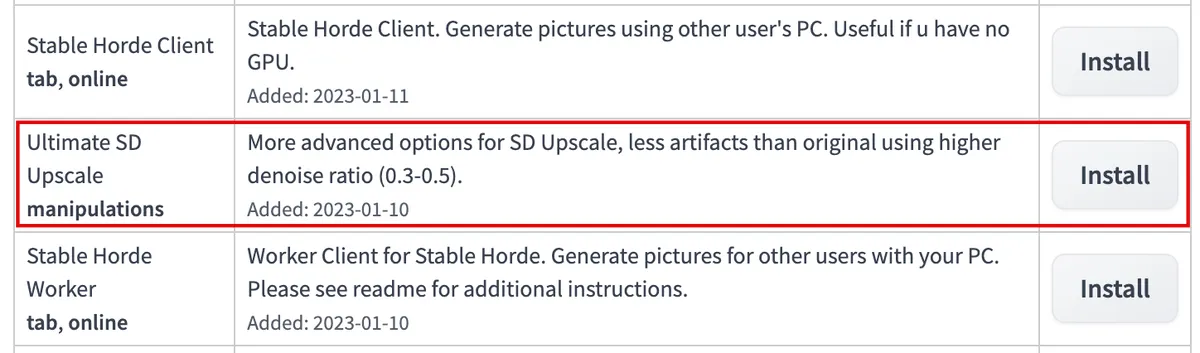

- Haga clic en «Extensiones -> Disponible -> Cargar desde».

- Desplácese hacia abajo para encontrar «Ultimate SD Upscale manipulaciones» y haga clic en «Instalar».

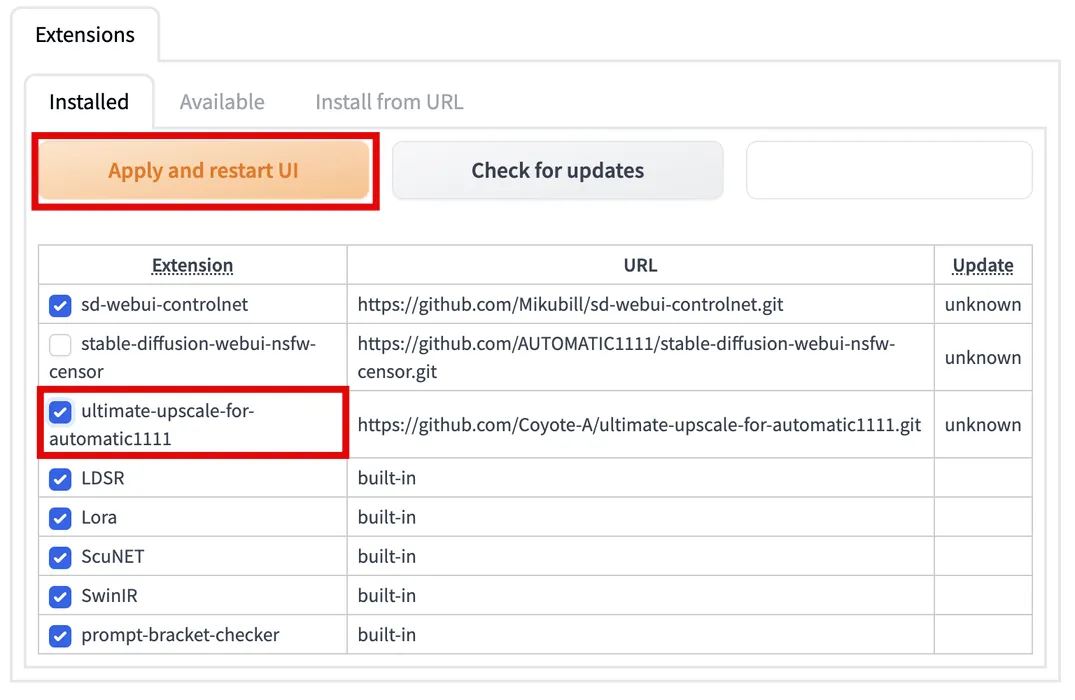

- Desplácese hacia arriba y haga clic en la pestaña «Instalado». Marque «ultimate-upscale-for-automatic1111», luego haga clic en «Aplicar y reiniciar la interfaz de usuario».

Cambiar el tamaño de su imagen

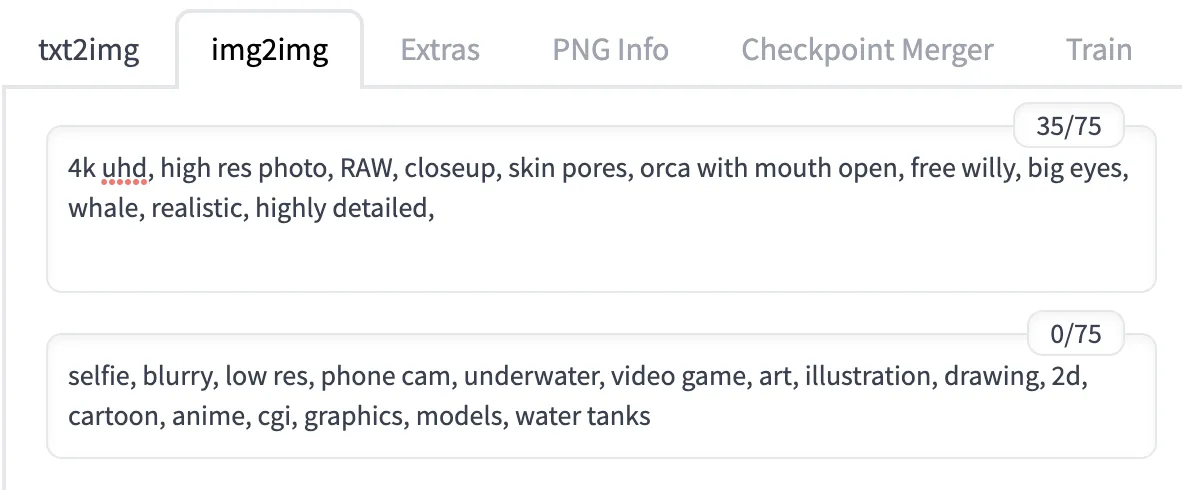

- En la pestaña «img2img», asegúrese de estar usando una imagen generada previamente con las mismas indicaciones. En la parte delantera de su solicitud de entrada, agregue frases como «4k», «UHD», «foto de alta resolución», «RAW», «primer plano», «poros de la piel» y «ojos detallados» para perfeccionarlo más. En la parte delantera de su entrada de solicitud negativa, agregue frases como «selfie», «borrosa», «baja resolución» y «cámara de teléfono» para alejarse de ellas.

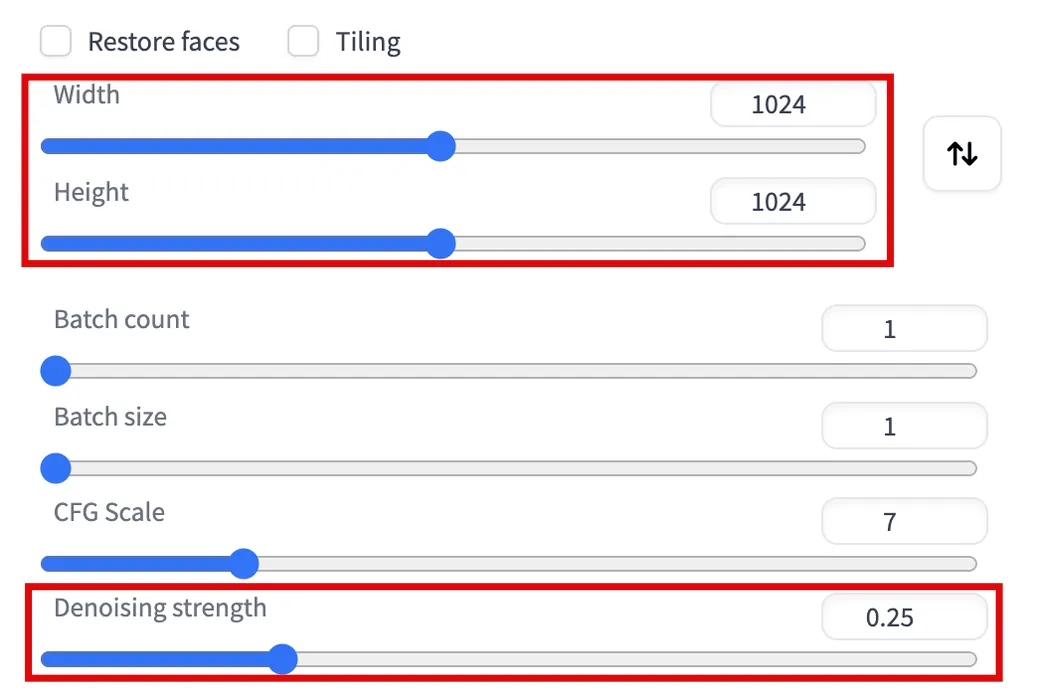

- Establezca su «Fuerza de eliminación de ruido» en un valor bajo (alrededor de 0,25) y duplique los valores de «Ancho» y «Altura».

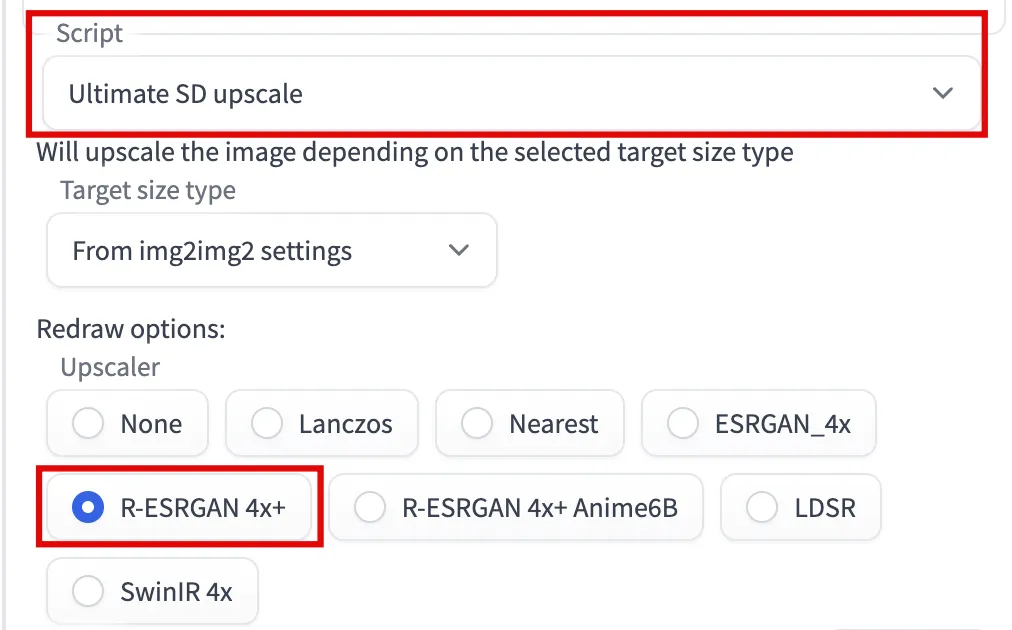

- En el menú desplegable «Script», seleccione «Ultimate SD upscale», luego en «Upscaler», marque la opción «R-ESRGAN 4x+».

- Haga clic en «Generar» y revise el resultado. Debería notar cambios menores y detalles más nítidos.

Puede aumentar aún más la resolución haciendo clic en «Enviar a img2img» y repitiendo los pasos mientras aumenta aún más los valores de «Ancho» y «Altura» y ajustando la «Fuerza de eliminación de ruido».

Preguntas frecuentes

¿Cuál es la diferencia entre Difusión estable, DALL-E y Midjourney?

Los tres son programas de inteligencia artificial que pueden crear casi cualquier imagen a partir de un mensaje de texto. La mayor diferencia es que solo Stable Diffusion es completamente gratuito y de código abierto. Puede ejecutarlo en su computadora sin pagar nada, y cualquiera puede aprender y mejorar el código de difusión estable. Sin embargo, el hecho de que necesite instalarlo usted mismo hace que sea más difícil de usar.

DALL-E y Midjourney son ambos de fuente cerrada. Se puede acceder a DALL-E principalmente a través de su sitio web y ofrece un número limitado de generaciones de imágenes por mes antes de pedirle que pague. Se puede acceder a Midjourney principalmente a través de comandos en su servidor Discord y tiene diferentes niveles de suscripción.

¿Qué es un modelo en Difusión Estable?

Un modelo es un archivo que representa un algoritmo de IA entrenado en imágenes y palabras clave específicas. Diferentes modelos son mejores para crear diferentes tipos de imágenes: puede tener un modelo bueno para crear personas realistas, otro que sea bueno para crear personajes de dibujos animados en 2D y otro que sea mejor para crear pinturas de paisajes.

El modelo Deliberate que instalamos en esta guía es un modelo popular que es bueno para la mayoría de las imágenes, pero puede ver todo tipo de modelos en sitios web como Civitai o Hugging Face . Siempre y cuando descargues un. safetensors, puede importarlo a la interfaz de usuario web de AUTOMATIC1111 siguiendo las mismas instrucciones de esta guía.

¿Cuál es la diferencia entre SafeTensor y PickleTensor?

En resumen, use siempre SafeTensor para proteger su computadora de las amenazas de seguridad.

Si bien SafeTensor y PickleTensor son formatos de archivo que se utilizan para almacenar modelos para Stable Diffusion, PickleTensor es el formato más antiguo y menos seguro. Un modelo PickleTensor puede ejecutar código arbitrario (incluido malware) en su sistema.

¿Debo usar la configuración de tamaño de lote o recuento de lotes?

Puedes usar ambos. Un lote es un grupo de imágenes que se generan en paralelo. La configuración del tamaño del lote controla cuántas imágenes hay en un solo lote. La configuración de conteo de lotes controla cuántos lotes se ejecutan en una sola generación; cada lote se ejecuta secuencialmente.

Si tiene un recuento de lotes de 2 y un tamaño de lote de 4, generará dos lotes y un total de ocho imágenes.

Si prefiere dibujar cosas usted mismo, consulte nuestra lista de aplicaciones de dibujo para Windows.

Crédito de la imagen: Pixabay . Todas las capturas de pantalla por Brandon Li.

- Pío

Deja una respuesta