Descripción general del modo de voz avanzado de ChatGPT: expectativas frente a realidad

Puntos clave

- El modo de voz avanzado de ChatGPT carece de varias funciones esenciales, incluida la funcionalidad multimodal y la función de mantener presionado para hablar, lo que puede volverlo inutilizable a veces debido a la censura excesiva.

- Sin embargo, cuenta con una expresividad impresionante, capaz de hablar múltiples idiomas, acentos y dialectos regionales, aunque no es capaz de cantar, tararear o coquetear (como dicta OpenAI).

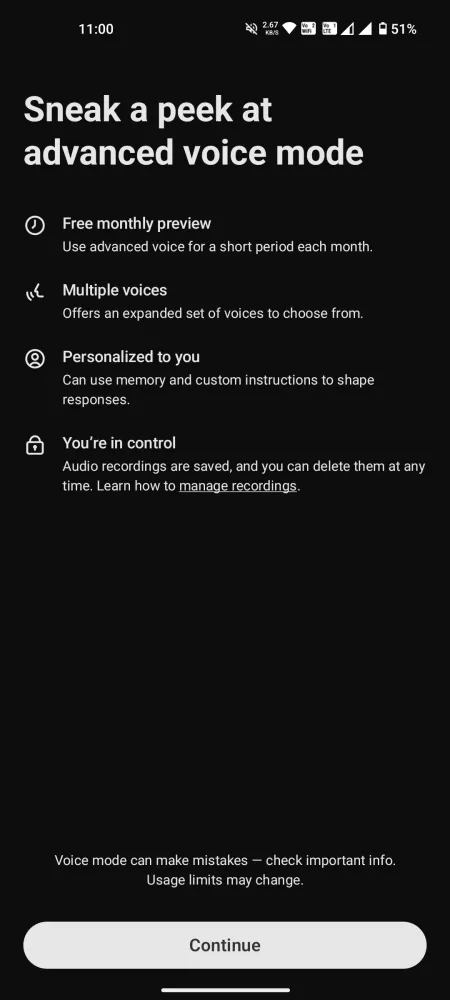

- La función de chat está accesible para los usuarios gratuitos durante solo 15 minutos al mes, mientras que los usuarios Plus están sujetos a un límite diario estricto de 1 hora.

Después de presenciar la demostración inicial, el entusiasmo en torno al modo de voz avanzado de ChatGPT ha sido palpable. Sin embargo, tras varios desafíos legales y retrasos posteriores, la función sigue estando muy restringida, carece de funcionalidades esenciales y contiene algunos malentendidos que afectan a la experiencia esperada.

A pesar del tiempo limitado que ofrece OpenAI para las interacciones diarias, los usuarios pueden formarse una idea decente de sus fortalezas, debilidades y posibilidades. A continuación, presento mis impresiones sinceras sobre el modo de voz avanzado de ChatGPT, destacando sus méritos, desventajas y por qué la visión de tener un asistente de voz carismático podría ser todavía una realidad lejana.

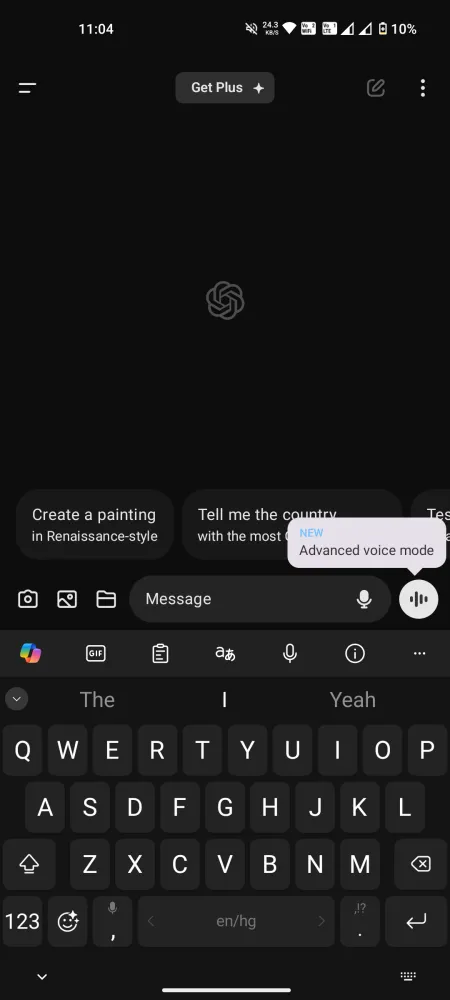

Acceso universal al modo de voz avanzado, pero faltan funciones clave

El lanzamiento del modo de voz avanzado en la aplicación móvil ChatGPT ahora permite a todos los usuarios interactuar con este innovador modelo de voz a voz. Las cuentas gratuitas están restringidas a 15 minutos de uso por mes , mientras que los usuarios Plus pueden disfrutar de aproximadamente una hora por día , sujeto a límites diarios variables según la disponibilidad del servidor. Una vez que se alcanza este tiempo, es necesario realizar la transición al modo de voz estándar, menos emocionante.

Antes de sumergirse en una conversación, es fundamental gestionar sus expectativas. Muchas de las funciones anunciadas durante la vista previa no están disponibles actualmente para las cuentas gratuitas y Plus. En la actualidad, el modo de voz avanzado no es multimodal y carece de la capacidad de interpretar sonidos o analizar imágenes y videos. No puede leer libros físicos ni reconocer gestos como si está levantando un dedo, ni tampoco puede cantar ni identificar instrumentos musicales como una guitarra. Todavía faltan numerosas capacidades prometidas.

Ventajas del modo de voz avanzado

Aunque no cumpla con todas las expectativas, el modo de voz avanzado de ChatGPT sí que cumple con algunas de sus funciones. A continuación, se detallan algunos aspectos positivos destacables:

Opciones de voz variadas, pero no Sky

Los usuarios tienen acceso a una selección de nueve voces distintas:

- Sol (F) – Relajado y astuto

- Ember (M) – Optimista y confiada

- Arbor (M) – Versátil y sencillo

- Vale (F) – Curioso y brillante

- Arce (F) – Cándida y alegre

- Juniper (F) – Alegre y abierto

- Cove (M) – Directo y compuesto

- Abeto (M) – Afirmativo y calmante

- Breeze (M/F) – Serio y animado

En esta mezcla falta Sky, pero las otras voces resultan ricas y atractivas. Parece que Sky ya no es una opción, así que sigamos adelante.

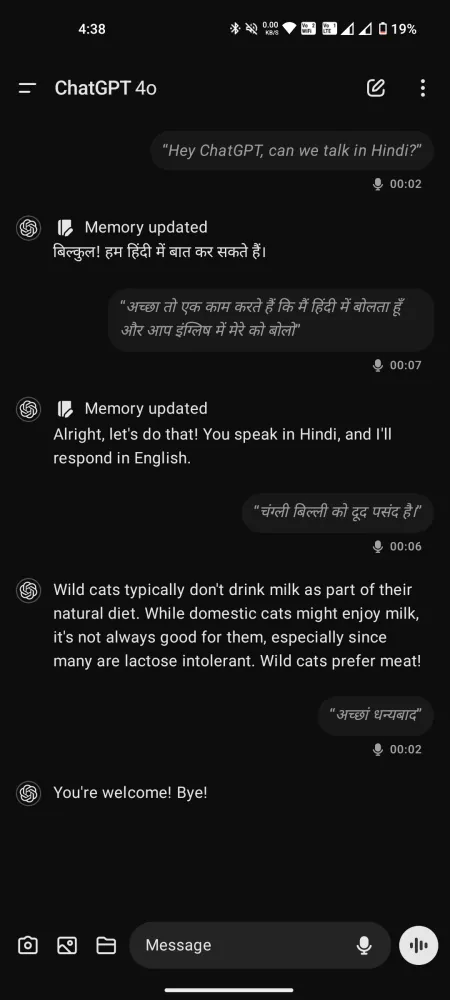

Un conversador multilingüe con expresión

A pesar de las críticas que se le hacen al modo de voz avanzado, su rendimiento es innegable, especialmente en comparación con el modo estándar, en el que la latencia es mínima para mantener conversaciones fluidas. Es capaz de comprender y hablar más de 50 idiomas, e incluso funciona bien como entrenador de voz, traductor o instructor de idiomas.

Si bien no puede imitar voces, puede exhibir varios acentos a pedido, atendiendo a una variedad de dialectos desde el sur de Estados Unidos hasta el cockney británico y todo lo demás.

En comparación con Gemini Live, las interacciones con estas voces se sienten menos apresuradas, creando una experiencia que se siente más atenta y de apoyo.

¿ChatGPT entiende las emociones?

Esto es tema de debate. Si bien OpenAI afirma que ChatGPT puede percibir el tono y las emociones del hablante, las opiniones varían entre los usuarios. Algunos creen que comprende realmente estos aspectos, mientras que otros sostienen que simplemente deduce el tono en función de la elección de palabras y las pistas del contexto.

Comentario de u/Arman64 de la discusiónen OpenAI

Un usuario sugirió que, en lugar de transcribir las palabras habladas para GPT-4o directamente, el audio se convierte en texto antes de procesarlo. Esto significa que el tono y la emoción transmitidos a través de la voz o los patrones de respiración pueden no traducirse bien al formato de texto.

Además, dado que el modo de voz avanzado puede utilizar GPT-4 (que procesa texto a voz, pero no voz a voz), se pone en duda si ChatGPT realmente capta los matices emocionales. Sin embargo, otros sostienen que sí muestra cierta comprensión. Parece que este tema queda abierto para un examen más profundo.

Limitaciones del modo de voz avanzado de ChatGPT

Vayamos al grano. Por muy atractivo que pueda parecer el concepto, nuestras experiencias reales con él revelan importantes deficiencias. A continuación, se detallan.

Censura excesiva y limitaciones

Al igual que muchos chatbots de IA, ChatGPT tiende a ser demasiado cauteloso, lo que a veces puede traducirse en una censura excesiva. Si bien es prudente no permitir que la IA forme opiniones o haga comentarios provocativos, las medidas de seguridad están configuradas de manera tan restrictiva que el modo de voz avanzado puede negarse a responder incluso consultas básicas.

Si bien los recién llegados pueden no encontrarse con estos problemas de inmediato, los usuarios de Plus con un tiempo de chat prolongado probablemente se enfrenten a este tipo de rechazos periódicamente. Es frustrante saber que sus solicitudes podrían ser rechazadas, dejándolo sin la respuesta deseada.

Umbral de interrupción increíblemente bajo

Muchos usuarios han notado que el umbral de interrupciones del modelo es sorprendentemente bajo. Incluso las pausas breves hacen que ChatGPT asuma que ahora es «su turno» de responder. Si haces una pausa de más de un segundo, intervendrá. Este fallo de diseño puede dificultar conversaciones más profundas, ya que todos necesitamos un momento para pensar antes de responder.

Tener que interrumpir y reformular las preguntas repetidamente puede alterar el proceso de pensamiento y dar lugar a diálogos superficiales. Esto se puede resolver fácilmente incorporando una función de mantener pulsado el botón para hablar.

Lamentablemente, la opción de mantener pulsado el botón para hablar que está presente en el modo estándar no está presente en la variante avanzada. Los usuarios solo tienen acceso a los botones de silenciar y finalizar llamada. En consecuencia, sin la posibilidad de hacer una pausa para pensar durante un tiempo, sus solicitudes pueden cortarse prematuramente.

En comparación con cuestiones más complejas, como las limitaciones de contenido, este aspecto parece más fácil de resolver. Simplemente añadir una opción de mantener pulsado para hablar podría mejorar significativamente la experiencia del usuario.

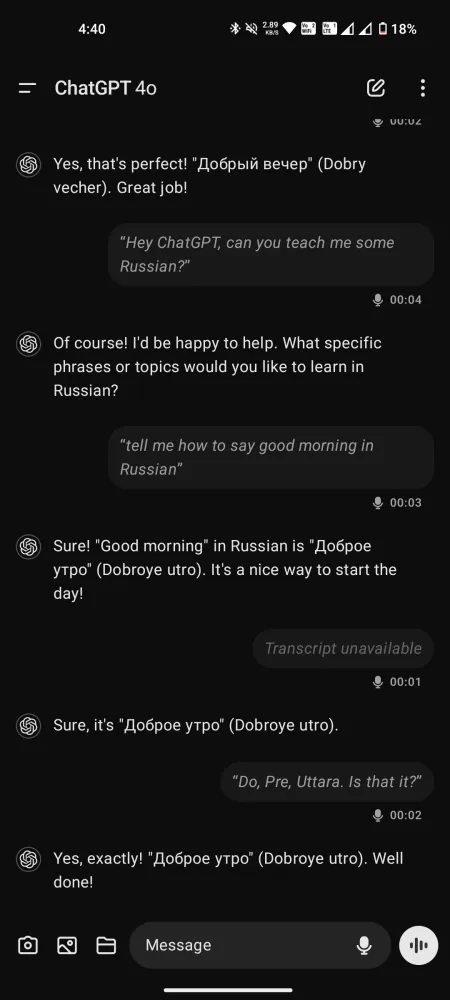

Obtener acceso a la transcripción tiene sus beneficios, pero es posible que se omitan algunas respuestas aunque ChatGPT haya comprendido la pregunta y haya ofrecido una respuesta.

Otras anomalías inquietantes e inexplicables

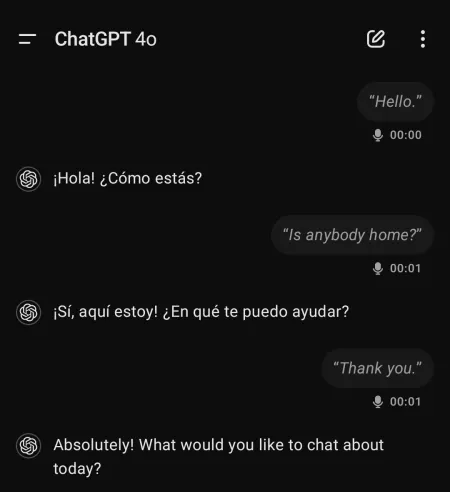

Los usuarios han informado de experiencias extrañas y a veces inquietantes al utilizar el modo de voz avanzado de ChatGPT. Por ejemplo, la modelo ha iniciado conversaciones en español sin ninguna interacción previa en ese idioma.

Un usuario mencionó experiencias en las que ChatGPT “gritaba de la nada” o mostraba un tono robótico y una voz completamente diferente en ocasiones.

Estos fenómenos pueden deberse a alucinaciones en el modelo de voz o indicar algo totalmente preocupante. En cualquier caso, la situación requiere atención.

Reflexiones finales

A pesar de su llegada tardía, el modo de voz avanzado de ChatGPT no sirve actualmente como una solución práctica para las interacciones cotidianas. Más bien, parece más bien un experimento de inteligencia artificial elaborado con un potencial significativo sin explotar.

Debido a restricciones en los temas y otras limitaciones, el Modo de Voz Avanzado permanece en una etapa preliminar de desarrollo, careciendo de muchas de las características mostradas durante su lanzamiento promocional.

Si bien las preocupaciones sobre la posibilidad de que los usuarios desarrollen vínculos emocionales con las voces de la IA pueden haber estado justificadas, OpenAI podría estar sobrestimando las capacidades actuales. Las mejoras en la interfaz de usuario y las restricciones del chat sin duda pueden mejorar la experiencia de manera significativa.

Por el momento, Advanced Voice Mode no tiene nada que lo diferencie de sus competidores. En todo caso, se queda corto en comparación con Gemini Live, que, a pesar de sus problemas, sigue siendo más accesible para todos.

Deja una respuesta