Mit den neuen Funktionen von Microsoft können Sie KI-Modelle ganz einfach lokal unter Windows 11 ausführen

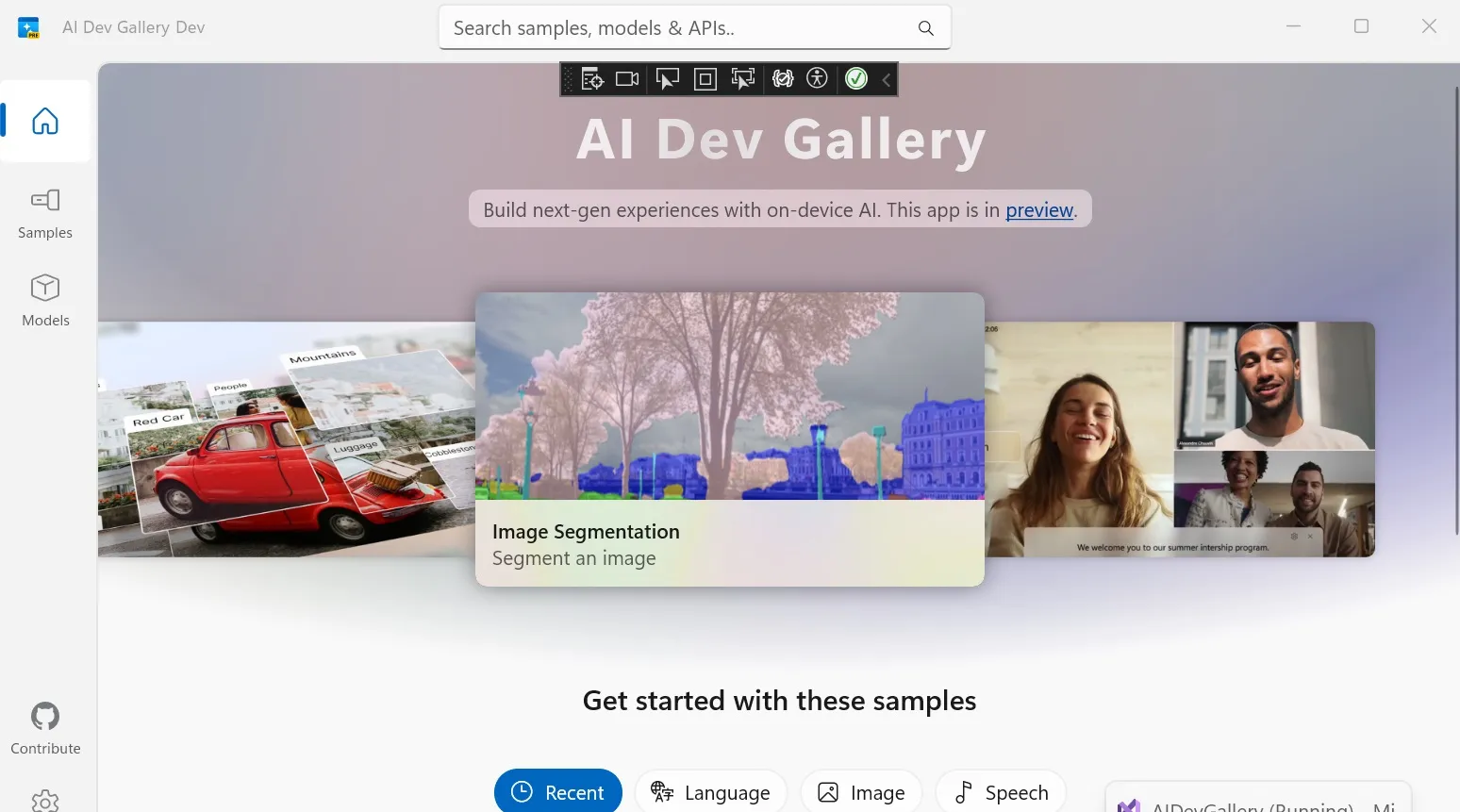

Copilot+-PCs stellen einen bahnbrechenden Fortschritt dar, da sie die ersten Computer sind, die Small Language Models (SLM) direkt auf dem Gerät ausführen können. Diese innovative Technologie bietet erhebliche Vorteile, indem sie im Vergleich zur Cloud-basierten Copilot-Anwendung schnellere Ergebnisse für verschiedene Aufgaben wie die Bild- und Textgenerierung liefert. Kürzlich hat Microsoft die AI Dev Gallery vorgestellt, die die Integration von geräteinternen KI-Funktionen in jede Anwendung vereinfacht.

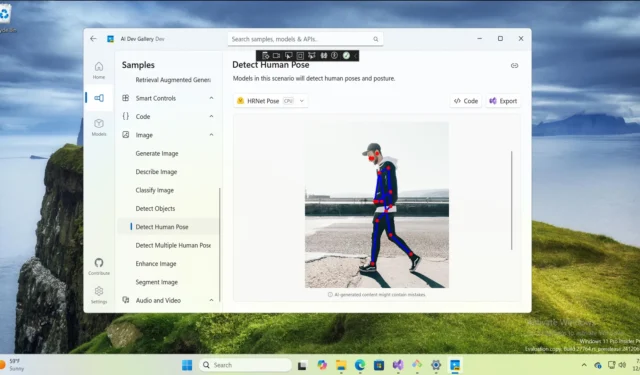

Die AI Dev Gallery wurde speziell für Entwickler entwickelt, die verschiedene Modelle testen möchten, um ihre Anwendungen mit KI-Funktionen zu verbessern. Dieses Tool bietet Zugriff auf über 25 herunterladbare Beispiele, die problemlos auf Ihrem Gerät ausgeführt werden können. Darüber hinaus können Benutzer Projekte oder Quellcode direkt in ihre Anwendungen exportieren, um sie sofort nutzen zu können. Es ist sowohl mit Windows 10 als auch mit 11 kompatibel und unterstützt x64- und ARM64-Architekturen.

In einem interessanten Experiment hat Windows Latest die AI Dev Gallery aus seinem GitHub-Repository dupliziert. Derzeit muss das Projekt vor der Ausführung über Visual Studio erstellt werden, um darauf zugreifen zu können. Darüber hinaus sind mindestens 20 GB Speicher und eine Multi-Core-CPU erforderlich. Obwohl eine GPU mit 8 GB VRAM empfohlen wird, ist sie nur für anspruchsvollere Modelle erforderlich.

Wir begannen unsere Tests mit einem Windows 11-PC, der mit einer 4-Core-CPU und 4 GB RAM ausgestattet war. Die App verfügt über zwei Betriebsmodi: Sample und Models. Wir nutzten den Sample-Modus, um die verschiedenen verfügbaren Modelle zu erkunden, die in Kategorien wie Text, Bild, Code, Audio und Video sowie Smart Controls organisiert sind.

Auswertung der Modelle

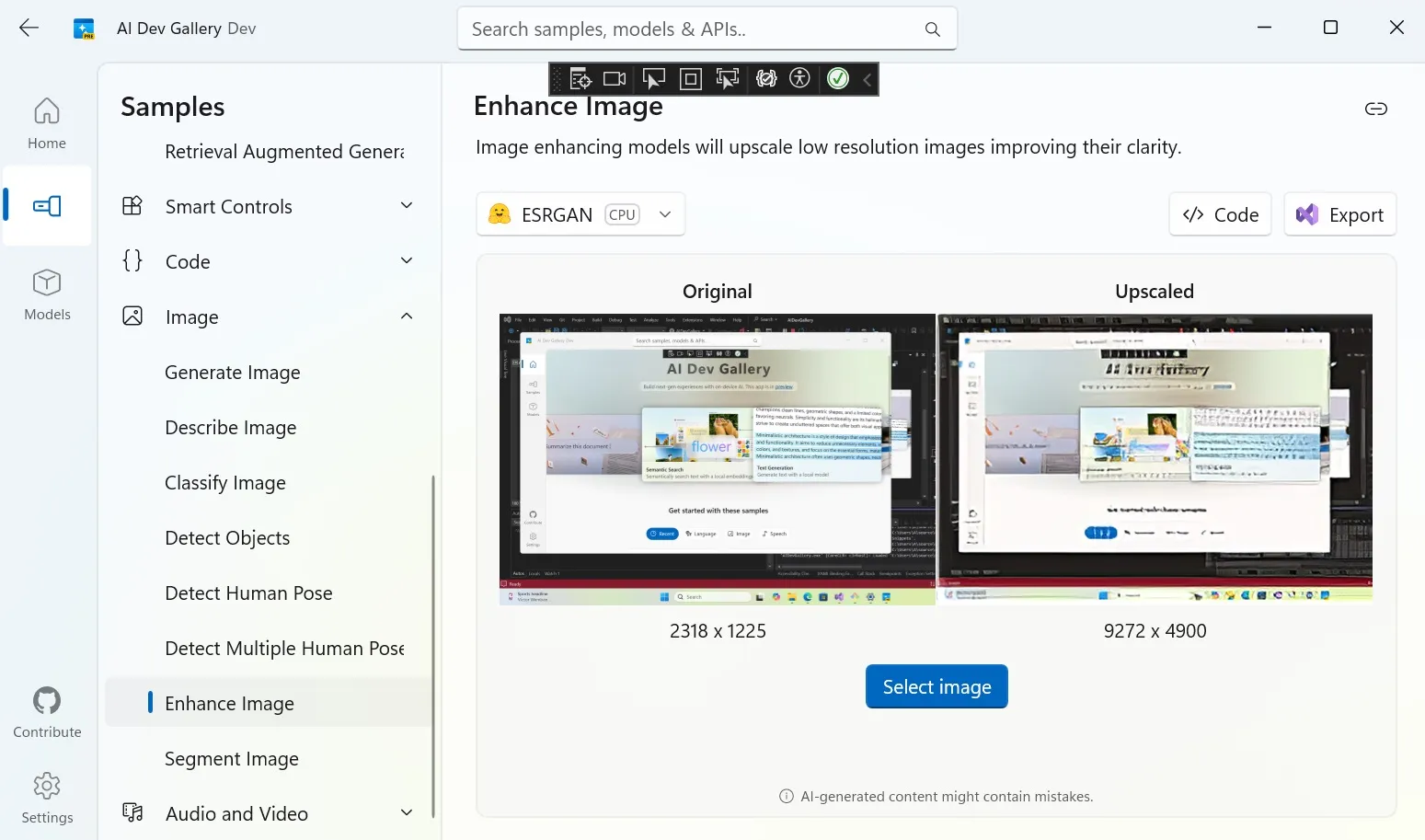

Die für die Bild- und Videogenerierung verfügbaren Modelle sind mit Größen von fast 5 GB relativ groß. Unsere erste Wahl war ein kleineres Modell mit Schwerpunkt auf Hochskalierung, das weniger als 100 MB groß war. Wir machten einen Screenshot und versuchten, ihn mithilfe unserer CPU für die Verarbeitung hochzuskalieren. Insbesondere ist die Option verfügbar, zwischen CPU und GPU für die Verarbeitung von Anfragen zu wechseln.

Der Hochskalierungsprozess war auf dieser bescheidenen virtuellen Maschine in weniger als 30 Sekunden abgeschlossen, was zu einer temporären RAM-Nutzung von bis zu 1 GB führte. Die App zeigte dann ein hochskaliertes Bild mit einer Auflösung von 9272 x 4900 an. Die Qualität der Bildelemente, insbesondere des Textes, war jedoch erheblich beeinträchtigt und unlesbar.

Leider gibt es keine Funktion, um das generierte Bild in einem größeren Format oder im Vollbildmodus in der Vorschau anzuzeigen, und auch keine Option, das Bild direkt auf Ihre Festplatte herunterzuladen.

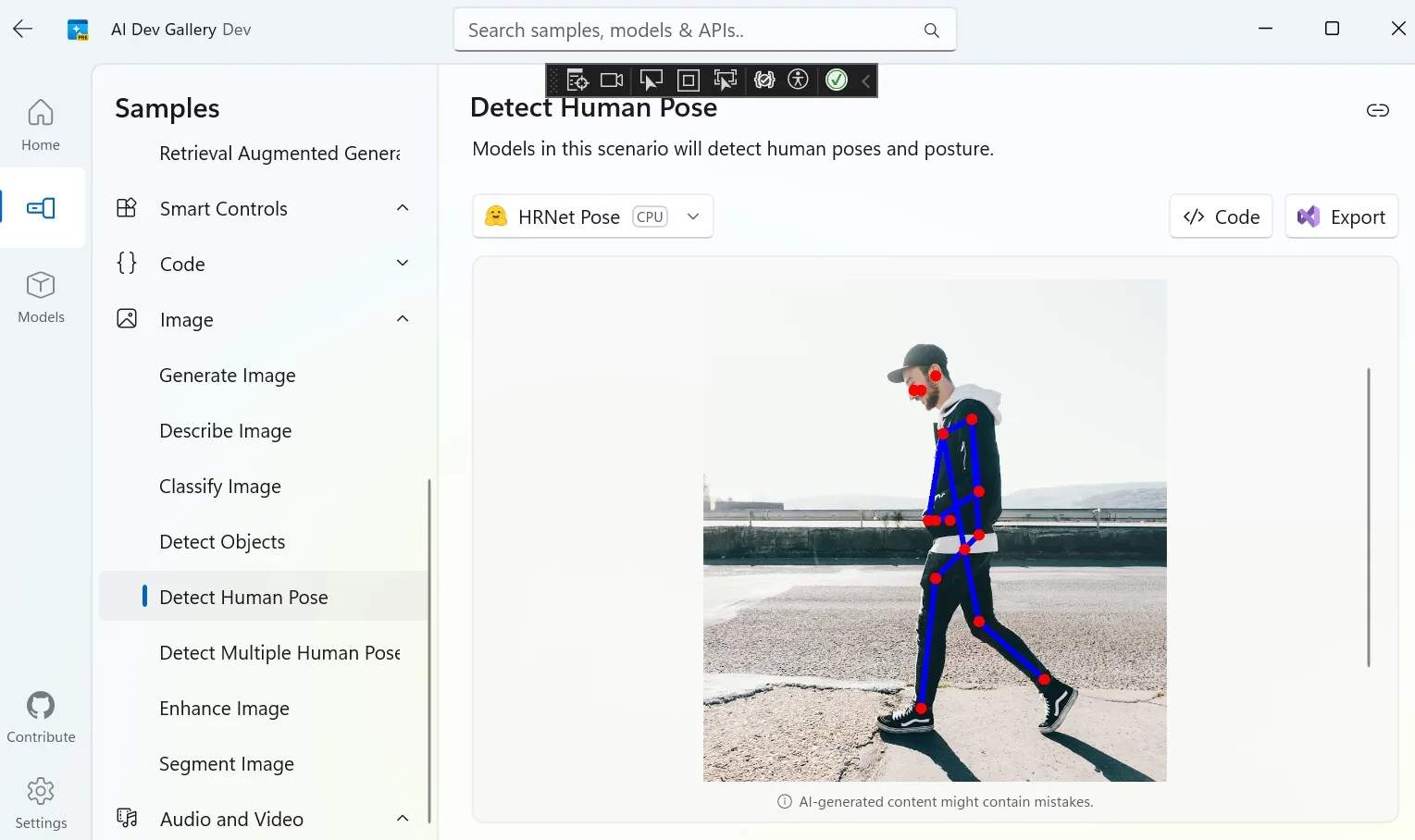

Anschließend testeten wir ein weiteres Modell namens „Detect Human Pose“ , das die Position von Personen in einem Bild ermitteln soll. Dieses Modell erkannte erfolgreich eine einfache gehende Figur, begann aber auch, Positionsmarkierungen über Screenshots unseres Desktops mit mehreren geöffneten Anwendungen anzuzeigen.

Während die genaue Art und Weise der Integration dieser Modelle in Anwendungen noch unklar ist, können bestimmte Funktionen tatsächlich lokal ausgeführt werden. Dennoch benötigen PCs für diese Modelle viel Speicherplatz, robuste CPUs und mindestens 16 GB RAM.

Was ist Ihre Meinung dazu? Lohnt es sich, ein umfangreiches 5-GB-Modell herunterzuladen, um eine Textaufforderung in ein Bild umzuwandeln, oder wäre es effizienter, 30 Sekunden zu warten und eine webbasierte Anwendung zu verwenden? Es ist offensichtlich, dass viele dieser Funktionen auf bestimmte Anwendungsfälle und Betriebsumgebungen zugeschnitten sind, die möglicherweise nicht unbedingt die breitere Benutzerdemografie von Windows 11 ansprechen.

Schreibe einen Kommentar