マイクロソフトの特許、AI幻覚を防ぐ技術を公開

現在、人工知能が直面している大きな障害の 1 つは、幻覚を起こす傾向があることです。つまり、タスクを完了しようとするときに誤解を招く情報や捏造された情報を生成する可能性があります。ほとんどの AI システムは、正確な応答を提供するためにオンライン リソースを活用していますが、会話が長引くと、AI が根拠のない情報に頼ってしまうことがあります。

マイクロソフトは今年初め、AI 幻覚に対処するソリューションの開発を開始し、こうした不正確さを事前に防ぐことを目的とした特許技術を詳述した研究論文も発表した。

「外部知識とフィードバックを使用した言語モデルとの対話」というタイトルのドキュメントでは、このメカニズムがどのように機能するかについて概説しています。

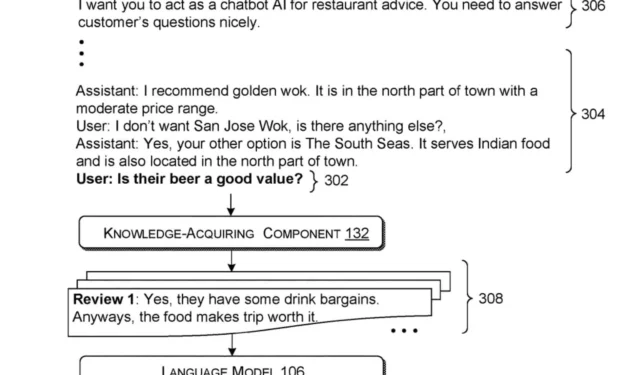

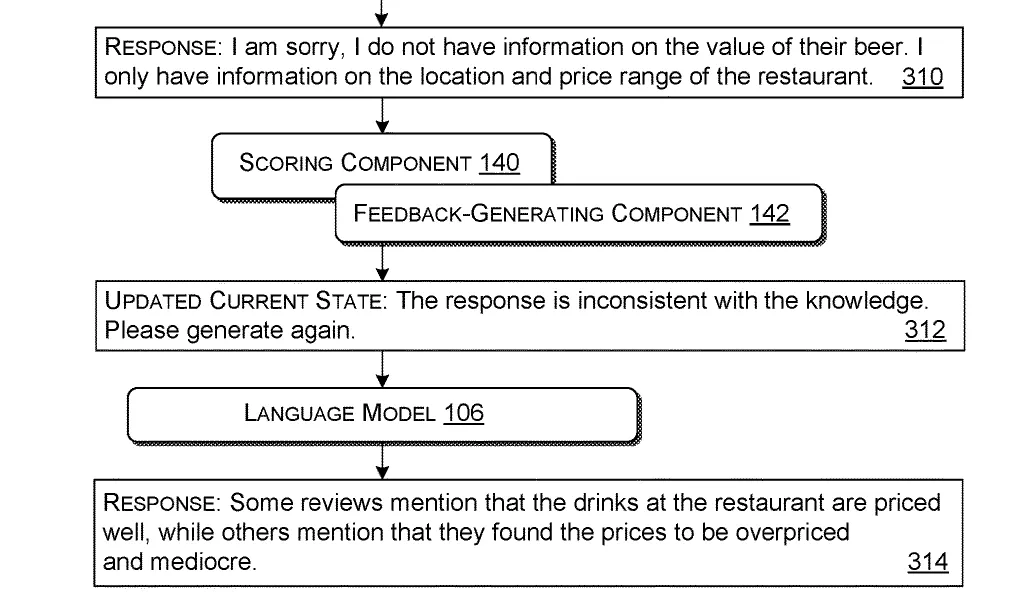

このシステムは、クエリ(ユーザーからの質問またはリクエスト)を処理することによって動作します。そのクエリに基づいて、外部ソースから関連情報を取得します。その後、この情報と元のクエリを統合して、言語モデルが利用できるまとまりのあるパッケージを作成します。

パッケージが構築されると、言語モデルに導入され、提供された入力に基づいて応答を作成するようにトレーニングされます。その後、AI モデルはこの入力パッケージに基づいて初期応答を生成します。

応答の関連性を保証するために、システムは事前定義された基準を使用して、最初の出力が有用性の基準を満たしているかどうかを評価します。最初の応答に価値がない場合は (AI の幻覚を示す)、システムは誤った情報や不足している情報に関するフィードバックを含む、改善された入力パッケージを構築します。

この新しく修正された入力は言語モデルにフィードバックされ、言語モデルはこの洗練された情報に基づいて更新された応答を生成します。

この革新的な技術は、AI の幻覚に対抗するだけでなく、さまざまな現実世界のアプリケーションにも応用できる可能性があります。たとえば、論文で詳しく説明されているように、このシステムはレストランの AI アシスタントによって利用され、顧客に事実に基づいた検証済みの情報を提供したり、会話中に変化する顧客の質問に基づいて応答を調整したりできるようになります。

この反復プロセスにより、入力とフィードバックが継続的に改善され、言語モデルの応答の精度と有用性が向上します。

現時点では特許のみですが、議論された概念は、Microsoft が Copilot などの AI モデルの機能と信頼性の向上に注力していることを示唆しています。

このテクノロジー大手は、AIモデルにおける幻覚に対処し、それを排除するという野心をすでに表明しており、レストランでの接客などの機能において正確な情報が確実に生成できる未来を強調している。

幻覚を排除する戦略により、AI モデルは誤った情報に頼ることなく正確な応答を提供できるようになります。最新の Copilot の音声機能と組み合わせると、AI は自動化された顧客サポート システムなどの初級レベルの仕事を置き換えることができます。

この展開についてどう思いますか?

論文全文はここからご覧いただけます。

コメントを残す